最新のAI技術を自分のPCで自由に操りたい。

そんな願いを叶えるツールがOllamaです。

クラウドサービスの利便性は高いものの、データの機密性や利用料金の継続的な発生に不安を感じている方も多いのではないでしょうか。

エンジニアや研究者の間で「ローカルLLM」がこれほどまでに注目されているのは、自分自身のハードウェアリソースを最大限に活用し、プライバシーが確保された環境で大規模言語モデルを動かせるからです。

かつては高度なLinuxの知識が必要だったローカル環境の構築も、現在はWindowsで非常に簡単に始められるようになりました。

しかし、いざ始めようとすると

- 「自分のPCスペックで足りるのか」

- 「どのパーツを強化すべきか」

という疑問が必ず浮かびます。

本記事では、2025年から2026年にかけての最新トレンドを踏まえ、OllamaをWindowsで快適に動作させるための推奨スペックを、ハードウェアの専門的な視点から詳しく解説します。

この記事を読み終える頃には、あなたのPCがAI開発の強力な武器へと進化するための具体的な道筋が見えているはずです。

ローカルLLM 推奨スペック

要点:動作の可否を分ける最大の要因はVRAM(ビデオメモリ)の容量であり、モデルのサイズに応じた適切なGPU選択が必須です。

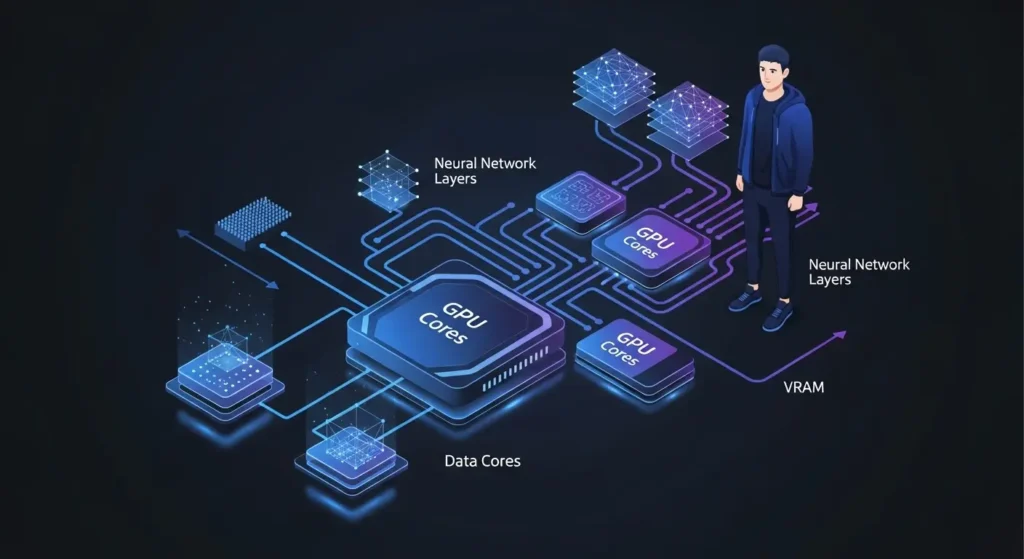

OllamaをWindowsで動かす際、最も重要なリソースはGPUのVRAMです。

大規模言語モデルは、そのパラメータ数に応じて膨大なメモリを消費します。

CPUだけでも動作は可能ですが、応答速度(トークン生成速度)はGPU使用時と比較して著しく低下します。

CPUとメモリの基本要件

CPUは、インテル Core i5 以上、または AMD Ryzen 5 以上が基本となります。

しかし、推論処理の主役はGPUであるため、CPUへの依存度は相対的に低くなります。

一方でシステムメモリ(RAM)は、OSの動作やモデルのロードを考慮します。

最低でも16GB、複数のタスクを並行して実行する開発者であれば32GB以上を確保することが推奨されます。

GPUとVRAMの選定基準

Ollamaで一般的に利用されるモデルサイズと、必要となるVRAMの目安は以下の通りです。

| モデル例(パラメータ数) | 推奨VRAM容量 | 快適に動作するGPUの例 |

| 7B / 8B (Llama 3等) | 8GB 以上 | RTX 3060 / 4060 |

| 13B / 14B (Mistral等) | 12GB 以上 | RTX 3060 12GB / 4070 |

| 30B 以上 | 24GB 以上 | RTX 3090 / 4090 |

参照:Ollama version for given laptop specs – Reddit

Ollama 動作環境

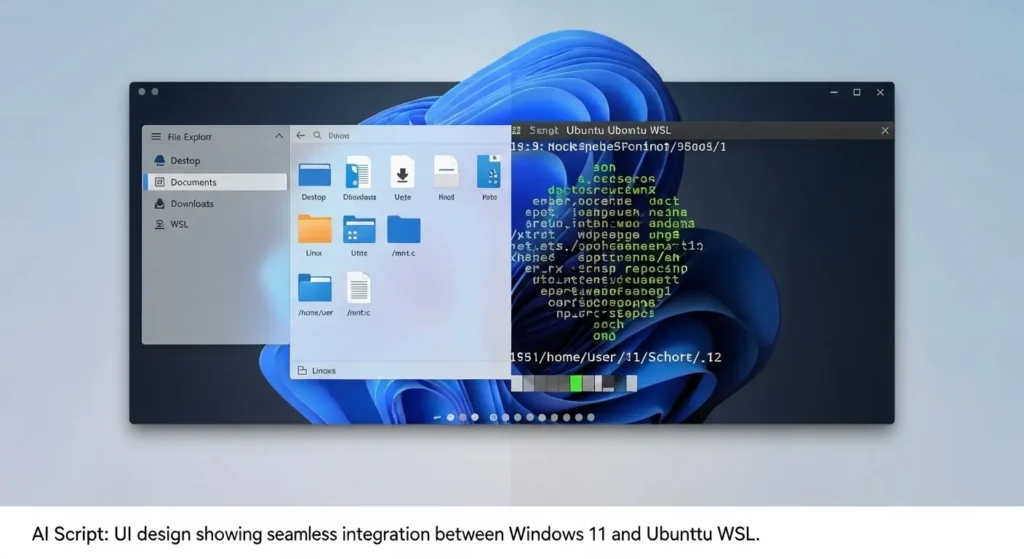

要点:OSはWindows 10/11が必須であり、WSL2を活用したLinux仮想環境上での運用が最も安定したパフォーマンスを発揮します。

Windows環境でOllamaを構築する場合、2025年以降は「Windowsネイティブ版」が提供されています。

より詳細なカスタマイズや他ツールとの連携を考慮すると、WSL2(Windows Subsystem for Linux 2)上での環境構築も依然として人気があります。

Windows OSとWSL2の関係

Windows 11であれば、OS標準の機能としてGPUのパススルー(GPUの計算能力を仮想環境へ直接提供する技術)が強化されています。

WSL2上でLinux版Ollamaを動かしてもパフォーマンスの低下はほとんどありません。

むしろ、Pythonライブラリとの親和性や、GitHubで公開されているオープンソースツールとの連携を考慮すると、開発者にとってはLinux環境上での運用に大きなメリットがあります。

ネットワークとストレージの準備

モデルのダウンロードには数GBから数十GBのファイルサイズを扱うため、高速なインターネット接続環境と、読み込み速度の速いNVMe SSDの空き容量が必要です。

従来のHDDでは、モデルの起動時に数十秒から数分の待ち時間が発生する可能性があるため、注意点として覚えておきましょう。

注釈:WSL2とは、Windows OSの中でLinuxを直接動かすための仮想化技術のことです。

Ollama GPU設定

要点:NVIDIAのドライバーを最新に保ち、CUDAサポートを確認することで、GPUによる高速な推論が実現します。

OllamaをWindowsにインストール後、まず確認すべきはGPUが正しく認識されているかという点です。

Ollamaは自動的にGPUを検出しますが、設定が適切でないとCPUのみでの動作にフォールバック(代替動作)してしまいます。

NVIDIAドライバーとCUDA

NVIDIA製GPUを使用している場合、最新の公式ドライバーをインストールすることが必須です。

Ollamaは内部でCUDA(GPU向けの並列計算プラットフォーム)を利用して大規模言語モデルの演算処理を行います。

コマンドプロンプトで nvidia-smi を実行。

利用可能なGPU情報が表示されるか確認してください。

AMD製GPUの対応状況

2025年現在、AMD製GPU(Radeonシリーズ)でもROCmというアーキテクチャを通じて、OllamaでのGPU支援が受けられるようになっています。

ただし、NVIDIAと比較すると一部のモデルで最適化が遅れるケースがあります。

これからAI開発専用にPCを新調するユーザーであれば、NVIDIA GeForce RTXシリーズの選択が最も無難であり、高い成功率を期待できます。

注釈:フォールバックとは、本来の方法が使えない場合に、制限された代替手段で動作を継続することです。

Ollama メモリ

要点:VRAM不足を補う「オフロード」機能により、メインメモリ(RAM)も高速なものを選ぶ価値があります。

Ollamaの特徴的な機能の一つに、モデルのレイヤー(層)を分割してGPUとCPUに割り当てる機能があります。

これを「GPUオフロード」と呼びます。

8GB・16GB・32GBの使い分け

もしVRAMが8GBしかないPCで、12GB以上のメモリを必要とするモデルを実行しようとすると、入り切らないデータが通常のRAMへと転送されます。

この際、RAMの速度が遅いと全体の推論速度が大きく低下します。

そのため、2026年の推奨スペックとしては、最低でもDDR5規格の32GB以上を搭載した環境が理想的です。

量子化モデルとサイズの関係

Ollamaで利用できるモデルの多くは「量子化(Quantization)」という技術で軽量化されています。

例えば、通常であれば数十GB必要な大規模な言語モデルも、精度を微調整しつつファイルサイズを数GBに圧縮することで、個人用のPCでも現実的な速度で応答を生成できるようになっています。

注釈:量子化とは、AIモデルのデータの精度を意図的に落とすことで、計算負荷とメモリ消費を劇的に減らす技術です。

Windows WSL2 GPU

要点:WSL2環境でGPUを活用する場合、Windowsホスト側の最新ドライバーがあれば、Linux側への特別なインストールは不要です。

技術的な観点から、WSL2でのGPU活用は非常に効率的です。

かつてはLinux側に手動でドライバーを導入する複雑な手順が必要でした。

現在のMicrosoft公式サポートにより、Windows側にドライバーが入っていれば自動的に連携されます。

環境構築の具体的手順

- Windowsの「設定」から「Linux用Windowsサブシステム」を有効化。

- Microsoft StoreからUbuntuなどのディストリビューションをダウンロード。

- ターミナルで curl -fsSL https://ollama.com/install.sh | sh コマンドを実行。

- インストール完了後、 ollama run gemma などのコマンドでモデルを起動。

コンテナ化による管理の効率化

Dockerなどのコンテナ技術とWSL2を組み合わせることで、Ollamaを一つのサービスとして独立させます。

他のアプリと接続(API連携)させることも簡単です。

これにより、自分自身のプロジェクト上からローカルAIを呼び出す高度な開発が可能になります。

Ollama Windows インストール

要点:ネイティブ版インストーラーを使えば、数クリックでAI環境の構築が完了します。

手順の要約

公式サイト(https://ollama.com/)からWindows版のファイルをダウンロード。

実行するだけです。

インストール後はシステムトレイに常駐し、バックグラウンドでリソースを管理してくれます。

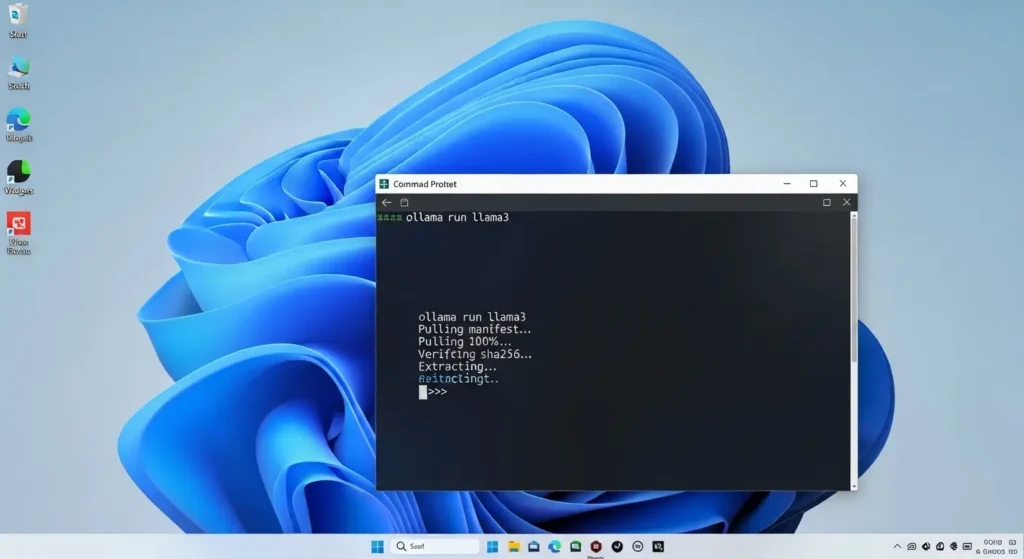

コマンドでの確認と実行

インストールが終わったら、PowerShellを起動して ollama -v と入力してください。

バージョン情報が表示されれば成功です。

その後、 ollama run llama3 を実行するだけで、世界最高水準の大規模言語モデルとのチャットが始まります。

注釈:ネイティブ版とは、仮想環境を使わずにWindows上で直接動作するように設計されたソフトウェアのことです。

Ollamaを利用したローカルAI活用術と詳細設定

要点:インストール後の初期設定やモデルの管理方法を正しく理解することで、Windows環境でのAI利用がより快適になります。

Ollamaを正常にインストールした後は、実際にモデルをプルして動かすプロセスに入ります。

ここでは、2026年現在の最新の使い方と、目的に応じた最適な設定方法を徹底解説します。

モデルの取得と管理方法

Ollamaでは、公式サイトのライブラリから自身が使いたい言語モデルを選択し、以下のコマンドを実行するだけで導入が完了します。

- モデルのダウンロード:

ollama pull [モデル名]を実行すると、最新のモデルファイルが取得されます。 - モデルの起動と対話:

ollama run [モデル名]で、ローカル環境での対話が開始されます。 - モデルの削除:ストレージのリソースを確保するため、不要になったモデルは

ollama rm [モデル名]で削除可能です。

セキュリティと外部接続設定

要点:ローカルLLMの主なメリットはセキュリティ性の高さですが、API連携を行う際には注意点があります。

デフォルトでは 127.0.0.1(localhost)からの接続のみを許可していますが、他のPCからアクセスさせたい場合は、環境変数の設定変更が必要です。

例えば、OLLAMA_HOST を 0.0.0.0:11434 に設定することで、同一ネットワーク内からの接続が可能になります。

ただし、この設定を行う場合は、ファイアウォールの設定を合わせて確認し、十分な防御を実装することが最終的な安全に繋がります。

マルチモーダルモデルのWindows活用

要点:テキストだけでなく、画像認識に対応したモデルをWindows上で試すことで、AI活用の幅が大きく広がります。

2024年頃から普及が始まったマルチモーダル機能は、2026年現在、IntelやNVIDIAの最新GPUを搭載したPCで極めて高速に応答します。

- 画像分析の例:

ollama run llavaを起動し、プロンプトと一緒に画像ファイルを指定するだけで、内容の要約や特定のタスクを実行させることが可能です。 - 学習とプロンプトエンジニアリング:ローカルであれば、何度でも試し書きができ、自身専用のプロンプトをじっくり作成できます。

2026年特化・AI PC(NPU)の活用

2026年の最新トレンドとして、最新のCPUに搭載されている「NPU(Neural Processing Unit)」の活用が挙げられます。

従来のGPU中心の推論に加え、Ollamaも今後NPUへの対応を強化する見込みです。

これにより、GPUを積んでいない薄型ノートPCでも、省電力で言語モデルを動かせる可能性が広がっています。

マルチモデル並列実行のメモリ管理術

複数のモデル(例:翻訳用のQwenと要約用のLlama)を同時に起動する際、OllamaはVRAMを動的に共有します。

この時、特定モデルにメモリを固定(Pinning)する設定を環境変数で行うことで、応答の遅延を最小限に抑えるプロのテクニックがあります。

ローカルホストを超えた「社内AIサーバー」化

localhost:11434 だけでなく、環境変数 OLLAMA_HOST を設定することで、同じネットワーク内の他のPCからAPI経由でAIを利用可能にする方法です。

これにより、高性能なPC一台をサーバーとして、安価なノートPCからAI機能を呼び出す「自分専用のクラウド」が構築できます。

よくある質問

要点:導入時につまずきやすいポイントを解決(解決)します。

Q1:メモリ8GBのノートPCでも動きますか?

結論:はい、動作しますが、選択できるモデルが限定されます。

理由:OS自体が数GB消費するため、モデルに割り当てられるリソースが不足するからです。

具体例:Phi-3やTinyLlamaなどの軽量モデル(1B〜3Bパラメータ)であれば、8GB環境でも実用的な速度で応答を生成できます。

Q2:GPUがない場合、どのくらい遅くなりますか?

結論:GPU使用時に比べ、体感で10倍から50倍程度の時間がかかります。

理由:CPUは複雑な演算を得意としますが、AI特有の並列計算には向いていないためです。

具体例:GPUなら1秒で数十文字出力されるプロンプトも、CPUのみでは1文字ずつゆっくり表示される状態になります。

Q3:ChatGPTと比べて性能はどうですか?

結論:最新のLlama 3 70Bなどを利用すれば、GPT-4に匹敵する性能をローカルで実現可能です。

理由:オープンソースモデルの進化が著しく、特定のタスク(コード生成や日本語要約)に特化した微調整モデルが多数公開されているためです。

まとめ:自分に最適なAI環境を選ぼう

要点:まずは手持ちのPCで試し、必要に応じてメモリやGPUを強化するのが最も賢いステップです。

Ollamaは、AIを自分の手元に取り戻すための最高のツールです。

Windows環境であれば、高度な技術知識がなくても大規模言語モデルを自在に操ることができます。

まずは現在の環境でインストールを実行し、いくつかのコマンドを試してみてください。

2026年のAI時代において、自分自身のハードウェアでAIを動かせるスキルは、開発者のみならず全てのビジネスパーソンにとって大きな武器になります。

スペック不足を恐れず、まずは軽量モデルからローカルAIの世界に触れてみることを強くおすすめします。