コーディングの未来を自前で構築する

要点:ローカルLLMをコーディングに導入することで、機密情報を外部に送ることなく、高速かつ安全にaiによる開発支援を受けられるようになります。

最近、github copilotやcursorといったaiコーディング支援サービスが一般に広く普及し、エンジニアの作業効率は劇的に向上しました。

しかし、会社やプロジェクトの厳しいセキュリティ規約により、ソースコードを外部のクラウドサーバーに送信することが許されないケースも少なくありません。

せっかく最新のテクノロジーがあるのに、環境の制約でつかっちゃダメと言われるのはモチベーションにも影響しますよね。

そこで注目されているのが、自分のpc上で大規模言語モデル(llm)を動かすローカルLLMです。

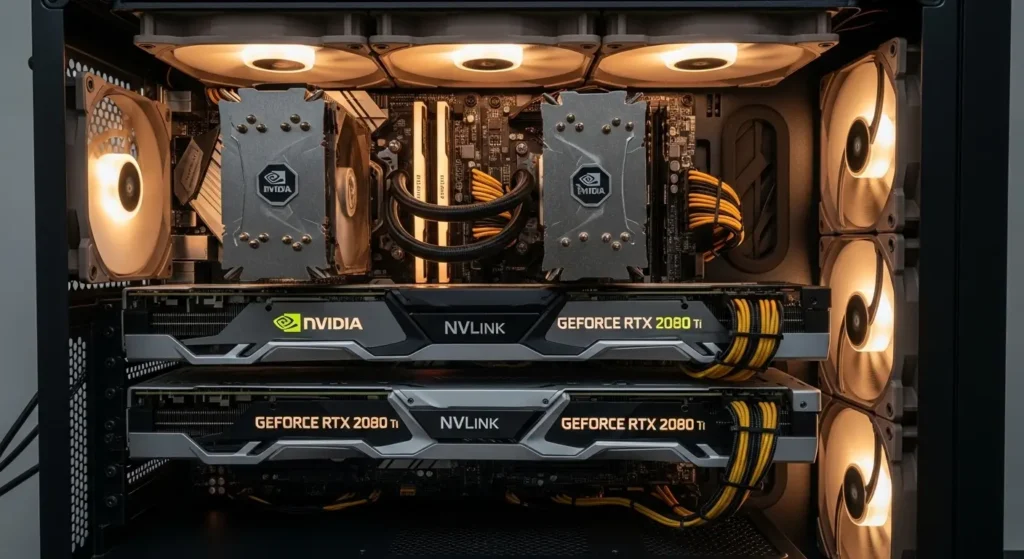

2026年現在、nvidiaのgeforce rtx 40シリーズやappleのm4チップといった高性能なgpuやcpuの登場により、いえでも少額の投資で商用レベルに近いaiコーディング環境を構築できるようになりました。

本記事では、

- 概要

- 具体的な構築方法

そして実践的な活用シーンまで、初心者の方でも分からなくならないよう徐々にゆっくりと解説していきます。

ローカルLLM コーディング効率化のメリット

要点:プライバシーの確保はもちろん、従量課金を気にせず何度でもコード生成やデバッグを繰り返すことができる点が大きな利点です。

結論から言うと、ローカルLLMをコーディングに活用する最大の価値は、情報の秘匿性と無限の試行錯誤にあります。

- 機密情報の保護: ソースコードや社内資産を外部へ送る必要がないため、コンプライアンスが厳しいプロジェクトでも利用可能です。

- コスト削減: クラウドサービスは月額額やリクエスト回数に応じた課金が発生しますが、ローカル環境なら一度買っちゃったハードウェアさえあれば無料(電気代のみ)で使い放題です。

- 低遅延なレスポンス: インターネット接続の状態に左右されず、gpuのパワーを直接つかっ推論を行うため、高速なコード補完が期待できます。

最近では、qwen2.5-coderやdeepseek-coderといったコーディングに特化した高性能なオープンソースモデルが登場し、特定のタスクではopenaiのgpt-4oに匹計するスコアを記録しています。

ローカルLLM コーディング 環境構築ガイド

要点:実用的なローカルコーディング環境を構築するには、高性能な推論エンジン(Ollama等)と、IDE(VSCode)を橋渡しするエージェントツールの組み合わせが不可欠です。

せっかくハイスペックなpcを買ったなら、そのパワーを100%開発に注ぎ込みたいですよね。

以前は環境構築だけで日が暮れることもありましたが、2026年現在は主要なツールが整備されました。

初心者でもステップ通りに進めればスムーズに導入出来るようになりました。

ここでは、windowsやmacなどのosを問わず、コーディング効率を最大化するための具体的な構築ガイドを徹底解説します。

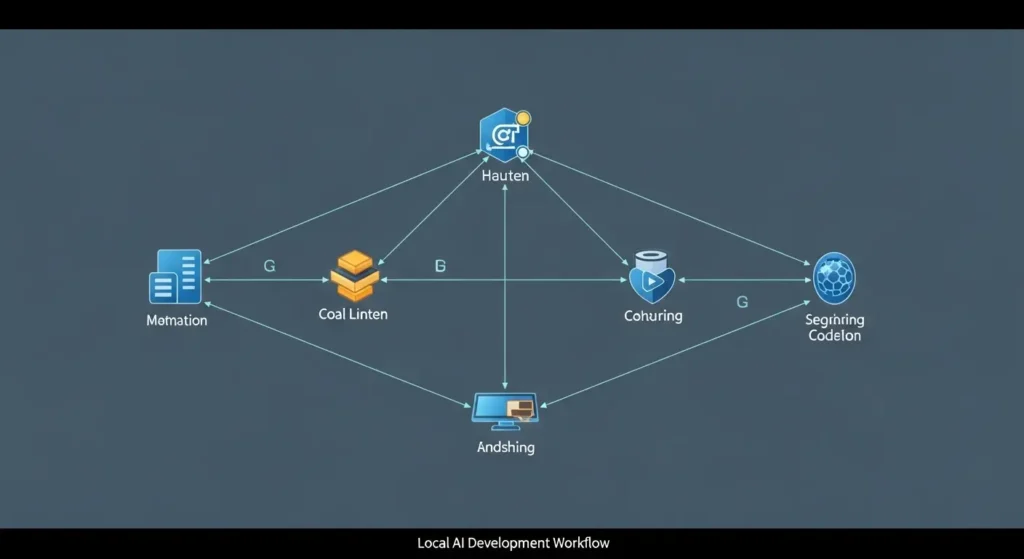

推論基盤:Ollamaの導入

まず、ローカルでllmを動かすためのサーバーとなる「Ollama」をインストールします。これはバックエンドでaiを動かし続けるための心臓部です。

- 手順: 公式サイトからインストーラーをダウンロードして実行するだけ。

- モデル取得: ターミナル(コマンドプロンプト)を開き、

ollama run qwen2.5-coder:7bと入力。これで、コーディングに特化し、かつ日本語の理解力も高い最新モデルがpc内に入ります。

IDE連携:VSCode拡張機能の選定

aiと対話しながらコードを書くためには、エディタとの連携が重要です。最近人気が高まっているのが「Cline(旧Claude Dev)」や「aider」です。

- Clineの活用: VSCodeの拡張機能からインストール。設定(settings)でAPIプロバイダーを「Ollama」に指定し、エンドポイントを

http://localhost:11434に設定します。 - Agent機能: これにより、aiは単なる回答者ではなく、あなたの代わりにファイルを編集し、ターミナルでテストを実行する「自律型エージェント(agent)」として動作します。

ローカルLLM コーディング実践とチュートリアル

要点:2026年最新のローカル開発ワークフローでは、Clineやaiderといったエージェントツールを活用し、AIに直接ファイルを操作させる「Act(実行)モード」を使いこなすことが成功の鍵となります。

ローカルLLMを導入した後は、いかに日々のコーディング作業に組み込むかが重要です。

単なる質問回答(チャット)に留まらず、AIを「自律的なチームメンバー」として扱うための実践的なチュートリアルを解説します。

初心者でもこの通りに進めれば、1回でプロ級の開発支援環境を体感出来るようになります。

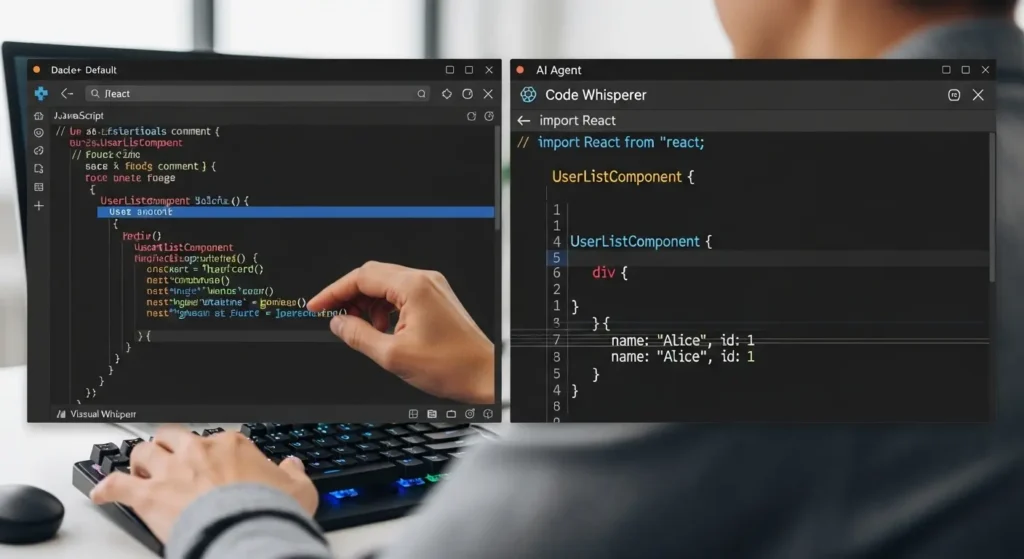

Clineを活用した自律型コーディングの実践

VSCode拡張機能のCline(クライン)を使えば、指示を出すだけでaiがソースコードの中身を書き換え、ビルドやテストまで自動で実施します。

- Actモードの起動: 指示を出す際、Clineを「Actモード」に設定してください。これにより、aiは「コードを書く」だけでなく「ファイルを新規作成・変更」する権限を持ちます。

- 指示の出し方: 「

src/components内にある既存のボタンコンポーネントを参照して、同様のスタイルでログインフォームを作成し、Login.tsxとして保存して」と具体的に依頼します。 - 注意点: 大規模なプロジェクトでは、Ollama側のコンテキスト長を「128」k以上に増やしておき。これにより、プロジェクト全体の構造を不足なく把握した正確な提案が得られます。

aiderによるGit連携と自動コミット

ターミナル(CLI)中心で作業するエンジニアには、aider(エイダー)が100%おすすめです。

- 環境構築:

pip install aider-chatでインストールし、aider --model ollama/qwen2.5-coder:32bで起動します。 - リファクタリング: 「この関数の計算量を改善して」と伝えると、aiderはファイルを直接編集し、修正内容を整理したコミットメッセージと共に自動でgitコミットまで完了させます。

- デバッグ: テストコマンド(例:

npm test)の出力をそのままaiderに渡せば、エラーの原因を分析し、修正案を提示するまでを自動的に繰り返すことが可能です。

ローカルRAGを駆使したユニットテスト生成

自社特有のテスト規約や、複雑なビジネスロジックに基づいたテストコードを生成するチュートリアルです。

- 参照の活用: 既存の正常なテストコードをaiに参照させ、「このテストの書き方を踏まえて、新しく作った

PaymentService.tsのユニットテストを作成して」と指示します。 - 成功のポイント: 1回で完璧を目指すのではなく、まずは「モックの作成」だけ、次に「異常系のケース」だけ、というようにステップを分けて指示することで、より高品質なコードを得られます。

SRE業務への応用:ログ解析とインフラ構築

開発だけでなく、システムの安定稼働を担うsre業務への活用も広がっています。

- Terraformの生成: 「AWS上にスケーラブルなVPC環境を構築するTerraformコードを書いて」といった依頼も、機密性の高いインフラ設計を外部に漏らすことなく実施出来ます。

- ログの異常検知: 128kの広いウィンドウを活かし、数千行のサーバーログを読み込ませて「発生しているエラーの共通点と解決策を報告して」と依頼します。これにより、人間が何時間もかけて行っていた調査作業を数分に短縮可能です。

2026年のエンジニアがローカル環境へ回帰する理由

要点:2024年からの急速な進化を経て、2026年はセキュリティとコストの観点から、実務の多くをローカルLLMで動かしていくスタイルが主流となっています。

Googleの検索エンジンや専門のblogをチェックすると、2025年辺りからローカルAIに関する投稿が大量に増えていることに気づくでしょう。

以前は「クラウドの方が高性能」という話が一般的でしたが、現在は3bや7bといった小型モデルでも、コーディングに特化したinstruct版のリリースが相次ぎ、16gb程度のメモリを搭載した標準的なPCでも十分実用的な速度で動作します。

今回、私たちがチャレンジするのは、外部へのデータ送信を一切行わずに、あなたのPC内でcompletions(注釈:コードの続きを予測して補完する機能)を完結させる最強の開発基盤作りです。

LM Studioを活用したモデルの選定と検証

要点:LM Studioを使うことで、自分のPCスペックとモデルの互換性を一目で確認し、最適なパラメータ設定でaiを動かし始めることができます。

ローカルLLM コーディング 効率化の第一歩は、自分に合った「脳」を見つけ出すことです。

初心者の方には、GUI付きで操作が簡単なLM Studioがおすすめです。

- モデルの検索と評価: 画面上の検索バーから「Coder」や「Gemma」などのキーワードで検索し、ダウンロード数や評価が高い版を選択します。

- 互換性の確認: 自分のPCのVRAM容量に対し、そのモデルが「OK(動作可能)」かどうかを表示付きで教えてくれるため、失敗がありません。

- プロンプトの試し打ち: 実際にチャット画面でPythonのプログラムを書かせてみて、出力結果の精度やtokens(注釈:文字の生成単位)の生成速度を検証しましょう。

コーディング用パラメータの最適化手順

要点:推論時のパラメータ(温度や最大トークン数)を適切に変えることで、コードの正確性と安定性を大幅に向上させることが可能です。

デフォルト設定のままでも動かせることは多いですが、プログラミング用途では以下の値を調整するのが「主」なテクニックとなります。

- Temperature(温度): 値を「0.0」から「0.2」程度の低い数値に設定します。これにより、AIが余計な遊びを入れず、正確なコードを返す確率が高まります。

- Max Tokens: 総出力文字数を制限する項目です。大規模なクラス作成を依頼する場合は、この値を大きく設定しておき。

- Stop Sequences: JSON形式や特定の関数末尾で生成を止めるための設定です。

各設定を変更した後は、同じプロンプトを投げて結果がどう変わるか一覧で比較してみるのが、良い環境を作るための近道です。

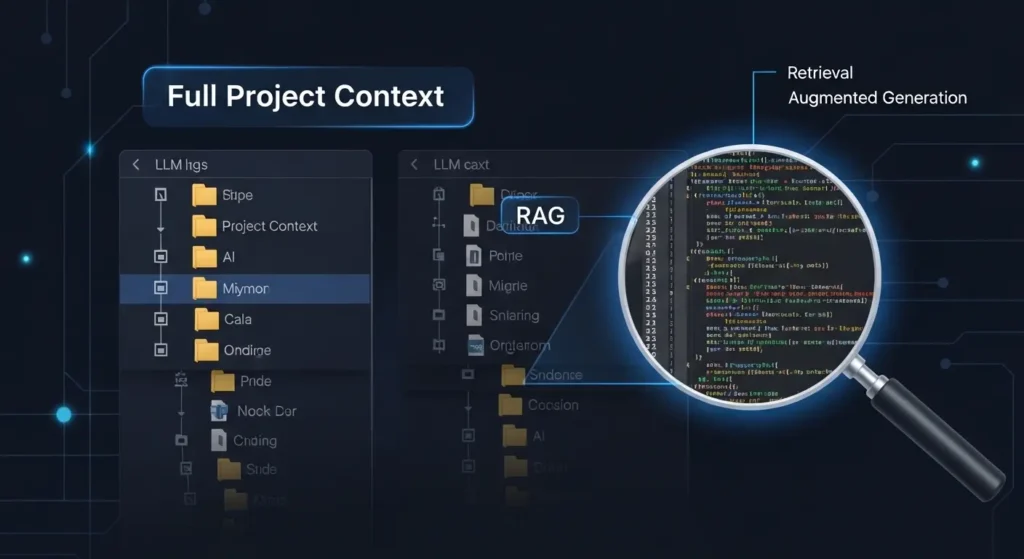

128kコンテキストとRAGによる「プロジェクト全把握」

要点:2026年最新のローカルモデルは、128k(約10万文字以上)の広大なコンテキストウィンドウをサポートしております。

RAGと組み合わせることでプロジェクト全体の「文脈」を完全に把握した高度な推論が可能になります。

従来のAIコーディングでは、一度に渡せる情報量に限界があります。

別のファイルに書かれたクラス定義や関数を見失うことが多々ありました。

しかし、2026年現在、Qwen2.5-CoderやGemma 4といったモデルは128k以上の長いコンテキスト(注釈:AIが一度に記憶・処理できる情報の長さ)を標準で備えています。

これにより、数千行に及ぶソースコードを丸ごとaiに読み込ませ、プロジェクト全体の中身を統合的に理解させることが現実的になりました。

長大な文脈がもたらす開発体験の変革

128kという広さは、単なる「文章量」以上の価値を持ちます。

- 依存関係の完全把握:

import先の深い階層にあるロジックまでaiが参照出来るため、型定義の不一致や循環参照などのバグを未然に防ぎます。 - 大規模リファクタリング: プロジェクト内の全ファイルをスキャンし、「この共通関数を変更した場合の影響範囲をすべて修正して」といった広範囲な依頼が1回で完了します。

- 一貫性の維持: 変数の命名規則やデザインパターンをプロジェクト全体から学習し、既存のコードと違和感のないコード生成を継続して行えます。

ローカルRAGとの戦略的組み合わせ

どんなにコンテキストが長くても、数万ファイルにおよぶ巨大なリポジトリをすべて読み込ませるのはgpuリソースの無駄になります。

ここで活きるのがRAG(注釈:検索拡張生成。必要な情報をデータベースから探し出し、AIに与える技術)です。

- 情報のフィルタリング: まずRAGが「今書いている機能に関連するファイル」を高速に検索。

- 文脈の濃縮: 検索された数MB分のソースコードのみを128kの広いコンテキストに流し込む。 この「広さ」と「正確な検索」の組み合わせこそが、2026年流のコンテキストエンジニアリング(注釈:AIに与える情報の質を設計する技術)の核心です。

128k環境を安定させるための技術的ヒント

広大なコンテキストを扱う際、nvidia geforce rtx 40シリーズ等のgpuでは以下の設定が効果的です。

- Flash Attentionの有効化: メモリ効率を劇的に改善し、長い文章を入力しても速度低下を抑えます。

- YaRN(Yet another RoPE extension): 2025年後半から普及したこの技術により、モデルが本来持つ以上のコンテキスト長を、精度を落とさずに扱うことが可能です。

- KVキャッシュの管理: 128kをフルに使うとvram(メモリ)を大きく消費します。OllamaやvLLMの設定で、適切なキャッシュサイズを割り当てることで、長文対話時の「待ち」を大幅に削減出来ます。

2026年最新の「コンテキストエンジニアリング」術

要点:AIに何を見せ、何を隠すかを設計するスキルが、エンジニアの新しい必須能力となっています。

2026年に入り、RAGは単なる検索技術ではなく、AIの「作業記憶」を最適化する高度な技術として位置づけられています。

- 「.aider.conf」や「.clinerules」の活用: プロジェクトのルートに設定ファイルを配置し、aiが常に優先して読み込むべき設計指針や、無視すべき一時ファイルを明示します。

- サマリー・レイヤーの実装: 巨大なクラスファイルは、LangChain等のライブラリを介して「概要のみを抽出したヘッダー情報」としてaiに渡すことで、コンテキストの消費を抑えつつ、中身の理解度を維持する手法が普及しています。 これにより、intel corei cpuやmemory 32gbのwindows note pcといった限られたスペックでも、大規模開発に耐えうるai環境を維持出来るようになっています。

SRE業務への応用とログ解析の自動化

要点:開発だけでなく、sreの領域でもローカルLLMは強力なツールとなります。

会社から許された範囲の内だけで実施しなければならないインフラのログ解析。

外部サービスへ送ることは禁じられていても、ローカルllmなら問題ありません。

膨大なサーバーログをaiに流し込み、異常なパターンの検出や、トラブル復旧の手順を提案させることができます。

そういう意味では、マネージャーやsre担当者にとっても、ローカルai環境を自前で保有しておくことは大きな強みになります。

予算を抑えた「あがき」のハードウェア構成術

要点:10万円以下の少額予算でも、中古のnvidia gpuやcpuの組み合わせ次第で、実用的なローカルaiコーディング環境は構築可能です。

お金が溢れているわけではない個人開発者にとって、金額は大きな壁です。

無謀に最新のdgxを買う必要はありません。

例えば、中古のrtx 3090(24gb vram)を安く買っきて、少し古めのintel corei7やryzenと組み合わせれば、70bクラスのモデルを4bit量子化で動かすことが可能です。

これで十分戦える!という感覚を徐々に掴んでいきましょう。

財布に優しく、少しずつ強化していくのも自由研究の醍醐味です。

よくある質問と回答:Q&A

要点:初心者の方が躓きやすい、動作の重さや精度の問題に対する解決策をまとめました。

ローカルだとクラウドより精度が低いのでは?

いえ、現時点ではqwenやllamaの最新版(32b以上推奨)を使えば、日常的なコーディング作業においてクラウドサービスとの差を感じることはかなり少なくなっています。

特に、特定言語に特化したモデルを選定すれば、非常に正確なコードが返っきます。

応答が遅くて作業が止歩まってしまう。

モデルのサイズを見直してみてください。8b前後のモデルなら、一般的なノートpcでも高速に動作します。

まずは軽いモデルから開始し、徐々に大きなモデルへ切り替えてみるのが良いアプローチです。

プライバシーポリシーや利用規約はどうなっていますか?

ローカルで動かす場合、モデルのバイナリ自体をダウンロードして実行するため、運営会社へデータが送信されることはありません。

完全なプライベート環境として安心して利用できます。

ただし、vscode拡張機能自体がテレメトリを行っていないか、初期設定でチェックすることをおき。

まとめ:ローカルAIで開発の可能性を広げよう

要点:ローカルLLMは、セキュリティ、コスト、自由度のすべてにおいて、現代のエンジニアにとって最強の武器となります。

藤原さん(仮)も息巻いて言っている通り、今、開発者にとって自分の手元に知能を置くことの価値は最高に高まっています。

たび重なるクラウドサービスの仕様変更や価格改定に振り回されることなく、自分だけの安定した開発基盤を構築しましょう。

まずはvscodeに拡張機能を入れ、ollamaで小さなモデルを動かすところから開始してください。

少しずつ環境を調整し、バグを修正し、新しい機能を実装していく過程で、あなたはaiを単なるツールとしてではなく、頼もしいチームメンバーとして感じることができるはずです。

結論として、ローカルLLM コーディングは、これからのエンジニアリングにおいて必須のスキルと言えます。

この記事が、あなたのプロジェクトを前進させるきっかけになれば幸いです。

公式サイト・関連リンク

- Ollama – Get up and running with Llama 3.3, Mistral, and more

- GitHub – Open WebUI: User-friendly WebUI for LLMs

- VSCode Extension: Cline – Autonomous AI Agent

- NVIDIA Developer – CUDA Toolkit

- Hugging Face – The AI community building the future

- Mistral AI – Frontier AI in your hands

- Meta Llama – Open source AI for developers