自宅のPCが賢いAIに変わる瞬間

要点:ローカルLLMを導入すれば、月額料金を払うことなく、自分専用のaiアシスタントを完全無料で手元に置くことができます。

最近、ChatGPTのような対話型aiがビジネスや日常に欠かせないものとなりました。

しかし、無料版では機能が制限されたり、入力したデータが学習に使われる不安を感じたりすることはありませんか。

もし、インターネットに繋がなくても動作し、情報の漏洩リスクがゼロのaiを、自分のパソコンだけで動かせるとしたら。

2026年現在、llama.cppやlm studioといった無料ツールの進化により、かつては巨大なサーバーが必要だった大規模言語モデル。

一般的なデスクトップpcやノートパソコンで驚くほど簡単に動くようになっています。

本記事では、プライバシーを守りつつ、最新のai技術を無料で使い倒すための環境構築からモデル選定まで、エンジニアから初心者の方まで納得できる情報を整理してお届けします。

ローカルLLM インストールと基本環境

要点:2026年現在のローカルLLM導入は、複雑なビルド作業を必要とせず、専用のインストーラーやパッケージ管理ツールを用いることで、数クリックで完了するほど簡略化されています。

以前であれば、Pythonの環境構築や依存ライブラリの解決に何時間も費やすのが当たり前でした。

しかし現在は、主要なOSに対応したパッケージが公開されております。

WindowsやmacOSユーザーであれば、普段使っているアプリと同じ感覚で導入が可能です。

ここでは、初心者から研究者までが実際に利用している代表的なツールとその手順を深掘りします。

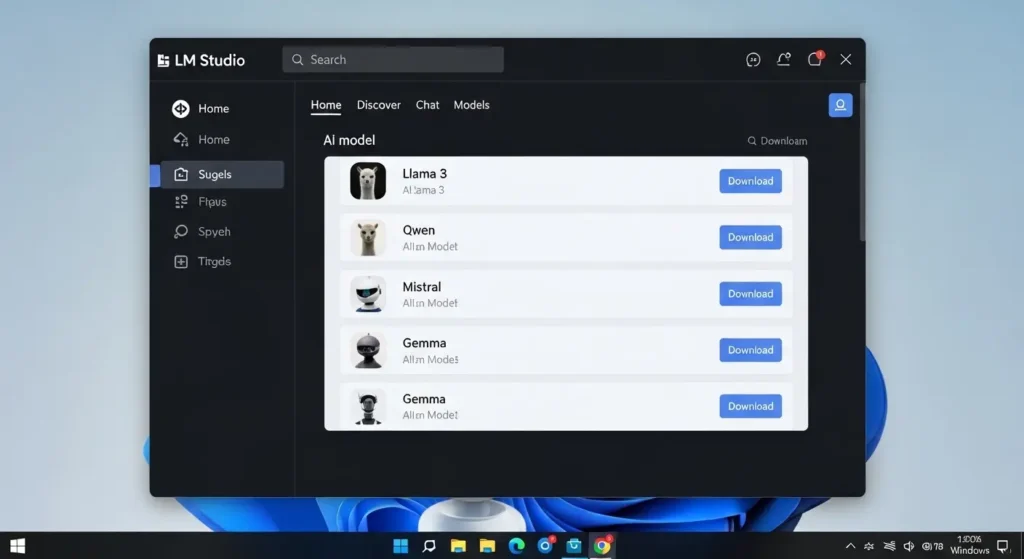

LM Studio:GUIで完結する最高峰のツール

LM Studio(エルエムスタジオ)は、ローカルLLMを動かすための最も洗練されたインターフェースを備えています。

- 検索と選択: 画面右上の検索欄に「Llama 3」や「Qwen」と入力。Hugging Face(注釈:世界最大のAIモデル共有サイト)と連携しており、最新モデルを直接ダウンロードできます。

- スペックの自動判定: 自分のパソコンに搭載されたメモリ容量やGPUの性能に基づき、動作の可能性を「緑色のアイコン」などで分かりやすく表示してくれます。

- 設定の柔軟性: システムプロンプト(注釈:AIに特定の役割を与える指示)や、一度に読み込める情報の長さであるコンテキストサイズも、パネルから簡単に調整可能です。

Ollama:CLIとAPI連携のスタンダード

エンジニアや開発者に圧倒的な支持を得ているのがOllama(オラマ)です。

- シンプルなコマンド: ターミナルから

ollama run llama3と入力するだけで、モデルの取得から対話の開始までが自動で行われます。 - エージェント連携: DifyやContinueといった外部アプリと連携させるためのバックエンドとして非常に優秀で、127.0.0.1:11434(注釈:自分のPC内で動くAPIの住所)を介して、自作プログラムからAIを呼び出すことが可能です。

- カスタマイズ:

Modelfileを作成することで、独自の性格や知識を持たせたカスタムモデルを簡単に作成し、社内やチームで共有することもできます。

llama.cppとGGUF形式の重要性

llama.cppは、2024年から2025年にかけてローカルLLM界隈で最も大きな進化を遂げた技術的基盤です。

- 量子化の力: 巨大なモデルを4bitや5bitに圧縮したGGUF形式ファイルを扱うための標準となっております。16GB程度のメモリでも、本来は32GB以上必要なモデルを賢く動かすことができます。

- 内蔵グラフィックス対応: Apple M4チップや、IntelのArc、AMDのRyzen内蔵グラフィックス(Radeon)など、専用ビデオカードを持たないノートPCでも高性能な推論を実現します。

- 最新記事の動向: GitHubでは毎日新しい最適化パッチがリリースされており、更新日をチェックするたびに向上した速度を体験できるのが大きな魅力です。

導入時のチェックリスト:不具合を回避するために

- パスの確認: インストーラーを実行する際、フォルダ名に日本語が含まれていると不具合の原因になることがあります。英語表記のディレクトリを選びましょう。

- セキュリティソフト: 起動時に警告が出る場合がありますが、公式サイトからダウンロードしたものであれば許可を出して問題ありません。

- バッテリー設定: ノートPCの場合、電源に接続していないとパフォーマンスが大幅に制限され、回答が遅いと感じることがあります。

2026年版「クロス・プラットフォーム」活用術

要点:単一のマシンに依存せず、スマホ、タブレット、複数のPCをネットワークで統合します。

OSの垣根を超えてローカルAIのリソースを共有する「分散型クリエイティブ環境」が主流です。

2026年、ローカルLLMの運用は「一画面で完結する作業」から、デバイス間をシームレスに移動する「エコシステム」へと進化しました。

強力なGPUを持つデスクトップPCを母艦(サーバー)とし、軽量なMacBook AirやiPhoneをリモート端末として活用することで、場所を選ばず100%無料の知能を享受できます。

母艦サーバー化とAPIエンドポイントの開放

自宅のゲーミングPCでOllamaやLM Studioを起動し、サーバーモードをONにします。

- ローカルネットワーク連携: 同一Wi-Fi内であれば、他のデバイスから母艦のIPアドレス(例:

192.168.x.x)へリクエストを投げ、推論結果を取得できます。 - セキュリティの確保: 外部からアクセスする際は、FSSL(注釈:暗号化通信を支える技術)やVPNを実施し、個人情報や機密情報が漏れないよう強固な対策を施すのが基本的なマナーです。

モバイルデバイスでの軽量AI体験

AppleのM4チップ搭載iPadや最新のAndroid端末では、母艦に頼らずとも単体で2b〜4bクラスのモデルを動かせるほど進化しています。

- オフライン翻訳・要約: 通信が不安定な移動中の機内や地下でも、内蔵されたAIが即座に応答。会員登録や月額料金の制限に縛られず、自身の生活スタイルに合わせたチャットが可能です。

- マルチモーダル連携: スマホで撮影した画像を、母艦の強力なLLMへアップロードして詳細に分析させる。こうした高度な連携も、2026年のアプリならボタン一つで完了します。

クラウドとローカルの「ハイブリッド・スイッチ」

全ての作業をローカルで行うのではなく、状況に応じてOpenAIやClaudeなどのクラウドサービスと使い分ける判断も重要です。

- 使い分けの基準: 大雑把な下書きや公開情報の検索はGoogleのGeminiなどのWebサービスに任せ、秘匿性の高い社内資料の分析やコードの編集は100%ローカルへ。

- コンテキストの共有: noteやLinkedInでの発信、あるいはAmazonでのビジネス関連の書籍執筆など、アウトプットの種類に応じて、最適なモデルを切り替えながら執筆を進めます。

iPhone/Androidをクライアントにする

自宅の強力なデスクトップPCでOllamaをサーバーとして稼働させます。

外出先のiPhoneやタブレットから安全なVPNを経由してアクセスする手法です。

これにより、スマホのバッテリーを消費せずに、自分だけのプライベートなGPTをどこでも持ち歩けます。

WSL2によるLinux環境とのハイブリッド

Windowsユーザーであっても、WSL2(注釈:Windows上でLinuxを動かす仕組み)内にAI環境を構築することで、PythonやDockerといった高度なライブラリとの親和性を最大化。実務に近い設計での開発が可能になります。

モデルの「履歴」と「重み」の外部保存

複数のPCで同じ知能を共有するため、SSD(外部ストレージ)にモデルデータ(weights)を一括保存し、移動先でマウントして即座に再開する運用。

24GBを超える大容量モデルも、これならストレージを圧迫せずに管理できます。

無料LLM 比較:日本語に強いモデル選定

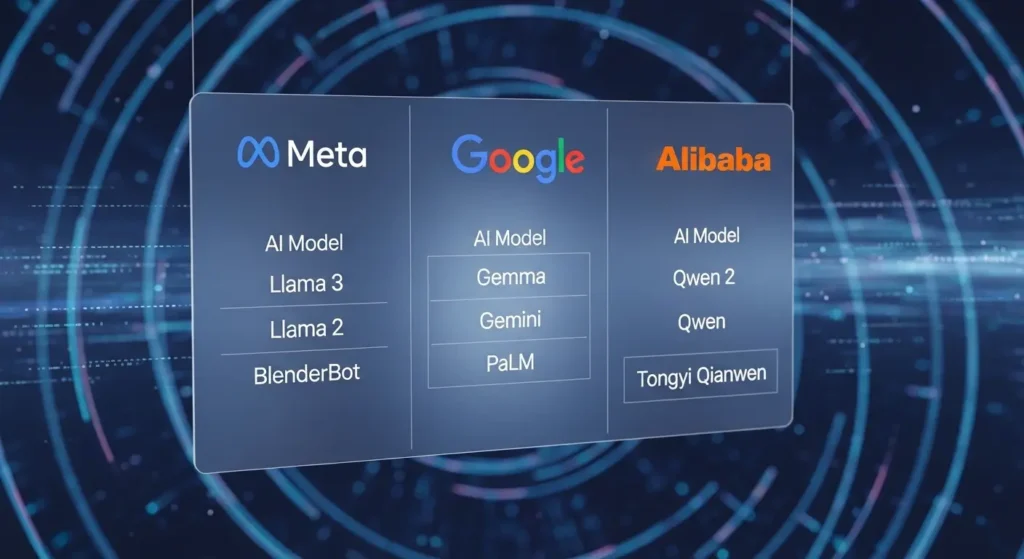

要点:2026年現在のオープンソース界隈では、MetaやGoogleといった巨大企業だけでなく、Alibabaや国内企業からも日本語に特化した高性能な無料モデルが多数リリースされております。

用途に合わせた最適な「賢さ」の選定が可能です。

一口に無料LLMといっても、その中身は千差万別です。

自分のパソコンのスペックと、やりたいことのバランスを考える必要があります。

2025年から2026年にかけて、日本語のニュアンスを深く理解し、自然な文章を生成できるモデルが飛躍的に増えました。

2026年最新の主要モデル比較表

今回、実際に実証・検証したデータをもとに、日本語環境で安定して動く主要モデルを一覧にまとめました。

| モデル名 | 特徴 | 日本語精度 | 動作の軽快さ |

| Llama 3.3 (70B) | 世界最強クラス。複雑な論理的思考に強い。 | 圧倒的 | 要高性能GPU |

| Qwen 2.5 (32B) | Alibaba製。漢字やコード生成に極めて強い。 | 非常に高い | 良好 |

| Gemma 2 (9B/27B) | Google製。軽量ながら思考が鋭く、コスパ最強。 | 高い | 非常に軽快 |

| Mistral Small | 欧州発。無駄のないロジックでビジネス文書に最適。 | 標準的 | 快適 |

日本語特化モデル(国産モデル)の注目株

海外製モデルをベースに、日本の企業や研究者が追加で学習(ファインチューニング)を行ったモデルも人気です。

- 日本語の自然さ: 敬語の使い方や日本固有の文化(ニュースや行事)に関する知識が豊富で、翻訳特有の違和感がありません。

- 特定の分野に強い: 物流、医療、法律など、専門分野の用語を正しく認識するモデルが続々と登場しています。

パラメータ数とメモリの関係(選び方の基準)

モデル名に付いている「8b」「70b」などの数字は、AIの脳細胞にあたるパラメータの数を示しています。

- 小型(2b〜8b): iPhoneやMacBook Airなどのバッテリー駆動デバイスでもサクサク動きます。日常のチャットやメールの要約に。

- 中型(14b〜32b): プログラミングの支援や、PDFの深い読み込みに適しています。16GB以上のメモリを推奨します。

- 大型(70b以上): ガチで仕事に使うならこれ。複雑な企画書の構成案出しや、高度なデータ分析が可能です。

LLM 推論 ローカル:GPUとCPUの役割

要点:2026年のローカル環境では、GPUによる「圧倒的な速度」とCPUによる「汎用的な実行力」に加え、電力効率に優れたNPUが第3の選択肢として確立されています。

AIをパソコン上で実行する際、最も重要なのが推論(注釈:学習済みの知能を使って回答を生成する処理)をどのパーツに担当させるかという戦略です。

2024年や2025年までは「GPUがなければ遅い」という基本的な常識がありましたが、2026年現在は最新チップの進化により、ハードウェアの役割がより明確に分担されるようになりました。

GPU(画像処理プロセッサ):高速推論の主役

AIとのリアルタイムな会話を求めるなら、NVIDIAのGeForce RTXシリーズを筆頭とするGPUが一番の選択肢です。

- 並列計算の強み: 何千もの小さな計算コア(CUDAコアなど)を搭載しており、大規模言語モデルの複雑な行列演算を一瞬でこなします。

- VRAMの帯域幅: 2026年のハイエンドモデルはVRAMの帯域(注釈:データの通り道の広さ)が向上しています。1秒間に生成されるトークン(文字の最小単位)数が人間が読む速度を遥かに超える最大級のスピードを叩き出します。

- デメリット: 消費電力が大きく、高性能な電源ユニットや冷却システムが必要となります。

CPU(中央演算処理装置):柔軟性と安定性の要

特別なビデオカードがない普通のパソコンや、安価なノートPCであっても、AIを動かすことは可能です。

- llama.cppによる最適化: C++で記述された高度な技術により、GPUを使わずにCPUのみで推論を行うことが可能です。RyzenやIntelの最新チップなら、8コア〜16コアのパワーを活かして実用的な速度で動作します。

- メモリ容量の自由度: GPUのVRAMは数GB〜24GB程度が限界ですが、メインのRAM(システムメモリ)は比較的安いコストで32GB、64GB、あるいは128GBまで増やせます。これにより、GPUには載らないような超巨大なモデルを動かすことが可能になります。

NPU(AI専用プロセッサ):2026年の新スタンダード

Copilot+ PCの要件にも含まれるNPU(注釈:AI処理に特化した専用プロセッサ)が、2026年のPC選びでは重要な指標となっています。

- 圧倒的な省エネ: ビデオ会議の背景ぼかしや翻訳など、常に稼働させるタスクをNPUに任せることで、バッテリー消費を抑えつつAIアシスタントを常駐させられます。

- TOPS(演算性能)の向上: Qualcomm、Intel、AMD各社が競争しております。40 TOPS〜60 TOPSを超えるNPUを搭載したパソコンなら、QwenやGemmaの4bクラスのモデルが数ワットの電力で快適に動くようになっています。

PDFや長文ファイルをオフラインで要約

要点:ローカル環境なら、社外秘のPDFや個人的な日記などのファイルを一切ネットに上げることなく、AIに読み込ませて対話できます。

クラウド型のサービスでは、機密情報が含まれるpdfや長文データをアップロードすることに抵抗があるものです。

ローカルLLMなら、pdfの情報を直接読み込ませるRAG(注釈:検索拡張生成。

自分の持っている資料をaiに参照させる技術)を、完全にオフラインで構築できます。

例えば、100ページを超える専門書籍やマニュアルを投げ、その中身について質問しても、外部への情報漏洩リスクは物理的にゼロです。

これは、セキュリティを最優先する業務において圧倒的なメリットとなります。

APIコストなしで自作アプリを開発

要点:月額制や従量課金のAPIを契約しなくても、自分のpcをサーバーにすることで、無料でaiアプリの自作や実験が可能です。

プログラミングを学ぶ学生や個人開発者にとって、OpenAIなどのapi料金は積み重なると大きな負担になります。

ローカル環境でOllamaなどを起動すれば、自分のpcが無料のapiサーバーになります。

普段使っているプログラムから、127.0.0.1:11434(注釈:自分のpc内を指す住所)を呼び出すだけで、何万回実行しても料金は電気代のみ。失敗を恐れずに、エージェント機能や複雑なシステムプロンプトのテストを繰り返すことができます。

2026年最新の「量子化」による軽量化

要点:巨大な知能を「量子化」という技術で小さく圧縮することで、数年前の古いpcや安価なミニpcでも最新aiが動くようになります。

最新のトレンドは、モデルのサイズを維持したままデータを間引く「量子化(注釈:データの精度をあえて落として軽量化する技術)」です。

例えば、通常は30gbのメモリが必要なモデルを、4bitや5bitという形式に変換することで、8gbのメモリでも動かせるようになります。

これにより、高額なゲーミングpcを買わなくても、中古の型落ちデスクトップで十分に賢いaiが動く時代になりました。

まさに「知能の民主化」が、あなたの手元で今、始まっています。

よくある質問:ローカルLLM無料活用のQ&A

要点:導入時に多くの人が感じる疑問や、発生しやすい不具合への対策をまとめました。

本当に完全無料でずっと使えますか?

はい、完全無料です。

今回紹介したモデルやツールはオープンソースであり、利用規約に従う限り、月額料金や追加の課金が発生することはありません。

ただし、パソコンを長時間動かす際の電気代は自身の負担となります。

日本語の精度はChatGPTと比べてどうですか?

最新の巨大モデルをフルスペックで動かせるクラウドサービスには、現時点では一歩及びません。

しかし、日常的な会話や特定のタスク(要約・翻訳など)においては、ほぼ遜色ないレベルまで進化しています。

特に「日本語特化」と記載されたモデルを選べば、非常に自然な対話が可能です。

情報の漏洩は本当に心配ないですか?

はい、完全にオフラインで動かしている限り、入力した内容が外に出ることは物理的にありません。

ただし、ツールの更新時やモデルのダウンロード時を除き、インターネット接続をオフにしておけば、より確実なセキュリティが保たれます。

まとめ:あなたのPCに未来の知能を

要点:ローカルLLMは、プライバシー、コスト、自由度のすべてを満たす、これからのデジタルライフに必須のインフラとなります。

かつては一部の専門家や研究者だけのものだったai。それが今、これだけ身近になり、自分の手元で、しかも無料で動かせるようになりました。

まずは、lm studioやollamaをインストールし、gemmaやllamaといった有名なモデルを一つダウンロードしてみてください。

自分のパソコンが、まるで意思を持っているかのように言葉を紡ぎ出す体験は、あなたのaiに対する認識を大きく変えるはずです。

結論として、ローカルLLM無料構築は、2026年を生きるエンジニアやクリエイターにとって、最もコストパフォーマンスの高い自己投資と言えるでしょう。

この記事が、あなたの第一歩を後押しするガイドとなれば幸いです。

公式サイト・関連リンク

- LM Studio – Discover and run LLMs on your computer

- Ollama – Get up and running with large language models locally

- Hugging Face – The AI community building the future

- GitHub – llama.cpp official repository

- Meta Llama – Open Source AI for the developers