情報システム部門の担当者、セキュリティ担当者、そしてIT管理者の皆様、Copilot for Microsoft 365の導入は、組織の生産性を飛躍的に向上させる一方で、「データ保護とセキュリティはどうなるのか」という懸念を抱えていませんか?

Windowsを初めて使用する方から、日々複雑なクラウド環境を管理されている方まで、共通する最大の課題は、AIがアクセスする組織の機密情報をどのように制御し、Copilot for Microsoft 365 データ保護設定を最適化するかという点です。

Microsoftは、Copilotの設計において、お客様のデータが大規模言語モデル(LLM)のトレーニングに使用されることは決してないと厳格にコミットしています。

しかし、Copilotが組織のデータにアクセスする仕組みを理解しておきましょう。

既存のセキュリティ・コンプライアンス設定を再点検・強化することは、IT管理者の責務です。

今回の記事では、

- Copilotの基本原理

- Microsoft Entra IDやMicrosoft Purviewを活用した具体的なセキュリティ設定

- データ漏洩対策

そして2025年最新のコンプライアンス動向まで、深く掘り下げて解説します。

この完璧なコンテンツを通じて、貴社がAI時代における情報保護のベストプラクティスを確立しましょう。

自信を持ってCopilotを展開できるよう、徹底的に支援します。さあ、AI時代のデータ保護を網羅した完全ガイドを読み進めましょう。

- Copilot for Microsoft 365とデータ保護の基礎概念

- Microsoft 365 Copilot セキュリティ設定: 制御とアクセス管理

- Microsoft 365 Copilot コンプライアンス: 規制と監査への対応

- Microsoft 365 Copilot データ漏洩対策: 事前防止とリスク軽減

- Microsoft 365 Copilot情報保護: Purviewの統合的活用

- Microsoft 365 Copilot 設定ベストプラクティス: 組織展開の指針

- 2025年最新のCopilot データ保護動向と将来像

- よくある質問と回答

- まとめ: データ保護と設定の鍵

- 🔗 サイト外リンク

Copilot for Microsoft 365とデータ保護の基礎概念

要点: Copilot for Microsoft 365は、組織の既存のセキュリティとコンプライアンス設定をそのまま継承します。

データアクセスは「ユーザーが見られる情報のみ」に厳格に制限されるため、適切なアクセス制御がデータ保護の鍵となります。

Copilotの動作原理とデータ保護のコミットメント

Copilot for Microsoft 365は、単なる大規模言語モデル(LLM)の機能ではありません。

これは、ユーザーの「仕事」を支援するためにMicrosoft 365エコシステム全体に組み込まれたAIアシスタントです。

その動作には、特にセキュリティとプライバシーを確保するための厳格な設計が施されています。

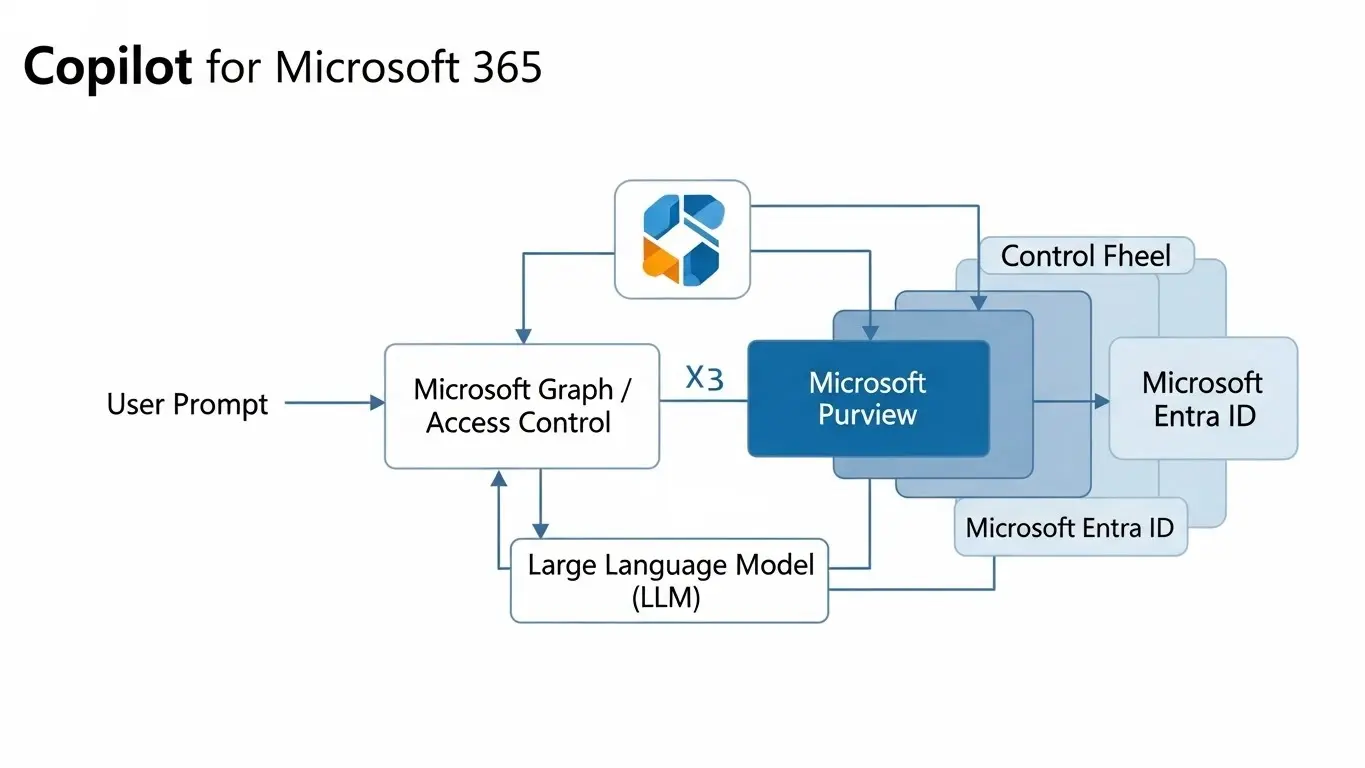

- Microsoft Graphの活用: Copilotの応答は、Microsoft Graphを通じて取得される組織のデータ(電子メール、ファイル、チャット、カレンダーなど)に基づいて生成されます。このGraphが、ユーザーの作業コンテキストを理解し、関連情報を提供する役割を担います。

- 組織の境界: Copilotは、個人のMicrosoft 365アカウントの境界内で動作します。Copilotがプロンプトに応答する際に使用する情報、すなわちコンテンツは、プロンプトを入力したユーザーが既にアクセス許可を持っているデータのみに限定されます。この設計原則は、Microsoftが長年提供しているエンタープライズ向けのデータ保護ポリシーをそのまま継承しています。

- プライバシーの厳格な維持: Microsoftは、Copilotの使用を通じて生成されたプロンプト、応答、コンテンツが、基盤となるLLMのトレーニングに利用されることは一切ないと明記しています。このコミットメントは、お客様のデータがAIモデルの向上に勝手に使用されるという懸念を根本的に解消します。

注釈: Microsoft Graph Microsoft 365、Windows、Enterprise Mobility + Securityのデータ、インテリジェンス、および接続を統一して提供するAPIおよび開発者サービスのことです。Copilotがユーザーのコンテキストを理解し、必要な情報に安全にアクセスするための基盤となります。

Microsoft 365 Copilotデータ保護の基本原則

Copilotのデータ保護の基盤は、お客様の組織が既に設定しているセキュリティポリシーに依存しています。

- アイデンティティとアクセス制御: ユーザーのCopilotへのアクセス権は、Microsoft Entra ID(旧Azure AD)によって制御されています。ユーザーがサインインし、ライセンスを付与されている場合にのみ、サービスを利用できます。注釈: Microsoft Entra ID Microsoftが提供するクラウドベースのアイデンティティおよびアクセス管理サービスです。ユーザー認証やアクセス許可の管理を行う、組織のセキュリティの要です。

- 既存のセキュリティ継承: Copilotは、Microsoft 365の既存のアクセス制御、つまり誰がどのファイルを見られるかという権限設定をそのまま継承します。これは「ユーザー アクセス制御」の原則に基づいており、Copilotはユーザーに代わって「ユーザーが見られる情報」のみを検索し、その情報に基づいて応答を生成します。

- コンプライアンスの自動適用: Microsoft Purviewで設定されている情報保護ポリシー(データ損失防止: DLP、秘密度ラベルなど)が、Copilotによって生成されたコンテンツにも自動的に適用されます。これにより、AIが生成した要約やコンテンツが、意図せず機密情報を含んで外部に共有されるリスクを軽減します。注釈: Microsoft Purview Microsoft 365全体のデータガバナンス、リスク管理、コンプライアンスに対応するためのソリューション群です。情報保護、データライフサイクル管理、監査などを一元的に行います。

潜在的なリスクとIT管理者の責任

Copilotの設計は堅牢ですが、情報システム部門の担当者、セキュリティ担当者、およびIT管理者には、引き続き重要な責任があります。

- 過剰なアクセス許可: Copilotの回答は、ユーザーがアクセス可能な情報に依存します。もしユーザーが本来必要のないファイルやサイトに過剰なアクセス権を持っている場合、Copilotはその情報を使用して回答を生成する可能性があります。結果として、意図しない情報漏洩につながるリスクがあります。

- シャドーIT: Copilotの導入により、従業員が「Copilotで解決できる」と誤って判断し、組織の管理外の外部AIツールやサービスに機密情報を入力してしまうシャドーITのリスクが軽減されます。しかし、従業員教育とCopilotの適切な利用方法の周知が引き続き必要です。

- プロンプトインジェクションへの対応: ユーザーがCopilotの「ガードレール」を回避する目的で設計された悪意のあるプロンプト(脱獄)を送信し、制限された情報へのアクセスを試みる可能性があります。Microsoftはこれらに対する対策を講じていますが、継続的な監査と監視が求められます。

Microsoft 365 Copilot セキュリティ設定: 制御とアクセス管理

要点: Copilotのセキュリティ管理は、Microsoft Entra IDのアクセス制御を基盤とし、SharePointサイトの権限、Microsoft Purviewの情報保護を適用することで、多層的にデータへのアクセスを制御します。

Microsoft Entra IDによるユーザーとライセンスの管理

Copilotの利用を制御する最も基本的な設定は、ユーザーのアイデンティティとライセンスの管理にあります。

- ライセンスの割り当て: Copilot for Microsoft 365のライセンスを付与されていないユーザーは、サービスを利用できません。情報システム部門の担当者は、対象となるユーザーにのみライセンスを割り当てる必要があります。

- 条件付きアクセス: Microsoft Entra IDの「条件付きアクセス」ポリシーを適用することで、特定のセキュリティ条件を満たさないユーザーやデバイスからのCopilotアクセスを制限できます。例えば、特定の地域からのアクセスや、多要素認証(MFA)を有効にしていないデバイスからのサインインをブロックする設定が可能です。

注釈: 多要素認証 (MFA) ユーザーがサインインする際に、パスワード以外に、スマートフォンへのコード送信や生体認証など、複数の要素を用いて本人確認を行うセキュリティ手法です。情報漏洩防止に非常に有効です。

SharePointとOneDriveのアクセス制御強化

Copilotが最も多く参照するデータソースは、SharePointとOneDriveに保存されているファイルです。これらのアクセス制御が適切でないと、データ漏洩のリスクが高まります。

- 最小権限の原則: ユーザーがアクセスできるファイルやサイトは、業務遂行に必要な最小限の範囲に制限する「最小権限の原則」を徹底します。不要なアクセス権は直ちに削除し、定期的に監査を行う必要があります。

- サイトの公開設定確認: SharePointサイトの「パブリック」設定や、OneDriveファイルの「組織内の全員に共有」設定は、Copilot経由での情報漏洩に直結します。これらの共有設定を厳格に制御し、「秘密」または「特定グループのみ」に制限することが推奨されます。

- 機密情報サイトの分離: 特に機密性の高い情報(人事評価、経営戦略、未公開の製品情報など)を保存するSharePointサイトは、一般のサイトとは分離します。アクセス制御をさらに厳格化することが重要です。

Copilotアクセス制御のオプション

Microsoftは、管理者向けにCopilotの機能自体を制御するオプションも提供しています。

- Copilotのオン/オフ制御: Microsoft 365管理センターから、テナント全体、または特定のグループに対してCopilot機能を有効/無効に設定できます。段階的な展開や、特定の部署への制限に役立ちます。

- Bingとの連携制限: Copilotの応答には、Microsoft 365の内部データだけでなく、Bing検索を通じて最新の情報や公開Webデータを含めることが可能です。組織のポリシーによっては、Bing検索との連携を制限するオプションを検討することも可能です。

Microsoft 365 Copilot コンプライアンス: 規制と監査への対応

要点: Copilotは、Microsoft Purviewのコンプライアンス管理機能を完全に継承します。

GDPR、HIPAAなどの規制要件に対応可能です。

特に、データ損失防止(DLP)と電子情報開示(eDiscovery)の設定確認が重要です。

データ損失防止(DLP)ポリシーの適用

データ損失防止(DLP)は、機密情報が組織外に誤って送信されたり、不適切な方法で共有されたりすることを防ぐための最も重要なコンプライアンス設定です。

- DLPの自動継承: Copilotは、Exchange、SharePoint、OneDrive、Teamsなどに既に適用されているDLPポリシーを継承します。例えば、Copilotが電子メールの下書きを作成する際に、DLPポリシーに違反する機密情報(クレジットカード番号、マイナンバーなど)が含まれている場合、Copilotはその情報を自動的に削除するか、下書きの送信をブロックします。

- カスタムDLPルールの調整: 組織固有の機密情報識別子(プロジェクトコード、特定の顧客情報など)をPurviewで定義している場合、これらのカスタムルールがCopilotによるコンテンツ生成と共有にも適用されることを確認してください。Copilotの使用シナリオに合わせて、ルールの「厳格度」を調整する必要があるかもしれません。

注釈: GDPR 欧州連合(EU)で施行されている一般データ保護規則のことです。個人のデータ保護とプライバシーに関する非常に厳格なルールを定めています。多くのグローバル企業が準拠を求められています。

秘密度ラベルによる情報の分類と保護

秘密度ラベルは、文書や電子メールの機密レベルを分類し、それに応じてアクセス制限や暗号化などの保護措置を自動的に適用するPurviewの情報保護機能の中核です。

- ラベルの自動適用: Copilotが生成した要約やコンテンツに、ソースとなったドキュメントの秘密度ラベルが自動的に継承・適用されるかを確認します。例えば、「極秘」ラベルの付いたドキュメントをCopilotが要約した場合、その要約結果にも「極秘」ラベルが付き、組織外への共有がブロックされる必要があります。

- ラベルの展開: 秘密度ラベルが組織全体で適切に展開され、従業員によって正しく使用されていることを確認します。ラベルが適切に設定されていないドキュメントは、Copilot経由で不適切に共有されるリスクがあります。

監査と電子情報開示(eDiscovery)への対応

規制遵守や法的要件に対応するため、Copilotの利用状況やデータアクセス履歴は監査可能です。

- 監査ログの記録: Copilotによるユーザーのプロンプト、応答、Copilotがアクセスしたデータソースなどのアクティビティは、Microsoft 365監査ログに詳細に記録されます。これにより、誰が、いつ、どのような情報をCopilotに問い合わせたかを追跡できます。

- eDiscoveryの適用: 法的調査や訴訟対応が必要な場合、Purviewの電子情報開示(eDiscovery)機能を使用して、Copilotの利用に関連するデータ(プロンプトや生成された応答)を検索、保持、収集、およびレビューすることができます。Copilotのアクティビティは、他のMicrosoft 365ワークロードと同様に「対象」となります。

Microsoft 365 Copilot データ漏洩対策: 事前防止とリスク軽減

要点: データ漏洩を防止するためには、Microsoft Purviewの機能を用いたアクセス制御とデータ分離の徹底、そして従業員に対する適切な情報保護トレーニングが最も効果的な対策となります。

データ分離とアクセス境界の強化

Copilotの安全性を最大限に高めるには、データへのアクセス境界を厳格に定義します。

不要なデータへのアクセスを排除することが重要です。

- Information Barriersの適用: 金融機関や規制業界など、特定のグループ間の情報共有を法的に制限する必要がある組織では、Microsoft PurviewのInformation Barriers(情報障壁)機能を使用して、Copilotを含むコミュニケーションとデータアクセスを制限できます。これにより、意図しない組織内での情報漏洩を防止します。

- OneDriveのアクセス制限: 従業員個人のOneDrive内に機密情報が保存されていないかを確認し、必要に応じて、特定の種類や秘密度ラベルの付いたファイルは組織内でのみ共有可能とする制限を適用します。

- 外部共有設定の確認: SharePointとOneDriveの「外部共有」設定が、組織のセキュリティポリシーに沿っていることを再確認します。Copilotが参照する内部データが、意図せず外部のゲストユーザーなどに共有されるリスクを防ぐためです。

注釈: Information Barriers(情報障壁) 組織内のユーザーグループ間で、通信とコラボレーションを法的に制限するためのコンプライアンスソリューションです。例えば、トレーダーとアナリスト間の情報共有を禁止するなどの用途があります。

データ漏洩リスクを軽減するエンドポイント保護

Copilotによる生成物をユーザーが自分のデバイスにダウンロードしたり、コピー&ペーストしたりする際のデータ漏洩リスクにも備える必要があります。

- Microsoft Defender for Endpointとの連携: Microsoft Defender for Endpoint(MDFE)は、デバイスからのデータ漏洩を防止する機能を提供します。Copilotによって生成された機密情報が、MDFEによって監視されているかどうか、またはUSBドライブへのコピーなどの行為がブロックされるかを確認します。

- Windows Information Protection(WIP): Windows Information Protection(WIP)は、個人データと組織データを分離し、組織のデータが個人所有のアプリやクラウドサービスにコピーされるのを防ぎます。Copilotの使用環境全体にWIPポリシーを適用することで、生成された情報が保護されます。注釈: Windows Information Protection (WIP) 組織のデータを保護するために、Windows 10以降のデバイスで、組織のデータと個人データを分離するためのMicrosoft Intuneのポリシーです。

従業員への情報保護教育とガイドライン

技術的な設定だけでなく、Copilotの利用に関する従業員教育は、データ漏洩対策の要です。

- 「ゴミイン・ゴミアウト」の原則: Copilotは、提供されたデータ(プロンプトとアクセス可能な組織データ)に基づいて応答を生成します。不正確な情報や機密情報を含んだプロンプトを入力した場合、意図しない応答やデータ漏洩に繋がる可能性があることを教育します。

- 機密情報の取り扱い: 組織の秘密度ラベルポリシーに基づいて、Copilotに機密情報を含むプロンプトを入力する際の注意点や、Copilotによって生成された機密性の高い要約を外部に送信してはいけないことを明確にガイドラインに定めます。

- フィードバックの活用: ユーザーがCopilotの応答に不正確さや懸念事項を見つけた場合、すぐにIT部門に報告し、Microsoftにフィードバックするよう促す仕組みを構築します。これにより、システムの改善とリスクの早期発見に繋がります。

Microsoft 365 Copilot情報保護: Purviewの統合的活用

要点: Copilotの情報保護は、Microsoft Purviewのコンプライアンス管理機能を完全に継承・統合しています。

秘密度ラベルとDLPポリシーを適切に設定することで、生成AI時代においても情報保護を確保します。

Purviewによる秘密度ラベルの深化

秘密度ラベルは、データがどこに移動しても保護を継続するための鍵となる技術です。

Copilotの時代において、その適用範囲を深化させる必要があります。

- 既定の秘密度ラベル設定: 編集可能なすべての場所に秘密度ラベルが設定されるよう、既定のラベル設定を強制します。これにより、Copilotが参照するすべてのファイルが、あらかじめ組織の情報保護ポリシーに準拠した状態であることを保証します。

- カスタム秘密度ラベルの適用: 組織固有の極秘情報や、法的に保護が必要な情報に対応するため、カスタム秘密度ラベルを正確に定義し、Copilotのコンテンツ生成時にそれらが確実に継承されるかどうかの定期的な監査を行います。

- 二重分類の防止: 同じドキュメントに複数の秘密度ラベルが付与されることによる混乱を防ぐため、ラベルの優先順位付けと、ラベル変更時の履歴追跡を徹底します。

Microsoft PurviewでのDLPポリシーの最適化

Copilotの利用拡大に伴い、DLPポリシーは「外部共有の防止」だけでなく、「生成AIによる意図しない情報漏洩」にも対応する必要があります。

- 新しいワークロードへの適用: DLPポリシーが、Copilotが使用されるすべてのワークロード(Teamsチャット、Outlookメール、Word、Excelなど)に漏れなく適用されていることを確認します。特にCopilot for Microsoft 365 Chatのエクスペリエンスは、新しいワークロードとして分類される場合があるため、ポリシーの適用範囲を確認します。

- エンドポイントDLPとの連携強化: デバイス上でCopilotの応答をコピー&ペーストする行為も、エンドポイントDLPによって監視し、機密性の高い情報を含む場合は自動的にブロックまたは警告を発するように設定を強化します。

- ポリシーヒントの活用: ユーザーが機密情報を含むプロンプトを入力しようとした際に、DLPポリシーヒントを表示し、情報漏洩リスクについて事前に警告を発する教育的な仕組みを導入します。これにより、従業員の情報保護に対する意識を向上させます。

Purviewによるデータライフサイクル管理

Copilotが参照するデータ自体のライフサイクル(保持と削除)も、情報保護とコンプライアンス遵守に不可欠です。

- 保持ポリシーの設定: 法的要件や規制に基づき、特定の期間、データを保持する必要がある場合、Purviewの保持ポリシーをSharePointやOneDriveの該当コンテンツに適用します。これにより、Copilotが参照するデータが誤って削除されることを防ぎます。

- 削除ポリシーの設定: 保持期間が終了したデータは、情報漏洩リスクを軽減するために適切に削除される必要があります。Copilotが古い、または不要な機密情報を参照しないよう、削除ポリシーの自動実行を確実にします。

Microsoft 365 Copilot 設定ベストプラクティス: 組織展開の指針

要点: Copilotの安全な展開には、

- 「段階的な導入」

- 「最小権限の原則の再徹底」

- 「包括的なエンドユーザー教育」

上記の3つを柱とするベストプラクティスに従うことが重要です。

展開前のデータ環境の準備と評価

Copilotの導入を成功させるには、まず組織のデータ環境が「Copilot対応」となっているかを入念に評価する必要があります。

- アクセス権の棚卸し: Copilot導入前に、SharePoint、Teams、OneDriveのアクセス権を徹底的に棚卸しし、最小権限の原則が守られているかを監査します。これが最も重要な事前準備であり、データ保護の根幹です。

- 機密情報分類の実施: Microsoft Purviewの秘密度ラベルを組織全体に展開し、機密性の高いファイルを分類します。これにより、Copilotが参照する情報の種類を管理しやすくなります。

- 組織内検索の最適化: CopilotはMicrosoft 365の検索機能を利用するため、検索結果が正確で関連性が高いことを確認します。不要なデータや古いデータが検索結果に表示されないよう、検索インデックスのクリーニングを実施します。

段階的な展開とフィードバックループ

全従業員に一斉に展開するのではなく、特定のグループや部署から段階的に導入します。

フィードバックを得ながら設定を最適化します。

- パイロットグループの選定: 情報システム部門、セキュリティ担当者、各部門のキーユーザーなど、影響を評価しやすい少数のグループ(パイロットグループ)を選定し、先行してCopilotの機能を利用してもらいます。

- 利用状況とログの監視: パイロット期間中、Copilotの使用状況、特に監査ログに記録されたプロンプトの内容とアクセスされたデータの種類を注意深く監視します。意図しないデータアクセスやコンプライアンス違反の可能性がないかを確認します。

- 設定の反復的調整: パイロットグループからのフィードバックやログ分析の結果に基づき、アクセス制御、DLPポリシー、秘密度ラベルの設定を反復的に調整し、より安全で効率的な設定を確立します。

エンドユーザー向け教育とガイドラインの公開

Copilotの真のデータ保護は、エンドユーザーの適切な利用方法に依存します。

包括的な教育資料と明確なガイドラインが不可欠です。

- プロンプトの安全性教育: 決してCopilotに機密性の高い個人情報や顧客情報を入力しないこと、応答の正確性を常に検証することなど、「安全なプロンプト」の作成方法を教育します。

- 情報保護の責任: Copilotが生成したコンテンツであっても、それを共有する際の情報保護の責任はユーザー自身にあることを強調します。秘密度ラベルの付け忘れや、外部への誤送信の危険性を理解させます。

- 社内Q&Aとサポート窓口: Copilotのセキュリティやデータ保護に関する疑問を気軽に問い合わせられるよう、社内Q&Aサイトや専用のサポート窓口を設置し、従業員の不安を解消します。

2025年最新のCopilot データ保護動向と将来像

要点: 2025年には、

- Microsoft Entra IDのセキュリティ機能強化

- PurviewのAI検出機能の高度化

そしてCopilot間の連携制御が最新のトレンドとなります。

Entra IDとセキュリティの統合強化

Microsoft Entra IDは、Copilotのセキュリティ基盤として、さらに高度な機能が統合されています。

- ID保護とアクセスレベルの動的調整: Entra ID Protectionは、ユーザーのサインインリスクレベルをリアルタイムで評価し、リスクが高いと判断された場合に、Copilotへのアクセス権限を自動的に制限またはブロックする動的なアクセス制御を可能にします。

- Entra IDのセグメンテーション: Entra IDの機能を利用して、組織内のユーザーやグループを論理的に分離する「ネットワーク セグメンテーション」の考え方を、クラウドアクセスにも適用します。これにより、Copilotが参照できる情報範囲を厳格に制限し、万が一の侵害時の影響範囲を最小限に抑えます。

Microsoft PurviewのAIコンプライアンス機能の進化

Purviewは、Copilotのような生成AIがもたらす新しいコンプライアンス課題に対応するため、機能が進化しています。

- AI生成コンテンツの自動検出: Purviewのデータ損失防止(DLP)機能が強化され、Copilotやその他の生成AIツールによって生成されたコンテンツに、組織の機密情報が含まれているかどうかを、より高度なパターン検出アルゴリズムで自動的に識別できるようになります。

- コンプライアンスマネージャーのCopilot対応: Microsoft Purview コンプライアンスマネージャーの評価項目に、Copilotのデータ保護設定に関する新しい推奨事項と評価が追加されています。これにより、IT管理者は組織がCopilotのコンプライアンス要件をどれだけ満たしているかを簡単に確認できます。

Copilotエコシステムと情報保護の拡張

今後は、CopilotがMicrosoft 365の枠を超えて他のサービスやデータソースと連携する「拡張Copilot」がトレンドとなります。

- Graphコネクタによる外部データ保護: Microsoft Graphコネクタを通じて、AWSやSalesforceなどの外部のデータソースをCopilotが参照するようになる可能性があります。この際、Purviewの情報保護ポリシーが、外部データに対してもシームレスに適用されるよう、コネクタレベルでのセキュリティ設定が重要になります。

- Copilot間の情報障壁: ユーザーが複数のCopilot(例: GitHub Copilot、Security Copilot)を使用する際、異なるCopilot間で機密性の高い情報が意図せず共有されないよう、Copilot間の情報障壁やデータフローの制御が、今後の大きな課題となることが予測されます。

よくある質問と回答

Copilotは顧客の機密情報を使ってトレーニングされますか?

要点: Microsoftは、Copilotのトレーニングに顧客のデータやプロンプトを使用しないことを厳格にコミットしており、お客様のデータは安全に保護されます。

Copilot for Microsoft 365が

- ユーザーのプロンプト

- プロンプトに基づいて生成した応答

- アクセスした組織のコンテンツ

上記を使用して、基盤となる大規模言語モデル(LLM)をトレーニングすることはありません。

この点は、Microsoftが提供する商用データ保護のコミットメントの核心であり、お客様のプライバシーとセキュリティを最優先しています。

お客様のデータは、お客様のMicrosoft 365テナント内にとどまります。

組織のアクセス制御とポリシーによって厳格に保護されます。

Copilotの応答が不正確だったり、機密情報を含んでいないか不安です。

要点: Copilotの応答は常に「ユーザーのアクセス権」に基づきますが、機密情報が含まれる可能性はゼロではないため、生成されたコンテンツの「検証」と「DLPの適用」が重要です。

Copilotは、ユーザーがアクセス許可を持っているデータのみを使用します。

つまり、本来見られるはずのない機密情報を提供することはありません。

しかし、ユーザーが意図せず機密性の高いドキュメントにアクセス権を持っており、それをCopilotが参照して応答を生成する可能性はあります。

- 検証の必要性: Copilotの応答はあくまで「下書き」や「要約」として扱い、最終的な利用や共有の前に、必ず人間の目でその正確性と機密性の有無を確認するよう、従業員に教育してください。

- DLPの適用: Microsoft Purviewのデータ損失防止(DLP)ポリシーを強化し、機密情報を含む応答が組織外に送信される前に自動的にブロックされるように設定することが最も効果的な技術的対策です。

既に設定しているSharePointのアクセス権はCopilotに影響しますか?

要点: はい、既に設定されているSharePointのアクセス権はCopilotの動作に直接影響します。

これはCopilotのデータ保護設計の根幹です。

Copilot for Microsoft 365は、ユーザーのMicrosoft Entra IDに基づき、そのユーザーがSharePoint、OneDrive、Teams、Exchangeなどで現在持っているアクセス許可を正確に継承します。

- 「アクセスできる情報のみ」: もしユーザーが特定のSharePointサイトのドキュメントにアクセスできなければ、Copilotはそのドキュメントを検索・参照して応答を生成することはできません。

- 棚卸しの重要性: したがって、Copilotの安全な運用のためには、組織内で「最小権限の原則」に基づき、ユーザーのアクセス権が適切かつ最小限に設定されていることを導入前に再確認する「アクセス権の棚卸し」が極めて重要になります。

Copilotの利用状況を監査ログで確認できますか?

要点: はい、

- Copilotの利用に関するプロンプト

- 応答

- アクセスデータソース

などの詳細なアクティビティは、Microsoft 365の監査ログに完全に記録・保持されます。

Copilot for Microsoft 365のアクティビティは、Microsoft 365の他のワークロード(Teamsでのチャット、Exchangeでのメール送信など)と同様に、Microsoft Purviewの監査ログ機能によって詳細に記録されます。

- 追跡の目的: IT管理者やセキュリティ担当者は、この監査ログを使用して、ユーザーがCopilotにどのようなプロンプトを入力したか、どのようなデータに基づいて応答が生成されたか、コンプライアンス違反の可能性がある行為がないかなどを追跡・調査することができます。

- eDiscoveryへの利用: この監査ログは、法的調査や電子情報開示(eDiscovery)の要件にも対応しており、必要に応じて特定の期間やユーザーのCopilot利用データを検索、保持、レビューすることが可能です。

まとめ: データ保護と設定の鍵

要点: Copilotのデータ保護は、組織が既に設定しているセキュリティ基盤を信頼し、その基盤の正確性をIT管理者が再確認・強化することが成功の鍵となります。

Copilot for Microsoft 365は、その設計自体が、データ保護とセキュリティを最優先に組み込んでいます。

ユーザーのプロンプトやデータがLLMのトレーニングに使われることはなく、アクセスできる情報はユーザーが持つ既存の権限に厳格に制限されます。

成功のための3つの行動ステップ

情報システム部門の担当者、セキュリティ担当者、IT管理者の皆様がCopilotを安全に導入し、その恩恵を最大限に受けるための具体的な行動ステップは以下の通りです。

- アクセス権の「ミニマム化」徹底: Copilot導入前に、SharePointサイトとOneDriveのアクセス制御を再監査し、「最小権限の原則」を徹底します。これがデータ漏洩を防止する最も根本的な設定です。

- Purviewポリシーの「Copilot対応」確認: 既存のDLPポリシー、秘密度ラベルが、Copilotによって生成される新しいコンテンツにも漏れなく適用されることを確認し、必要に応じてコンプライアンス要件に合わせて調整します。

- エンドユーザーへの「教育」投資: 従業員に対し、安全なプロンプト入力と、Copilotの応答を最終利用前に検証することの重要性を教育します。技術的なデータ漏洩対策とユーザーの責任をセットで周知します。

組織の未来とCopilot

Copilot for Microsoft 365は、従業員の生産性と創造性を劇的に向上させる強力なAIツールです。

しかし、その力を安全に、そして組織の情報保護ポリシーに準拠した形で利用するには、私たちIT管理者の適切な設定と継続的な管理が不可欠です。

本記事で解説したCopilot for Microsoft 365 データ保護設定のベストプラクティスを実践することで、貴社はAI時代の新しい働き方を、セキュリティの懸念なく推進することができるでしょう。

🔗 サイト外リンク

- Microsoft Entra ID 公式サイト: https://www.microsoft.com/ja-jp/security/business/identity-access/microsoft-entra-id

- Microsoft Purview 公式サイト: https://www.microsoft.com/ja-jp/security/business/microsoft-purview

- Copilot for Microsoft 365 の商用データ保護に関する Microsoft のコミットメント: https://learn.microsoft.com/ja-jp/copilot/microsoft-365/microsoft-365-copilot-privacy

- Microsoft 365 のセキュリティとコンプライアンスに関するドキュメント: https://learn.microsoft.com/ja-jp/microsoft-365/security/

- Microsoft Defender for Endpoint 公式サイト: https://www.microsoft.com/ja-jp/security/business/endpoint-security/microsoft-defender-endpoint