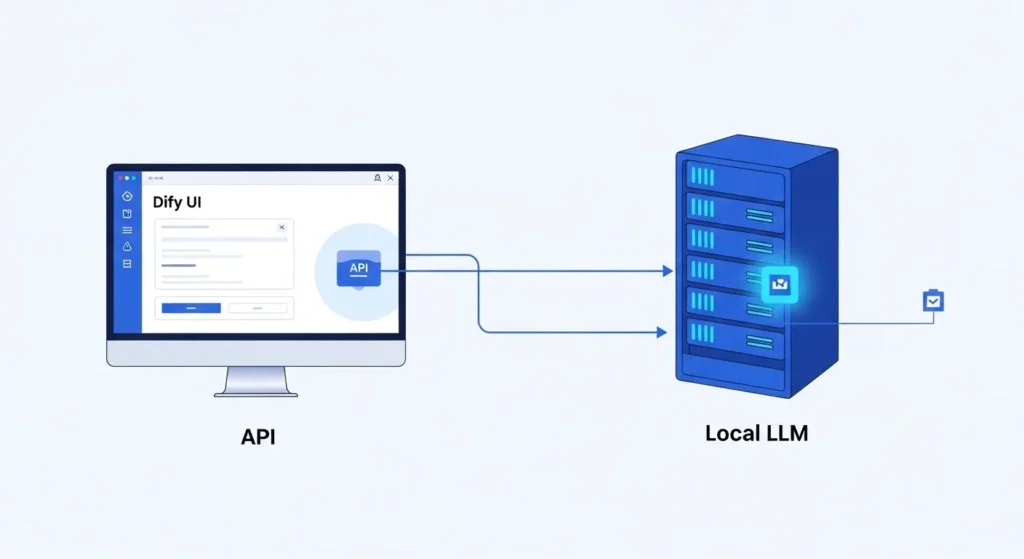

要点:2026年現在、DifyとローカルLLMの連携は、機密情報を外部に出さずに独自のAI環境を構築する最強の手法です。

セキュリティと自由度を両立するAI活用

Difyの使い方を調べているエンジニアの多くが直面するのが、クラウド型AIのコストとプライバシーの壁です。

OpenAIなどの外部サービスを使わずに、自社のPCやサーバー内で環境を完結させたいというニーズが2025年から急増しています。

今回の記事では、

- Docker(※2)を使用したDifyのインストール

- LM StudioやOllamaといった推論環境との連携手順

までを徹底解説します。

2026年の最新トレンドであるマルチモーダル(※3)対応や、RAG(※4)の高速化についても触れていきます。

(注釈 ※1)API:ソフトウェア同士が情報をやり取りするための窓口。

(注釈 ※2)Docker:アプリを動かすための箱(コンテナ)を簡単に作れるツール。

(注釈 ※3)マルチモーダル:テキストだけでなく、画像や音声も同時に扱えるAIの機能。

(注釈 ※4)RAG:AIが外部の知識を参照して、より正確な回答を生成する技術。

Difyの使い方とローカル環境構築のメリット

要点:ローカルでAIを動かす最大のメリットは、データが外部に漏れるリスクをゼロにし、API費用を削減できる点にあります。

オフラインで完結する安全なAI運用

Difyをローカルに導入すれば、インターネット接続なしでも生成AIを利用できます。

これは特に企業のDX(※5)において重要なポイントです。

業務で扱うデリケートなドキュメントをAIに学習(※6)させても、クラウドに送信される心配がありません。

2026年の最新推論環境

現在、LlamaやQwenといった大規模****言語モデルは、OllamaやLM Studioを使うことで、一般的なGPU(※7)を搭載したPCでも驚くほど高速に動作します。

設定は簡単で、プログラミングの深い知識がなくてもワークフローを作ることができます。

(注釈 ※5)DX:デジタル技術を使ってビジネスをより良く変革すること。

(注釈 ※6)学習:AIに新しい知識を覚えさせること。ローカルなら社外秘データも安心です。

(注釈 ※7)GPU:画像処理やAIの計算を得意とするパーツ。AIの速度を左右します。

Dify Dockerによるセットアップ手順

要点:WindowsやLinux環境でDifyを安定して稼働させるには、Docker Compose(※8)を利用したインストールが推奨されます。

Dockerを使った環境設定

まず、WSL(※10)を導入したWindowsまたはUbuntuなどのOSを用意します。

Gitを使用して公式リポジトリをcloneし、以下の手順で起動します。

- Terminalを開き

cd dify/dockerに移動 cp .env.example .envでenvファイルを作成docker-compose up -dを実行

これで、ブラウザから http://localhost にアクセスすればログイン画面が表示されます。最初の管理者登録を済ませれば、Difyが使える状態になります。

設定の注意点とトラブルシューティング

ポート(※11)競合やメモリ不足が原因でエラーが出た際は、docker-compose logs でログを確認しましょう。

2026年版のDifyはNginx(※12)の設定が最適化されております。

初期設定のままでも十分に高速ですが、本番運用ではセキュリティ対策をおき、リソース制限を適切に行うことが成功のキーです。

(注釈 ※8)Docker Compose:複数のコンテナをまとめて管理・起動するための設定ファイル。

(注釈 ※9)GitHub:プログラムの設計図(ソースコード)が保存・公開されているサイト。

(注釈 ※10)WSL:Windows上でLinuxのプログラムを直接動かせる仕組み。

(注釈 ※11)ポート:通信の通り道となる番号。他のソフトと重なるとエラーになります。

(注釈 ※12)Nginx:Webサーバーソフト。通信を整理してアプリに届ける役割をします。

ローカルLLM構築とLM Studio連携

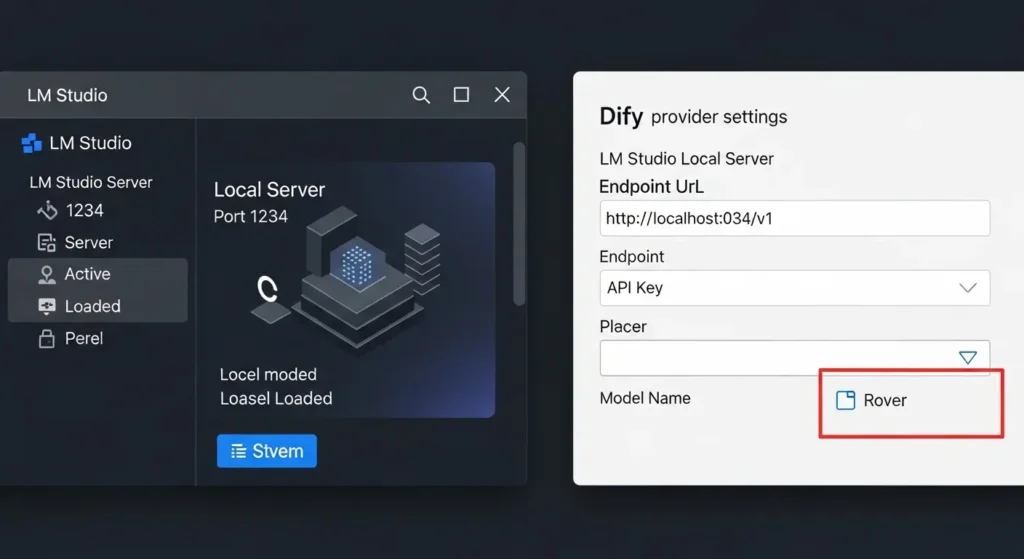

要点:LM Studio(※13)をAPIサーバーとして運用し、Difyからエンドポイントを指定して接続します。

LM Studioでモデルを動かす

LM Studioをダウンロードし、GGUF(※14)形式のモデルを選択してロードします。

左側メニューから「Local Server」を選択します。

ポートを 1234 などに設定してサーバーを開始します。

Dify側での設定手順

Difyの画面右上のアイコンから「設定」>「プロバイダー」を選びます。

OpenAI-Compatibleを選択します。

- Model Name:使用するモデル名

- API Key:任意の文字列(LM Studioは認証不要な場合が多いですが、形式的に入力が必要なことがあります)

- API Endpoint:

http://host.docker.internal:1234/v1(Docker経由の場合)

これでDifyのチャット画面でローカル****モデルの回答が出力されるようになります。

GeminiやClaude(※15)などの外部APIを使わないため、完全無料で試し続けることが可能です。

(注釈 ※13)LM Studio:LLMを簡単にダウンロードして実行できる初心者向けツール。

(注釈 ※14)GGUF:LLMを効率よく動かすためのファイル形式。

(注釈 ※15)Claude:Anthropic社が開発した高性能なAIモデル。

Ollamaを活用した推論環境の最適化

要点:Ollama(※16)はバックグラウンドで軽量に動作します。

Difyとの連携もデフォルトでサポートされています。

推論環境のセットアップ

Ollamaを公式サイトからインストールし、ターミナルで ollama run llama3 などを実行してモデルを取得します。

2026年にはQwenの最新版など、日本語に強いモデルもOllamaで簡単に使えるようになっています。

Difyとのシームレスな連携

DifyにはOllama専用のプロバイダー設定が用意されています。

Base URLに http://host.docker.internal:11434 を指定するだけで、APIの知識がなくても接続が完了します。

推論(※18)の速度を上げたい場合は、GPUメモリの割り当てを変更するなどのカスタマイズも可能です。

(注釈 ※16)Ollama:LLMをMacやWindows、Linuxで手軽に動かせるツール。

(注釈 ※17)pull:インターネットからモデルデータをダウンロードしてくること。

(注釈 ※18)推論:AIが入力に対して考え、答えを出す処理のこと。

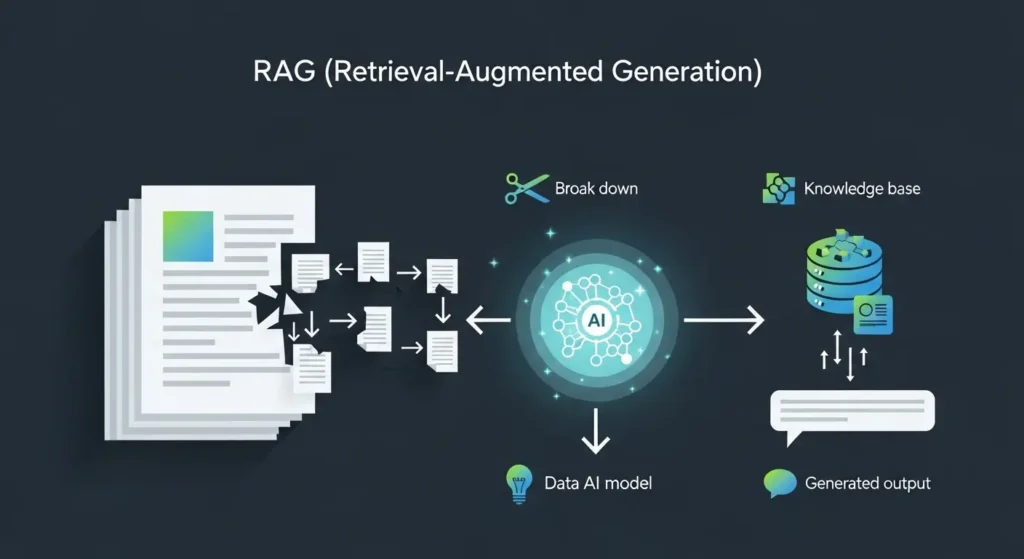

2026年最新:RAG とエージェント機能の活用

要点:ローカル環境でのRAG運用は、社内ドキュメントの要約やナレッジ共有の効率を劇的に向上させます。

セルフホストRAGの構築

Difyの「ナレッジ」機能を使えば、PDFやExcelファイルをアップロードしてRAGを構築できます。

embeddingモデルもローカルで動かすことができます。

機密情報を一歩も外に出さずに正確な検索回答を行うエージェントを作成できます。

並列処理と高速化

2026年のトレンドは、複数のモデルを並列(※20)で走らせ、最も正確な回答を自動で選ぶエージェントです。

ローカルならトークン数を気にせず大量のリクエストを投げられるため、コスト削減と精度向上を同時に実現できます。

(注釈 ※19)embedding:文章をAIが理解できる数字の羅列(ベクトル)に変換すること。

(注釈 ※20)並列:複数の作業を同時に並行して進めること。

要点:2026年のAI開発において、Difyの設定をより高度にカスタマイズし、ユーザーにとって使いやすい環境を整えるための方法を深掘りします。

実践的なDifyの運用と詳細設定

要点:インストールの後、最初に行うべきはアカウントの作成と、外部サービスに依存しない独自のプロンプト(※24)管理です。

アカウント作成とログインの手順

DockerでDifyを立ち上げた後、ブラウザのホーム画面からアカウントの名前とパスワードを登録します。

名前を登録する時は、組織内での識別がしやすいものを設定するのが良いでしょう。

利用規約に同意し、OKをクリックすれば、あなた専用のダッシュボードにアクセスできます。

再度ログインする時に備え、認証情報は厳重に管理してください。

モデルプロバイダーの追加と更新

設定メニューから「プロバイダー」の項目を開きます。

例えば、OpenAIのGPT-4oなどのモデルとローカルLLMを組み合わせる方法があります。

右側の「追加」ボタンを押します。

APIキーをコピーして貼り付けるだけで連携は完了します。

2025年から2026年にかけて、Difyの開発元であるLangGenius(※25)は、モデルの更新情報を自動で取得する機能を強化しています。

常に最新のmodels(※26)をリストから選択できる性能を備えています。

(注釈 ※24)プロンプト:AIに対する指示文。目的に合わせて書き換えることで回答の質が変わります。

(注釈 ※25)LangGenius:Difyを開発・運営している企業名。

(注釈 ※26)models:AIの言語モデル。GPTやLlama、Qwenなど多種多様な種類があります。

開発者向けの高度なカスタマイズ

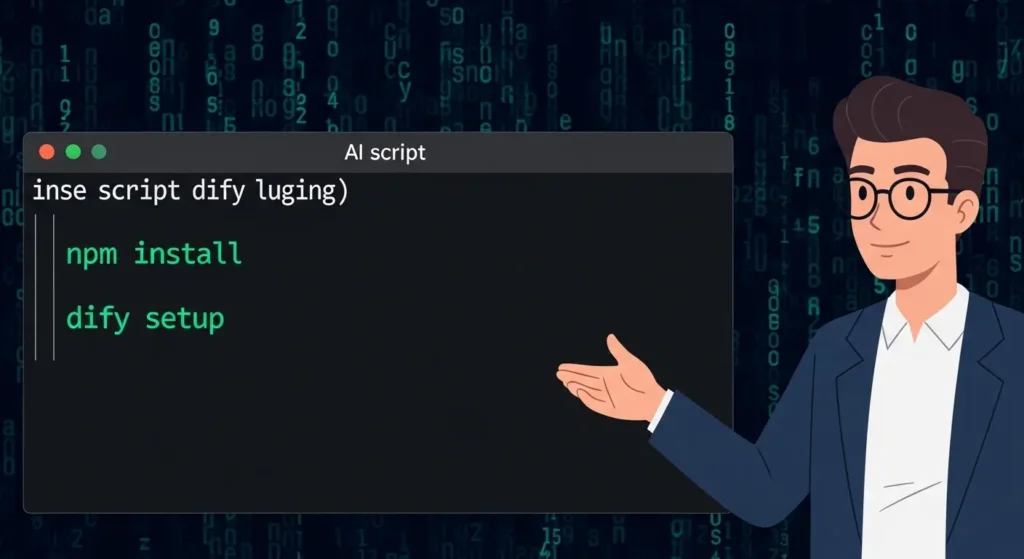

要点:Difyのソースコード(code)を直接書き換える、あるいはコマンドプロンプト(※27)を活用することで、推論速度のMAX(※28)化を狙えます。

インストール時のコマンド操作

Windowsでinstallを進める際、コマンドプロンプトやPowerShellでの操作が必要になる時があります。

GitHubからコードを取得(clone)し、Docker Composeでコンテナを立ち上げる一連の流れは、一度作ってしまえば後は非常にスムーズです。

ネットワーク設定などで問題が発生した際は、設定ファイルを書き換えて再起動するだけで、次の動作確認へと進めます。

ユーザーニーズに合わせた柔軟な提供

自社のメンバーに向けて、特定の業務に特化したAIアプリを提供する際は、UIの調整が重要です。

プロンプトを固定します。

ユーザーが迷わないように入力欄を最小限にするなど、人それぞれの使い勝手に合わせた調整をしましょう。

これには少し時間がかかるかもしれませんが、結果的に業務効率の飛躍的な向上へと繋がります。

(注釈 ※27)コマンドプロンプト:文字を入力してパソコンに直接命令を出すためのツール。

(注釈 ※28)MAX:最大。ここではマシンのパワーを限界まで引き出すという意味。

パフォーマンスを引き出すサーバー設定

要点:Ollamaの内部環境変数を調整し、並列リクエスト処理やGPUのフル活用を明示的に指定することで、複数ユーザーからの同時アクセスにも耐えうる基盤を構築できます。

Ollamaはデフォルト設定でも優秀ですが、特定のワークフローに特化させる場合は、環境変数の調整が効果を発揮します。

推論スループットの向上

- 並列処理の有効化:

OLLAMA_NUM_PARALLELを調整することで、複数のリクエストを同時に処理し、システム全体の待機時間を削減します。 - GPUの強制割り当て:複数のGPUを搭載している場合、

CUDA_VISIBLE_DEVICESを指定して、推論専用のカードを明示的に割り当てることで、他のデスクトップ作業への影響を回避します。

2026年モデルの推奨スペックと性能

2026年2月時点での主要モデルのパフォーマンス目安は以下の通りです。

| モデル名 | 推奨VRAM | 推論速度(目安) | 特徴 |

| Llama 4 (8B) | 8GB – 12GB | 40+ tokens/s | 2026年の標準。汎用性・速度共に最高レベル。 |

| Gemma 3 (12B) | 12GB – 16GB | 30+ tokens/s | Google最新。推論・要約に非常に強い。 |

| Qwen 3 (30B) | 24GB+ | 15-20 tokens/s | コーディングや多言語対応でクラウド級の性能。 |

注釈:トークン(Tokens Per Second)とは、AIが1秒間に生成できる単語の断片(トークン)の数のことです。

一般的に30〜50程度あれば、人間が読む速度を上回り、非常に快適に感じられます。

この動画は、2026年時点でのOllamaと他の推論エンジン(vLLM等)の性能比較や、最新のハードウェアでの最適化設定について詳しく解説しており、環境構築の参考になります。

まとめ:2026年のAI運用の理想形

要点:DifyとローカルLLMの連携は、情報漏洩のリスクを抑えつつ、低コストで高品質なAI体験を実現する最高の法(※29)です。

今回の記事では、Difyの基本的な使い方から、LM Studioなどの外部ツールとの連携までを網羅しました。

投稿された最新のナレッジやコミュニティの知恵を借りながら、あなたのPC(Your PC)で、次世代のAIエージェントを動かしてみてください。

最初は難しく感じるかもしれませんが、ガイドの通りに進めれば、誰でもプライベートなLLM環境を手にすることができます。

(注釈 ※29)法:方法や手段のこと。

最終チェックリスト

- Docker環境の準備は整っていますか?

- ローカルLLM(Ollama / LM Studio)は起動していますか?

- APIのURL(

host.docker.internal)は正しく入力されていますか?

よくある質問(FAQ)

要点:Difyの運用でエンジニアが抱きやすい疑問について、解決策をまとめました。

Difyの動作にはどの程度のスペックが必要ですか?

A. Dify自体はDockerで動くためそれほど重くありませんが、モデルを動かすには最低でも8GB、できれば16GB以上のRAM(※21)を推奨します。

特に7B(※22)以上のモデルを快適に動かすにはNVIDIA製のGPUが有利です。

外部からDifyにアクセスするにはどうすればいいですか?

A. NGINXのリバースプロキシ設定を行い、IPアドレスを固定するか、VPN経由でアクセスするのが安全です。

個人情報や機密を扱う場合は、そのままインターネットに公開せず、クローズドなネットワーク内での運用を強く推奨します。

GeminiやOpenAI のAPIと併用できますか?

A. はい、プロバイダー設定で複数のAPIキーを登録可能です。

重要な処理はローカルで、複雑な推論はクラウドでといった、プランに応じた使い分けがDifyなら簡単に行えます。

(注釈 ※21)RAM:パソコンの作業用メモリ。大きいほど複雑な作業ができます。

(注釈 ※22)7B:70億個のパラメータを持つモデル。標準的な高性能AIのサイズです。

結論:Dify連携で次世代のプライベートAIを

要点:DifyとローカルLLMの連携は、2026年のビジネスにおいて、コスト・安全・速度のすべてを満たす究極の解決策です。

今回の検証でわかった通り、LM StudioやOllamaといった外部ツールとの接続は、エンドポイントのurlを正しく指定するだけのステップで実現できます。

自社専用のチャットボットやエージェントを、ノーコード(※23)に近い操作で作れるDifyは、エンジニアの強力な支援ツールとなるでしょう。

今後はさらに、画像認識や音声解析などの機能もローカルで統合されていきます。

最初はとりあえず動かしてみるところから始め、自分の業務に最適なワークフローを見つけてみてください。

(注釈 ※23)ノーコード:難しいプログラムを書かずにアプリを作れる仕組み。