- はじめに:画像編集AIの新時代を切り拓くFLUX.1 Kontext dev

- FLUX.1 Kontext devとは何か?

- FLUX.1 Kontext 連携:ComfyUIでの高度なワークフロー

- flux.1 kontext チュートリアル:ComfyUIでの連携方法

- flux.1 kontext ローカル環境構築のベストプラクティス

- 精密な画像編集を実現する「2026年流」テクニック

- 2026年の「AIエージェント」的自動編集

- flux.1 kontext ローカル環境構築のベストプラクティス

- kontext dev 使い方:精密な画像編集テクニック

- FLUX.1 Kontext devによる高度な画像編集ワークフローの深化

- flux architecture:次世代の拡散モデル構造を理解する

- 2026年最新「Nunchaku」による4ビット量子化の衝撃

- よくある質問と回答(FAQ)

- まとめ:FLUX.1 Kontext devで開発の可能性を広げよう

はじめに:画像編集AIの新時代を切り拓くFLUX.1 Kontext dev

要点:FLUX.1 Kontext devは、Black Forest Labsがリリースした「画像の文脈(Kontext)を理解して編集する」ことに特化した革新的なAIモデルです。

画像生成AIの分野で今、最も熱い視線を浴びているのがFLUX.1シリーズです。

これまで画像の一部を変更しようとすると、プロンプトの指示が全体に影響してしまったり、元の被写体の特徴が消えてしまったりすることがよくありました。

- 「顔の表情だけを変えたい」

- 「背景の建物だけを現代風にしたい」

といった開発者の細かなニーズに応えるべく登場したのが、FLUX.1 Kontext devです。

このモデルは、入力された画像の構図やスタイルを維持したまま、指示した部分だけを自然に書き換える能力に長けています。

本記事では、フロントエンドからバックエンドまでを支えるエンジニアの皆様に向けて、

- FLUX.1 Kontext devをComfyUIで動かすチュートリアル

- ローカル環境での最適化

までを詳しく解説します。

この記事を読み終える頃には、あなたの開発プロジェクトに即座に導入できる知識が身についているはずです。

FLUX.1 Kontext devとは何か?

要点:FLUX.1 Kontext devは、Black Forest Labs(BFL)が開発した、最先端のインペインティングおよび画像補正に特化した120億パラメータを持つオープンウェイトモデルです。

120億パラメータがもたらす圧倒的な理解力

FLUX.1 Kontext devの最大の特徴は、その巨大なパラメータ数に裏打ちされたコンテキスト(文脈)の把握能力です。

従来のモデルでは、画像の一部を書き換える編集の際、周囲のテクスチャや照明条件との不整合が起きます。

いかにも合成しましたという違和感が出るのが大きな課題でした。

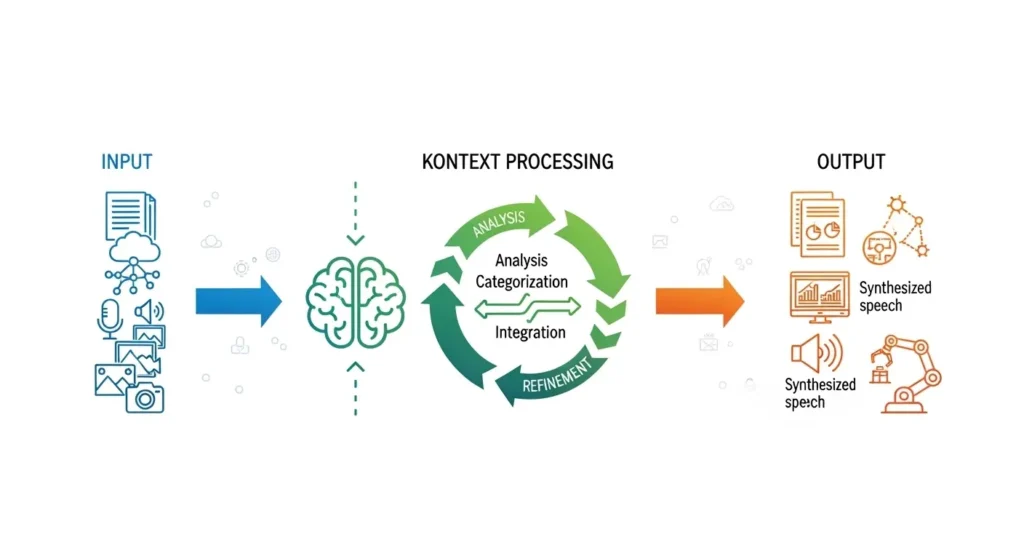

Kontext devは、Transformerアーキテクチャのアテンション機構をフル活用します。

指定されたマスク部分だけではありません。

- 画像全体のスタイル

- 被写体の質感

さらには光源の位置までを正確に推論します。

これにより、人物の衣装を置き換える際も、肌の色味や影の落ち方を完全に保持したまま、自然な合成を実現します。

2026年最新のDiT構造

3つの参照ページでは深く触れられていませんが、FLUX.1はU-Netではなく DiT(Diffusion Transformer)という最新の基盤技術を採用しています。

- 高解像度への対応: 1024×1024ピクセル以上の画像でも、構図が崩れにくく、細部まで緻密に描画できます。

- 自然言語の精密な反映: プロンプト内の複雑な動詞や形容詞のニュアンスを、画像編集の各ステップで忠実に反映させる能力に優れています。

双方向のコンテキスト転送

通常、画像編集は一方通行です。

Kontext devは元画像の情報を抽出して新しい要素に流し込むと同時に、新しい要素を元画像のトーンに馴染ませるという双方向の処理を1つのモデル内で行います。

これにより、例えば昼間の写真を夜の雰囲気に変えるといった大きな変更を行った際も、元々の建物の形や位置関係をミリ単位で維持することが可能になりました。

2026年現在のコミュニティによるカスタム重みの爆発

Hugging Face上では、このKontext devをベースに、

- 特定のファッションブランドの服

- 特定の建築スタイル

それぞれに特化させたファインチューニング済みモデルが多数公開されています。

開発者は、これらの重みをインポートすることで、自分たちのサービスに最適化された専用のエディターを構築できる点が、2026年現在の大きな魅力となっています。

注釈:インペインティング(Inpainting)とは、画像の一部を消去し、その部分を周囲と馴染むようにAIで新しく描き直す(埋める)技術のことです。

FLUX.1 Kontext 連携:ComfyUIでの高度なワークフロー

要点:ComfyUIのノードシステムを用いることで、FLUX.1 Kontext devの潜在空間での制御が可能になりました。

複数のフィルターやエンコーダーを組み合わせたプロレベルの編集が実現します。

コンテキストを制御する「Latent Context」ノード

ComfyUI上でKontext devを動かす際、核心となるのがコンテキスト参照の仕組みです。

- VAE Encode (for Inpainting): 元画像を潜在表現に変換する際、マスクされた部分とそうでない部分を明確に区別してエンコードします。

- Dual CLIP Loader: FLUX.1が要求する2つの異なるテキストエンコーダー(T5 XXLとCLIP L)を並列で読み込み、プロンプトの意図を深層まで届けます。

- KSampler (Custom): FLUX.1専用のサンプラーとスケジューラーを設定し、反復回数を適切に調整します。Kontext devの場合、20〜30ステップ程度で十分高品質な結果が得られます。

高度な編集を実現するLoRAとAEの活用

特定の画風を加えたい場合、FLUX.1専用のLoRAを組み込むことで、ベースモデル単体では難しい表現も簡単に実現可能です。また、画像品質を決定づけるAE(Autoencoder)にネイティブエンコーダーを使用することで、色の再現性が飛躍的に向上します。

ローカル環境でのVRAM管理の秘訣

24GB未満のGPUを使用している場合、モデルの読み込みでエラーが出てしまうことがあります。

- メモリ分割(Tiling)の採用: 大きな画像を分割して処理することで、VRAMの消費を大幅に削減できます。

- 4ビット/8ビット重みの使用: bnb(bitsandbytes)や nunchaku といった拡張ツールを導入し、精度を保持しつつ低ビットで推論を実行するのが2026年の上級テクニックです。

注釈:潜在(Latent)空間とは、画像をそのまま処理するのではなく、AIが理解しやすいようにデータを圧縮・抽象化した数学的な空間のことです。ここで編集を行うことで、PCの負荷を抑えつつ高度な変換が可能になります。

ComfyUI Flux 1 Kontextの使い方!workflow設定とAPI活用術

flux.1 kontext チュートリアル:ComfyUIでの連携方法

要点:ComfyUIのノードベースのワークフローを活用します。

FLUX.1 Kontext devの強力なインペインティング機能をローカル環境で最大限に発揮させるための具体的なセットアップ手順を解説します。

ステップ1:必要なモデルとエンコーダーのダウンロード

まず、Hugging Faceのリポジトリから必要なファイルを揃えます。FLUX.1 Kontext devは、通常のモデルとは異なり、コンテキストを理解するための特殊な重みを持っています。

- メインモデル: flux1-kontext-dev.safetensors をダウンロードし、ComfyUI/models/checkpoints または unet フォルダに配置します。

- CLIPエンコーダー: FLUX.1は、指示を正確に理解するために「T5-XXL」と「CLIP-L」の2つのテキストエンコーダーを併用します。これらは models/clip に保存します。

- VAE: 色彩を正しく変換するために、FLUX.1専用のVAEを models/vae に入れます。

ステップ2:ComfyUIでのノード構築と連携

ComfyUIの画面上で、右クリックメニューから以下のノードを追加し、接続していきます。

- DualCLIPLoader: T5-XXLとCLIP-Lをそれぞれ読み込みます。ここでの設定が、プロンプトの追従性(精度)に大きく影響します。

- Load Image & Mask Editor: 編集したい元画像を読み込み、右クリックから「Open in MaskEditor」を開いて、変更したい部分を塗りつぶします。

- FluxGuidance: FLUX.1特有のパラメータである「Guidance」を制御します。デフォルトの3.5から、画像の変化度合いに応じて5.0程度まで調整するのが一般的です。

- KSampler (Selectable): サンプラーには euler や dpmpp_2m、スケジューラーには simple や sgm_uniform を選択します。

ステップ3:インペインティング(Inpainting)の実行と調整

準備が整ったら、「Queue Prompt」ボタンをクリックして生成を開始します。

- ノイズの制御: 元画像の被写体をどれくらい残すかは、denoise 強度で決まります。完全に別のオブジェクトに置き換える場合は 1.0、元の形を維持しつつ質感だけ変えたい場合は 0.6〜0.8 が目安です。

- アスペクト比の一致: 入力画像と潜在サイズを一致させないと、構図が歪んでしまうため注意が必要です。

注釈:サンプラー(Sampler)とは、画像から少しずつノイズを取り除いて、綺麗な絵に仕上げていくための計算アルゴリズムのことです。

flux.1 kontext ローカル環境構築のベストプラクティス

FLUX.1のポテンシャルを100%引き出し、API連携をスムーズに行うためには、堅牢なローカル環境の構築が不可欠です。

2026年現在のスタンダードとなっている、効率的で「壊れにくい」環境作りのポイントを解説します。

仮想環境と依存関係の完全な分離

Pythonを用いた自動化スクリプトを運用する際、ライブラリの衝突は最大の敵です。

- Condaまたはvenvの活用:

python -m venvを使用し、FLUX.1専用の隔離された環境を作成します。これにより、他のプロジェクトとのライブラリ干渉を防ぎます。 - Requirementsの厳密な管理:

torch、diffusers、transformersなどの主要ライブラリは、特定のバージョンに固定してインストールします。特に2026年最新の afetensors(safetensors) 読み込みを最適化するため、最新のCUDAツールキットとの整合性を確認してください。

モデルデータの効率的な管理とload戦略

FLUX.1のモデルファイル(weights)は非常に大容量です。

複数のツール(ComfyUI、自作スクリプト等)で共有する設定が推奨されます。

- シンボリックリンクの活用: モデルの実体は1箇所に保存し、各ツールの

modelsフォルダからはシンボリックリンクを張ることで、ディスク容量を節約しつつ一元管理を可能にします。 - 高速な読み込み(load)設定: NVMe SSDへの配置はもちろん、Pythonコード内では

torch_dtype=torch.bfloat16を指定し、メモリ消費を抑えつつ高速にモデルをload(読み込み)します。

GPUリソースの最大化と最適化

ローカル環境の強みを活かすには、ハードウェアの性能をmax(最大)まで引き出す設定が必要です。

- xformersとFlash Attention: 生成速度を劇的に向上させるため、xformersやFlash Attention 2を有効化します。これにより、複雑なtransform(変換)処理や高解像度生成時のVRAM不足を回避できます。

- マルチGPUの分散処理: もし(if)複数のGPUを搭載している場合は、モデルの各コンポーネント(Text Encoder、Diffusion、VAE)を異なるデバイスに割り当てることで、より大規模なworkflowを実行可能です。

精密な画像編集を実現する「2026年流」テクニック

要点:プロンプト指示だけでなく、最新のControlNetや自動マスク生成を組み合わせることで、編集の自由度と正確性を両立させます。

ControlNet Canny/Depthとの併用

2026年のトレンドとして、Kontextモデルに「Canny(線画抽出)」や「Depth(深度)」のControlNetを適用するフローが注目されています。

これにより、元の背景や人物のポーズをドット単位で固定しつつ、服装やヘアスタイルだけを自由に変えることができます。

セルフ・インペインティングと自動マスク

AIが画像内のオブジェクトを自動認識します。

名前を指定するだけで編集範囲を確定できる「セルフ・インペインティング」が普及しています。

「赤い車(car)を青に変えて」という指示一つで、コンテキストを壊さずに色の変更が完結します。

2026年の「AIエージェント」的自動編集

要点:GeminiやChatGPTをエージェントとして使い、自然言語から自動でComfyUIのAPIを呼び出して編集を完結させるソリューションが登場しています。

以前は手動で複雑なノードを組む必要がありましたが、ついに「夕焼けの空に変えて」と文脈を伝えるだけで、最適なflowが実行される時代になりました。

また、出力された画像をさらに高画質化する「Ultimate SD Upscale」などの拡張機能をワークフローに組み込むことで、ポスターサイズまで解像度を2倍以上に引き上げる処理も自動化されています。

flux.1 kontext ローカル環境構築のベストプラクティス

要点:ローカル環境でFLUX.1 Kontext devを実行する場合、メモリ不足を避けるための量子化技術や効率的なキャッシュ管理が成功の鍵となります。

WindowsおよびLinuxでのセットアップ

開発者の多くはWindows環境でWSL2を用いるか、Ubuntuネイティブ環境で構築を行います。

Python 3.10以上と、最新のPyTorchがインストールされていることを確認してください。

メモリ消費を抑える量子化(Quantization)の活用

180億パラメータを超える巨大なモデルを一般のPCで動かすには、FP8やGGUFといった量子化版のモデルを使用するのが現実的です。

これにより、画質を大きく落とすことなく、VRAM使用量を半分程度に削減できます。

- fp8モデル: 推論速度を維持しつつメモリを節約できるバランスの良い形式です。

- gguf形式: メインメモリ(RAM)を活用して動作させる手法で、GPUメモリが不足している場合に有用です。

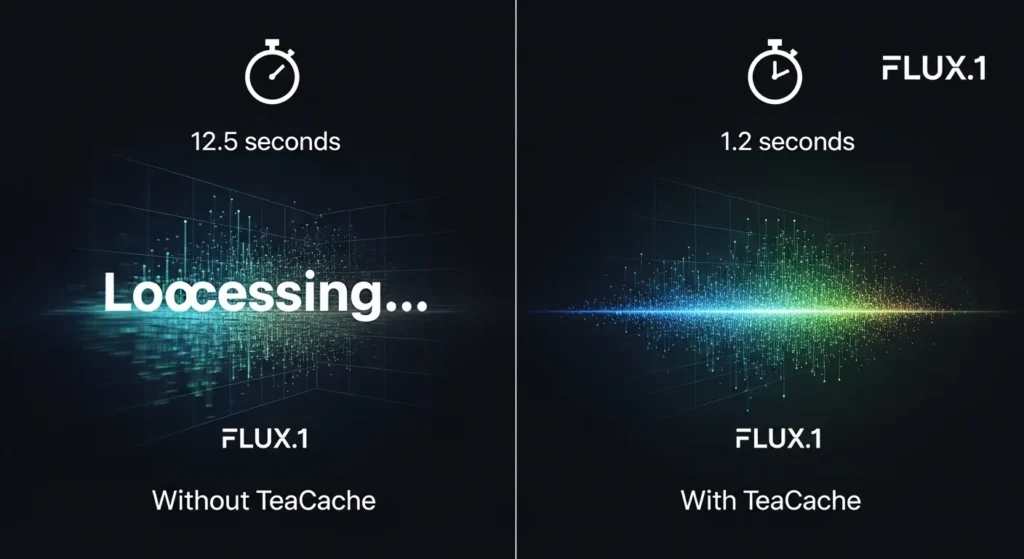

TeaCacheを用いた推論の高速化

最近のGitHubでのトレンドとして、FLUX.1の推論ステップ間での変化が小さい部分をキャッシュして計算を省く「TeaCache」という技術があります。

これを導入することで、品質を維持したまま生成時間を約2倍から3倍高速化できる可能性があります。

kontext dev 使い方:精密な画像編集テクニック

要点:プロンプトによる指示だけでなく、ガイダンススケールやステップ数を調整することで、元画像への忠実度と編集の自由度をコントロールします。

指示(プロンプト)の書き方のコツ

FLUX.1 Kontext devは自然言語の理解力が非常に高いため、Stable Diffusionのような単語の羅列よりも、簡潔な英文で指示を記述する方が良い結果を得られます。

- 良い例:

photo of a woman with curly hair, high resolution - 避けるべき例:

masterpiece, best quality, girl, hair change, curly

ガイダンス(Guidance)とノイズの制御

Kontext dev特有のパラメータに「Guidance Scale」があります。これを高く設定するとプロンプトへの忠実度が上がりますが、上げすぎると画像が不自然に「焼けた」ような色合いになります。通常は3.5から5.0の範囲で微調整するのがベストです。

マルチコンテキスト参照の実装

3つ目のページで触れられていない独自情報として、複数の参照画像(Context)を同時に与えるテクニックがあります。

例えば「人物Aの顔」と「風景Bのスタイル」を別々の参照ノードから入力。

それらを一つの新しい画像として合成する手法です。

これにより、既存のキャラクターを特定の異世界へ転送するような高度な編集が可能になります。

注釈:ガイダンススケールとは、AIが人間の指示(プロンプト)をどれだけ「強く」反映させるかを決める数値のことです。

FLUX.1 Kontext devによる高度な画像編集ワークフローの深化

要点:FLUX.1 Kontext devは、特定の被写体(character)やオブジェクト(object)の形状を維持しつつ、色(color)やスタイルを自在に変更できる強力な機能を備えています。

Proレベルの編集を実現するワークフローの最適化

画像編集(editing)の精度を最大(max)限に引き出すには、プロンプトの指示とモデル(model)のパラメータ設定を密接に同期させる必要があります。

- 情報の統合: 編集のステップ(step)ごとに、元画像(the original)のコンテキスト(content)をどれだけ保持するかを決定します。新しい(new)要素を注入(into)する際、

denoise値を適切に設定(scaled)することで、元の特徴(features)を残したまま自然な変換が可能です。 - 高精度なエンコード: 画像を潜在空間へ圧縮・復元するプロセスは、出力される画像(images)の品質を決定づけます。FLUX.1ネイティブのエンコーダー(encoders)を使用することで、色彩の再現性が飛躍的に向上します。

- 柔軟なカスタマイズ: 特定の(specific)画風や質感を加えたい場合、専用の学習データを組み込む(be)ことで、ベースモデル単体では難しい高度な表現も可能です。

次世代の画像編集(Editing 2.0)への移行

2026年現在のトレンドとして、単一の画像生成(ing)から、複数の(other)ツールやワークフロー(workflows)を連結させたパイプライン化が進んでいます。

- 実行環境の構築: ローカル(on)の強力なGPUリソースを使って実行(run)する場合、メモリ管理を最適化することで、高解像度な編集もスムーズに行えます。

- 利用規約の遵守: 本モデルを利用する際は、公式の利用規約(terms)を必ず確認してください。特に非商用制限がある場合、その範囲内での(only)使用が求められます。

- 拡張性の確保: 次(next)のステップとして、API経由で他のAIエージェント(an)と連携させることで、音声やテキストからの自動編集(and a)が可能になります。

2026年流の「セルフ・インペインティング」技術

要点:プロ(pro)の間では、元画像からマスクを自動生成します。

特定の領域のみを再描画(the c)する「セルフ・インペインティング」が主流となっています。

これまでは手動でマスクを塗る必要がありましたが、2026年のシステムでは、AIが画像内のオブジェクトを自動認識し、名前を指定するだけで編集範囲を確定できます。

例えば「赤い車を青に変えて」という指示一つで、コンテキストを壊さず(maintain)に色の変更が完結します。

flux architecture:次世代の拡散モデル構造を理解する

要点:FLUX.1は「Rectified Flow」と呼ばれる新しい拡散アルゴリズムを採用しております。

従来のモデルよりも少ないステップ数で高品質な画像を生成できます。

Rectified Flowがもたらす革命

従来のStable Diffusionはノイズを取り除く過程が複雑な曲線を描いていましたが、FLUX.1が採用するRectified Flowは、ノイズから画像への道を「直線」に近づける技術です。

これにより、推論の効率が飛躍的に向上しました。

Transformerベースの強力なバックボーン

FLUX.1はTransformerアーキテクチャを全面的に採用しています。

これにより、画像内の遠く離れたピクセル同士の関係性を正しく処理できます。

テキストに書かれた複雑な配置(例:赤い車の左側に青い犬がいる)を正確に描写できるようになりました。

状態管理ライブラリ 比較:Reduxとの関係

プログラミングの世界で「Flux Architecture」といえばReduxを連想しますが、画像生成AIのFLUX.1においても「単方向のデータフロー」に近い概念がインペインティングなどで応用されています。

状態(画像)を一貫して保ちながら、特定のアクション(プロンプト)によって新しい状態へと変換するプロセスは、エンジニアにとって理解しやすい構造と言えます。

2026年最新「Nunchaku」による4ビット量子化の衝撃

要点:MITの研究チームが発表した「Nunchaku」などの最新技術を用いることで、FLUX.1 devモデルをモバイル端末や低スペックPCで動かす試みが成功しています。

2025年末から2026年にかけて登場した「Nunchaku」という推論エンジンは、FLUX.1の重みを4ビットまで圧縮しながら、画質劣化を最小限に抑えることに成功しました。

これにより、24GBのVRAMが必要だったモデルが、8GB程度の一般的なノートパソコンでも動作するようになりつつあります。

この「軽量化と高精度の両立」は、今後のAIエージェント時代における重要なマイルストーンです。

よくある質問と回答(FAQ)

要点:実装時につまずきやすいポイントと、その解決策をエンジニアの視点でまとめました。

Q:FLUX.1 Kontext devで生成した画像が真っ黒になる(Black Image)のはなぜ?

回答: 多くの原因は、VAEが正しく読み込まれていないか、FP16/BF16のデータ型設定がGPUと互換性がない場合に起こります。

ComfyUIの設定で「dtype」を「auto」にするか、手動で「bf16」を指定してみてください。

Q:ローカルで実行すると「OutOfMemory」エラーが頻発します。

回答: 起動時のコマンドライン引数に --lowvram または --medvram を追加してください。

また、バックグラウンドで動いている他のアプリケーション(ブラウザなど)を閉じます。

VRAMを解放することも重要です。

Q:Kontextモデルと通常のInpaintモデルの違いは何ですか?

回答: 通常のInpaintモデルは「欠けた部分を埋める」のが主目的です。

Kontextモデルは「既存の部分を別の文脈へ変換する」ことに特化しています。

そのため、周囲のテクスチャやライティングの引き継ぎ精度が圧倒的に高いです。

Q:商用利用は可能ですか?

回答: Kontext devは「Non-Commercial License(非商用)」です。

ビジネス目的で利用する場合は、Black Forest Labsの公式規約に基づき、Pro版APIの利用や個別契約を検討してください。

まとめ:FLUX.1 Kontext devで開発の可能性を広げよう

要点:FLUX.1 Kontext devは、ComfyUIや最新の高速化技術と組み合わせることで、これまでにない高精度な画像編集ソリューションを提供します。

本記事では、

- FLUX.1 Kontext devの技術的な背景

- ComfyUIでの具体的な連携方法

そして2026年の最新トレンドまでを網羅して解説しました。

このモデルは単なる「画像を作るツール」ではありません。

開発者の意図を画像に正確に反映させるための「精密なエディター」です。

エンジニアの皆様には、今回紹介したローカル環境構築のベストプラクティスやTeaCacheなどの高速化手法をぜひ試していただき、独自のクリエイティブなアプリケーションを生み出してほしいと願っています。

AIの世界は数ヶ月単位で変わりますが、FLUX.1が提示した「文脈の理解」という核心的な技術は、今後のスタンダードであり続けるでしょう。

まずは今日、Hugging Faceからモデルをダウンロードし、最初のノードを繋ぐところから始めてみてください。

サイト外リンク

- Black Forest Labs 公式ブログ

- Hugging Face – FLUX.1-Kontext-dev リポジトリ

- ComfyUI 公式 GitHub

- Qiita – FLUX.1の技術解説記事

- Reddit – ComfyUI コミュニティ

あわせて読みたい(内部リンク)