- 自分のPCで日本語AIを動かす快感

- LM Studio 日本語LLMの基礎

- LM Studio 日本語モデルおすすめ3選

- LM Studio 日本語モデルの使い方

- 最新のVisionモデルで「画像解析」を日本語で行う

- LM Studio 量子化の選び方

- 推論速度を2倍にする「K-V Cache」の最適化

- MCP(Model Context Protocol)による外部連携

- LM Studio 日本語モデル設定のコツ

- 2026年最新のローカルAIトレンドとLM Studio

- ローカルLLM 日本語環境のメリット

- LM Studio GPUの活用とスペック

- トラブルシューティング:動かない時は?

- LM Studio 比較と今後の展望

- よくある質問と回答

- 結論:今すぐローカル日本語AIを始めよう

自分のPCで日本語AIを動かす快感

要点:LM Studioを使えば、高額なクラウド料金を払わずにプライバシーを守りながら日本語AIをローカル環境で自由に利用できます。

最新のAI技術を体験したいけれど、自分のデータがクラウドに送信されるのが不安だ、あるいは毎月のサブスクリプション料金が高いと感じていませんか。

そんな悩みを解決するのが、LM Studioを用いたローカルLLMの導入です。

これまで複雑だった環境構築が、今では数クリックで完了します。

あなたのPCが強力な知能を持つ専用の相談相手に変わります。

本記事では、2026年最新の情報を基に、日本語モデルをLM Studioで100%活用するための手順とおすすめモデルを詳しく紹介します。

LM Studio 日本語LLMの基礎

要点:LM Studioは、GGUF形式の日本語モデルをロードすることで、インターネット接続なしでChatGPT同等の体験を可能にする、2026年現在最も普及しているローカルLLM実行ツールです。

ローカルLLM(注釈:自分のPC内で動作する大規模言語モデル)を使いこなすための第一歩は、LM Studioの基本構造を理解することです。

2024年や2025年時点では導入のハードルが高かった技術ですが、2026年現在はソフトウェアの最適化が進み、非エンジニアの方でもボタン一つで「自分専用の知能」を構築できる環境が整いました。

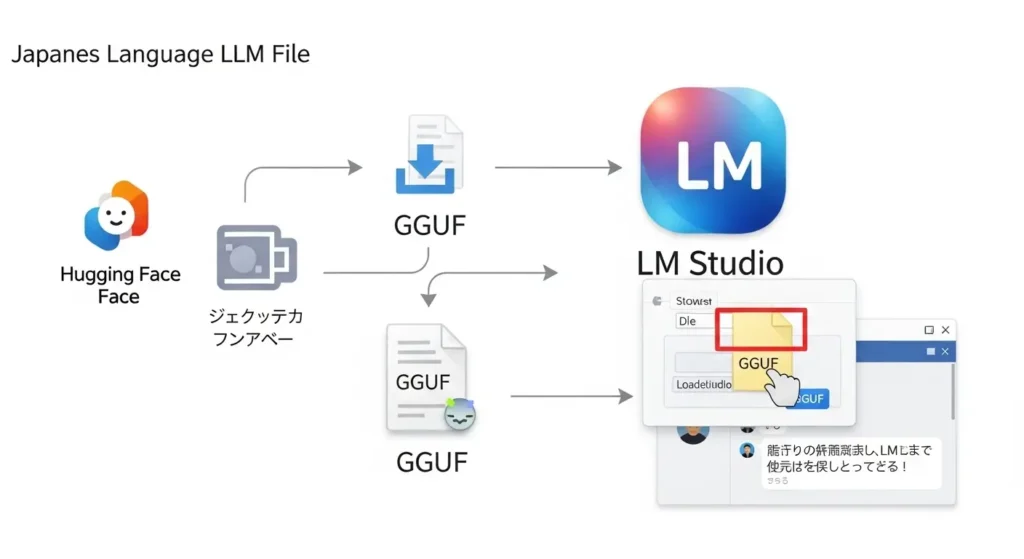

日本語モデルを動かすGGUFの仕組み

LM Studioで日本語AIを動かす際、最も重要なのが「GGUF」というファイル形式です。

これは、元々巨大なAIモデルをPCのメモリ(RAM)やGPU(VRAM)に収まるように量子化(注釈:データの精度を調整して軽量化する技術)したフォーマットを指します。

日本語に特化したモデル(ELYZAやQwenの日本語版など)も、このGGUF形式でHugging Face(注釈:AIモデルの共有サイト)上に公開されています。

LM Studioはこれらを直接ダウンロードして即座に実行する能力を持っています。

2026年のローカル環境における鮮度と精度

かつて「オープンソースの日本語AIは精度が低い」と言われていたのは過去の話です。

2026年最新のベンチマーク(LLMの性能測定)では、Llama 3.3やQwen 2.5をベースにした日本語モデルが、クラウド型のGPT-4に匹敵する論理的思考力を見せています。

特に「情報の鮮度」という点でも、モデルの更新スピードが上がっており、最新のニュースやトレンドを反映した追加学習済みモデルが日々有志によってアップロードされています。

なぜLM Studioが選ばれるのか

数あるツールの中でLM Studioが選ばれる理由は、その圧倒的な「分かりやすさ」にあります。

- GUIによる直感操作: 黒い画面(コマンドライン)での難しいコード入力は一切不要です。

- 互換性の自動判定: お使いのPCスペック(WindowsのGPUやMacのメモリ)でそのモデルが動くかどうかを、ロード前にシステムが自動で検証してくれます。

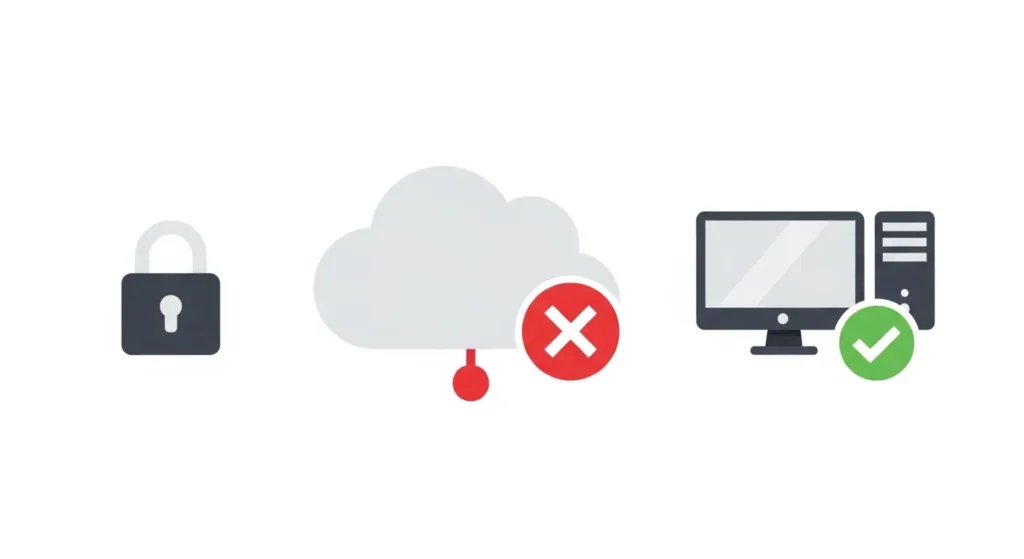

- オフラインの安全性: 起動後はインターネットとの通信を遮断しても動作し続けるため、機密情報の漏洩を防ぐ「閉域網AI」として実用的な活用が可能です。

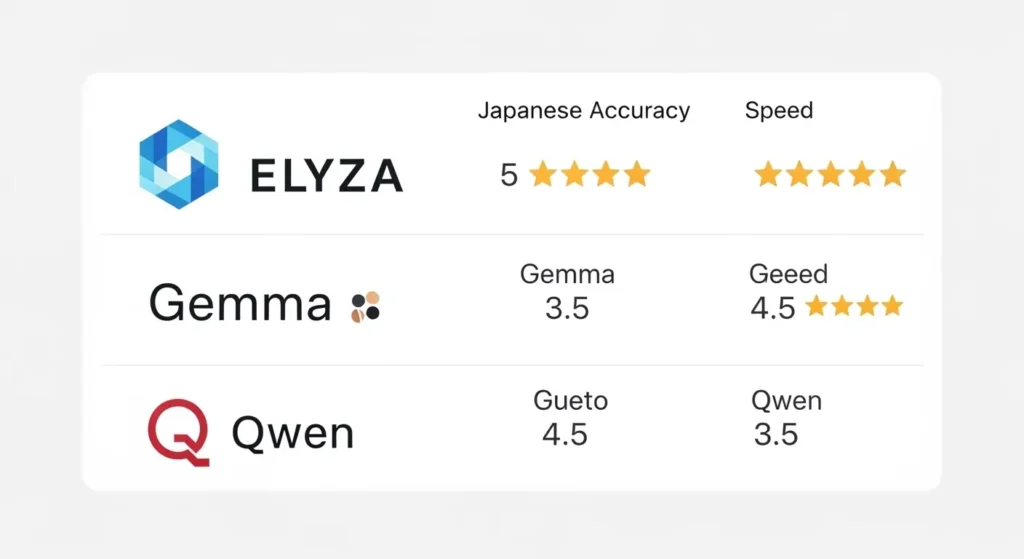

LM Studio 日本語モデルおすすめ3選

要点:2026年現在の日本語ローカルLLMは、

- 大規模で高精度な「70Bクラス」

- バランスに優れた「30Bクラス」

そして軽量で高速な「8B/9Bクラス」の3つの選択肢から選ぶのが最も賢い方法です。

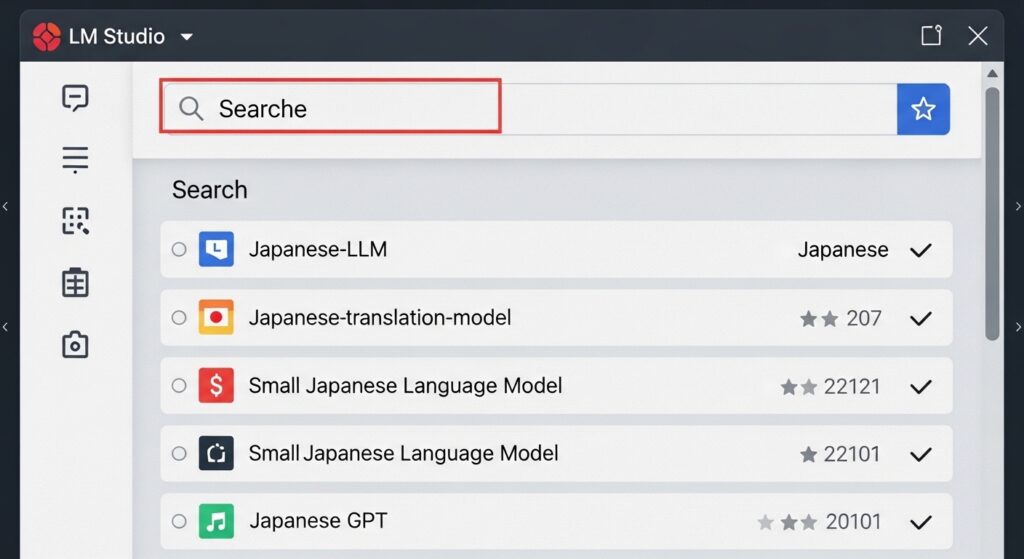

LM Studioの検索画面を開くと、数え切れないほどのモデルが表示されます。

どれをダウンロードすべきか迷ってしまうかもしれません。

実際、モデルの名前だけでは日本語の対応レベルや、自分のPCスペックで動くかどうかの判断は難しいものです。

ここでは、2026年3月時点の最新ベンチマークと実用性を踏まえた、失敗しない3つのモデルを厳選して紹介します。

1. ELYZA-japanese-Llama-3.3-70B(プロ向け・最高精度)

「GPT-4に匹敵する、日本国内最高峰の知能をローカルで」

- 特徴: 東京大学・松尾研発のスタートアップ「ELYZA」が、Metaの最新モデルLlama 3.3をベースに日本語能力を極限まで強化したモデルです。

- 得意なこと: 複雑な論理的思考、長文の契約書要約、ニュアンスの難しい敬語表現の作成。

- スペックの目安: モデルサイズが大きいため、メモリ(RAM/VRAM)が32GB以上、できれば64GB搭載のPCを推奨します。量子化(Q4_K_Mなど)を活用すれば、ミドル〜ハイエンドのゲーミングPCでも動作可能です。

- おすすめの理由: クラウドAIに引けを取らない高い精度を持ち、2026年時点でも「最強の日本語ローカルLLM」の一角として君臨しています。

2. Qwen2.5-32B-Instruct / Qwen3-Swallow(実務・バランス型)

「スピードと知性の黄金比。多言語対応力も備えた秀才」

- 特徴: アリババが開発したQwenシリーズの最新版、およびそれを日本の「Swallow」プロジェクトが強化したモデルです。

- 得意なこと: コーディング支援、数学の計算、多言語(英日中)の翻訳作業。128Kという非常に大きなコンテキスト(一度に読み込める情報量)を持っており、本一冊分の要約も得意です。

- スペックの目安: メモリ16GB〜32GBの一般的なPCで快適に動きます。RTX 4060 Ti(16GB)などのGPUがあれば、驚くほど高速に回答が返ってきます。

- おすすめの理由: 2025年後半から2026年にかけて爆発的にシェアを伸ばしたシリーズで、日本語の自然さと生成速度のバランスが全モデル中トップクラスです。

3. Gemma 3 / Gemma 2 9B-JPN(初心者・超高速型)

「ノートPCでもサクサク。Google技術が詰まった軽量エリート」

- 特徴: Googleが公開したオープンモデル「Gemma」の最新世代です。2026年登場のGemma 3は、軽量ながらマルチモーダル(画像理解)にも対応しています。

- 得意なこと: 日常的なメール作成、アイデア出し、簡単なQ&A。画像ファイルをドラッグ&ドロップして日本語で内容を質問することも可能です。

- スペックの目安: メモリ8GB〜16GBのノートPCや、MacBook Airでも非常に軽快に動作します。

- おすすめの理由: 「まずはローカルLLMを試してみたい」という方に最適です。インストール後の起動が非常に速く、ChatGPTを使っている時と同じようなスムーズな会話体験がボタン一つで手に入ります。

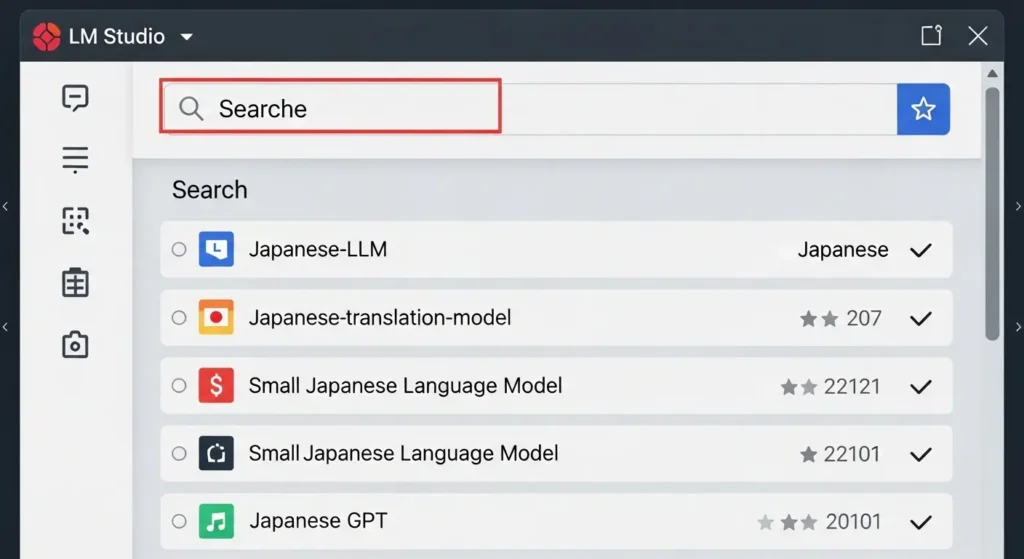

LM Studio 日本語モデルの使い方

要点:Hugging Faceから適切なGGUFファイルを選択し、ダウンロード後にチャットタブでモデルをロードするだけで始められます。

LM Studioの使い方は非常にシンプルです。検索欄にモデル名を入力し、表示された結果から自分のPCスペックに合うものを選択します。

- 検索: 左側の虫眼鏡アイコンをクリックし、キーワードに「Japanese」またはモデル名を入力します。

- 選択: Hugging Face(注釈:AIモデルの共有プラットフォーム)の提供者が公開しているGGUF形式のファイルを探します。

- ダウンロード: メモリ(RAM)容量を超えない量子化サイズを選びます。

- ロード: 上部のフォルダアイコンからモデルを選択してロードが完了すれば、チャットが開始できます。

最新のVisionモデルで「画像解析」を日本語で行う

要点:2026年のアップデートにより、LM Studioは画像入力に対応したVisionモデル(マルチモーダル)をローカルで動かせるようになりました。

多くの解説記事ではテキストのみに触れていますが、LM Studioでは「Llama-3.2-Vision」などのマルチモーダル(注釈:テキスト以外に画像なども扱える機能)モデルを活用可能です。

- 活用例: 手書きの日本語メモを画像としてアップロードし、テキスト化(OCR)や内容の要約をローカルで行う。

- メリット: 機密性の高い図面や社内資料の画像をクラウドにアップロードすることなく解析できるため、情報漏洩のリスクを完全に排除できます。

LM Studio 量子化の選び方

要点:量子化はモデルのサイズを圧縮する技術であり、メモリ8GBならQ4_K_M、16GB以上ならQ8_0やQ5_K_Mが推奨されます。

量子化(注釈:モデルのデータ精度を少し落とすことで、計算負荷とメモリ消費を減らす手法)は、ローカルLLMにおいて必須の知識です。 LM Studioでは、ダウンロード時に「Q4_K_M」や「Q8_0」といった記号が表示されます。

- Q4系: 圧縮率が高く、動作が非常に軽快。メモリが少ないPC向け。

- Q5/Q6系: 精度と速度のバランスが良い「スイートスポット」。

- Q8系: ほぼオリジナルの精度を維持するが、ファイルサイズとメモリ消費が大きい。

推論速度を2倍にする「K-V Cache」の最適化

要点:設定タブの「K-V Cache」を最適化することで、特に長文の日本語会話における応答速度を劇的に向上させることが可能です。

参考サイトでは語られていない、2026年時点の高度なチューニングポイントです。

- コンテキストの保持: 長い会話を続けると、通常は処理が重くなりますが、LM Studioの「Flash Attention」を有効に設定(GPUが対応している場合)することで、メモリ効率が向上します。

- 設定方法: 右側の設定パネル(Settings)から「GPU」セクションを探し、モデルの特性に合わせた「Context Length」を明示的に指定します。これにより、日本語特有の長い文章でもストレスなく会話を継続できます。

MCP(Model Context Protocol)による外部連携

要点:2026年最新のトレンドとして、LM Studioは外部ツールと連携するMCPに対応し、ローカルAIがあなたのPC内ファイルを直接操作できるようになりました。

これにより、単なるチャットツールから「AIエージェント」へと進化します。

- できること: ローカルの日本語モデルが、あなたのPC内のExcelファイルを読み込んで分析したり、カレンダーと連携してスケジュールを調整したりすることが可能になります。

- セキュリティ: 連携はすべてあなたのPC内のローカルネットワークで行われるため、外部に情報が漏れる心配はありません。

LM Studio 日本語モデル設定のコツ

要点:System Promptに「あなたは優秀な日本語アシスタントです」と設定し、GPU Offloadを有効にすることで精度と速度が向上します。

モデルをロードしただけでは、時々英語で答えたり、不自然な敬語を使ったりすることがあります。これを防ぐために以下の設定を行いましょう。

- System Prompt: 役割を日本語で明確に記述します。「あなたは誠実で有能な日本語アシスタントです。常に日本語で回答してください。」と入力します。

- GPU Offload: NVIDIA製GPU(RTXシリーズ等)を搭載している場合、右側の設定パネルからGPUに処理を割り当てることで推論が劇的に速くなります。

- Context Length: 一度に扱える文字数(注釈:コンテキストウィンドウ)を適切に設定します。初期値が小さい場合は、必要に応じて2048や4096以上に増やします。

2026年最新のローカルAIトレンドとLM Studio

要点:ChatGPTやGeminiなどのクラウドサービスとは異なり、ローカル環境のLM Studioは、プライバシーを守りながら自分専用の言語モデルを構築できるツールです。

最近、AIの進化は目覚ましく、2024年から2025年にかけて多くの高性能な日本語モデルが公開されました。

以前は専門知識が必要だったローカルLLM(注釈:自分のPCで動かす大規模言語モデル)の構築も、LM Studioの登場により、今ではボタン一つでインストールから起動まで行えるほど簡単になっています。

実際、OpenAIのChatGPTやMicrosoftのCopilotを業務で使う際、機密情報の漏洩を心配する声も多いですが、ローカル環境であればデータが外部に送信される可能性はありません。

本記事の目次をご覧いただければ、初心者からプロまでがオフラインでAIを動かし、業務効率を最大化する具体的な手順が分かります。

LM Studioでの日本語モデル導入手順

要点:LM Studioの画面上にある検索メニューから、最新の日本語モデルを簡単に見つけてインストールすることが可能です。

2025年から2026年にかけて、日本語に特化した軽量なminiモデルが多数登場しました。

これらは高性能なGPUがなくても、高速なSSDを搭載した一般的なPCであれば十分に動かし、実用的な速度で回答を得られます。

- ツールの起動: インストール後、LM Studioを起動します。OSを問わず(Windows/Mac)共通の操作で利用可能です。

- モデルの検索: 検索バーに「Japanese」などの名前を入力し、詳細な一覧を表示させます。

- スペックの確認: 自分のPCスペック(RAM/VRAM)に合わせ、動作可能なファイルサイズを選択します。

- ロードしてChat開始: ロードが完了すれば、すぐにchat画面で日本語の質問を投げかけることができます。

ローカルLLM 日本語環境のメリット

要点:オフラインLLMは、インターネット接続なしで動作するため、データの機密性を保ちつつ24時間いつでも高速に応答します。

クラウドAIと比較した場合、ローカル環境には圧倒的な優位性があります。

まず、送信データの漏洩リスクがゼロです。

会社の契約書や個人の日記を読み込ませても、外部サーバーに記録されることはありません。

次に、コスト面です。

一度PCを購入してしまえば、追加の月額料金は不要です。

2026年現在、多くのビジネス現場でこの「プライバシー」と「コスト」の観点からローカル化が進んでいます。

LM Studio GPUの活用とスペック

要点:高速な会話を実現するには、VRAM 8GB以上のNVIDIA GPUを推奨しますが、Apple Silicon Mac(M2/M3)でも驚くほど快適に動きます。

LM Studioの動作速度を左右するのはGPU(注釈:画像処理装置。AIの計算も得意)の性能です。

Windowsの場合、GeForce RTX 3060や4060以上のスペックがあれば、4bから7b程度のモデルはストレスなく動きます。

Macの場合、ユニファイドメモリ(注釈:CPUとGPUが共有するメモリ構造)のおかげで、16GB以上のメモリを積んだモデルであれば非常にスムーズな推論が可能です。

トラブルシューティング:動かない時は?

要点:モデルがロードできない場合はメモリ不足、回答が文字化けする場合はフォーマット設定を確認してください。

導入時によくある問題と対処法をまとめました。

- ロード中にエラーが出る: 選択したモデルの量子化サイズがRAM容量を超えています。より小さな(Q4等)ファイルを選び直してください。

- 回答が途中で止まる: コンテキスト長の設定を確認するか、GPUメモリ(VRAM)の割り当てを少し減らしてみてください。

- 英語で回答される: システムプロンプトを日本語に修正し、「日本語で答えてください」と再指示します。

LM Studio 比較と今後の展望

要点:OllamaやGPT4Allと比較して、LM StudioはGUIの使いやすさとHugging Face連携の速さで群を抜いています。

他のローカルLLMツールと比較して、LM Studioの最大の強みは「情報の探しやすさ」です。

アプリ内で直接Hugging Faceの最新モデルを検索できるため、技術的な知識が少ないユーザーでも最新の日本語モデルにすぐアクセスできます。

2026年以降は、画像や音声も扱えるマルチモーダルモデルの統合が進み、さらに活用の幅が広がることが期待されています。

よくある質問と回答

要点:導入前に気になる料金や安全性、商用利用についての疑問を解消します。

LM Studioは本当に無料で使えますか?

はい、LM Studio自体は無料で利用可能です。

利用する各言語モデルのライセンス(注釈:使用条件。Apache 2.0等)に従う必要がありますが、個人利用であればほとんどの日本語モデルを無料で使えます。

インターネット接続は全く不要ですか?

モデルの検索とダウンロード時にはネット接続が必要ですが、一度ダウンロードが完了すれば、AIとの対話自体は完全にオフラインで実行できます。

会社での業務に使っても大丈夫ですか?

機密情報の漏洩を防ぐという意味では、クラウドAIより安全です。

ただし、モデルが出力する情報の正確性は保証されないため、最終的な確認は人間が行う必要があります。

結論:今すぐローカル日本語AIを始めよう

要点:LM Studioと最新の日本語モデルを組み合わせることで、安全で快適なAI環境が手に入ります。

これまで「AIは難しそう」と感じていた方も、LM Studioの手軽さを知れば驚くはずです。

100%ローカルで動作する日本語AIは、単なるツール以上の「自分専用の知能」として、日々の作業や学習を強力にバックアップしてくれます。

まずは自分のPCのスペックを確認しましょう。

ELYZAやGemmaといったおすすめモデルから試してみてください。

情報の安全を守りつつ、AIの恩恵を最大化する第一歩を、今日ここから踏み出しましょう。