「ChatGPTのようなAIを、自分のPCだけで、機密情報を守りながら無料で動かしたい」

そんな願いを叶えるのが、ローカルLLM環境構築ツールです。

現在、その選択肢として圧倒的なシェアを誇るのが「LM Studio」と「Ollama」。

しかし、エンジニアから初心者まで、多くのユーザーが「どちらをインストールすべきか?」という悩みを抱えています。

本記事では、AIエンジニアの視点から両ツールを徹底比較。

結論から言えば、

- 「直感的な操作性を重視するならLM Studio」

- 「開発やサーバー運用への組み込みを重視するならOllama」

が正解です。

この記事を読み終える頃には、あなたのPCスペックと目的に最適なツールが明確になります。

すぐにでもローカルAIライフをスタートできるはずです。

ローカルLLM環境構築の基本

要点:自分のPCリソース(GPU/CPU)のみを使用してAIを動かすことで、プライバシー保護とコスト削減を両立できます。

最近、企業や個人開発者の間で「ローカルLLM(大規模言語モデル)」への注目が急上昇しています。

OpenAIのChatGPTやGoogleのGeminiといったクラウド型サービスとは異なります。

手元のPC内で完結するため、外部へデータが送信されるリスクがありません。

機密情報を扱う業務や、インターネット接続がないオフライン環境での利用に最適です。

構築のポイントは、自身のPCのOS(Windows, Mac, Linux)やメモリ(RAM/VRAM)容量に合ったツールを選ぶことです。

LLM推論とGPU推論の仕組み

LLM(大規模言語モデル)を動かす際、最も重要なのが「推論」と呼ばれるプロセスです。

これは学習済みのモデルにプロンプトを入力します。

回答を出力する処理を指します。

この推論を高速化するのがGPU(グラフィックスプロセッシングユニット)です。

特にNVIDIA製のGPUに搭載されているCUDAコアを活用することで、CPUのみの処理と比べて圧倒的な速度向上を実現します。

量子化モデル(GGUF)の重要性

ローカルPCでは、数GB〜数十GBという巨大なモデルをそのまま扱うのは困難です。

そこで「量子化」という技術が使われます。

モデルの精度を極力維持しつつ、サイズを軽量化する手法です。

LM StudioやOllamaでは、この量子化された「GGUF」というファイル形式が主に採用されています。

ローカルLLM環境構築のメリット

要点:2025年から2026年にかけて、プライバシー保護とコスト削減の観点から、クラウドに依存しないローカル環境でのAI運用が一般的になっています。

多くの会社がAI導入を検討する際、機密情報の流出を最も懸念します。

ChatGPTのようなクラウド型gptサービスとは異なります。

ローカル環境はインターネットへのアクセスなしで動作します。

極めて高いセキュリティを維持できます。

また、一度環境を構築すれば、月額の利用料金を気にせず仕事に活用できる点も大きな魅力です。

プライバシー重視のモデル選択

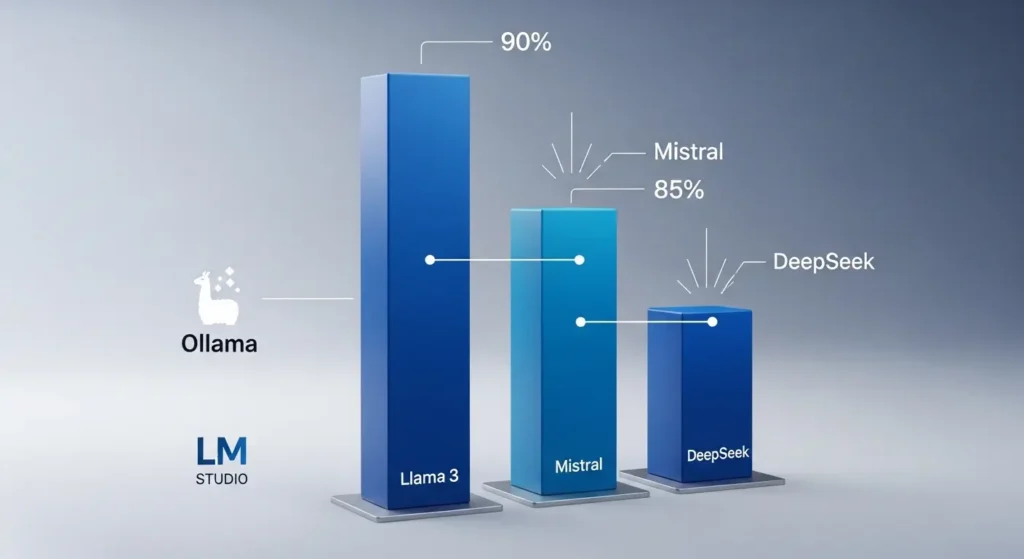

ローカルで動かすモデルとして、

- MetaのLlamaシリーズやMistral

- GoogleのGemma

などが人気です。

これらはオープンなライセンスで提供されていることが多く、用途に合わせて最適なモデルを選択できます。

特に小型のモデルであれば、一般的なデスクトップPCでも十分に実用的な速度で動作します。

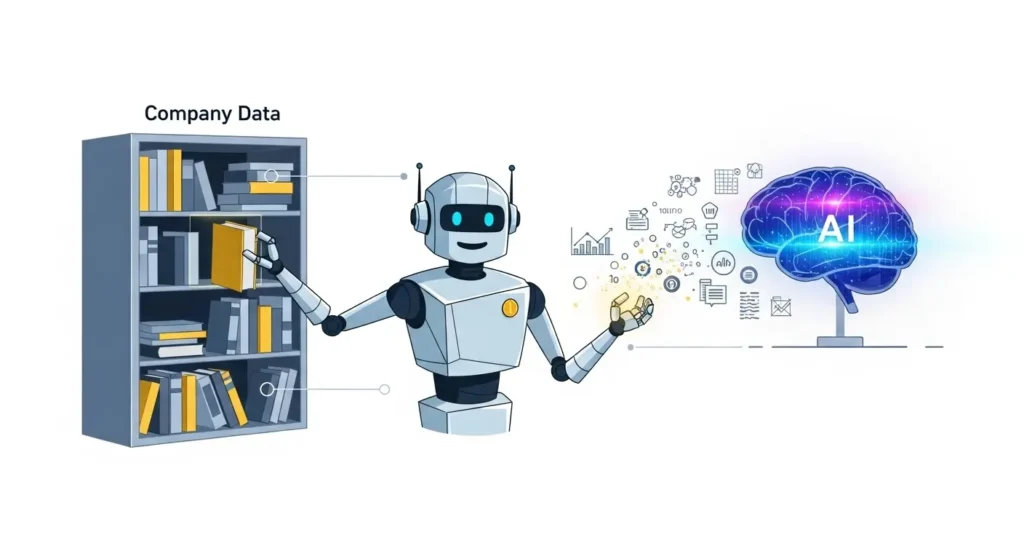

RAGによる社内資料の活用

RAG(検索拡張生成)という手法を使えば、社内のドキュメントや資料をAIに参照させ、専門的な質問に答えさせることが可能です。

これにより、非エンジニアの担当者でも、膨大な過去データから必要な情報を即座に引き出せるようになりました。

業務効率が大きく向上します。

LM StudioとOllamaの具体的な比較

ローカルLLM環境構築において、LM StudioとOllamaはどちらも「llama.cpp」をベースとした強力な推論エンジンを備えています。

しかし、その設計思想と実用面でのアプローチは大きく異なります。

インターフェースとユーザー体験(UX)

要点:視覚的な操作を好む一般ユーザー向けのLM Studio。

対して、Ollamaはエンジニアがターミナルで完結できるシンプルさを追求しています。

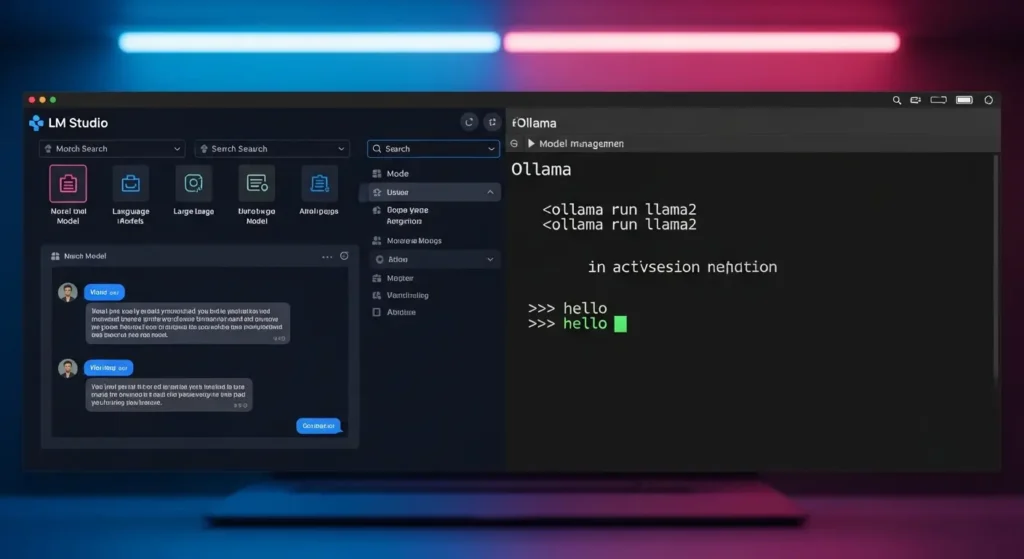

LM Studioは、macOSやWindowsのデスクトップ環境に最適化されたGUI(グラフィカルユーザーインターフェース)を提供します。

画面上の検索バーからHugging Face上のモデルを直接ダウンロードできます。

量子化レベル(Q4_K_Mなど)を一覧から選択するだけで、誰でも簡単にAIを使いこなすことが可能です。

対してOllamaは、CLI(コマンドラインインターフェース)を中心とした設計です。

バックエンドでサーバーとして常駐します。

デスクトップに余計なウィンドウを表示させたくないエンジニアに向いています。

コマンド一つでモデルをpull(ダウンロード)し、即座にチャットを開始できるスピード感は圧倒的です。

GPU推論とリソース管理の柔軟性

要点:詳細なハードウェア調整が可能なLM Studioと、自動最適化で手間を省くOllamaという対比が鮮明です。

- LM Studioの柔軟性:GPU Offloadのスライダーを調整することで、VRAM(ビデオメモリ)にどれだけのレイヤーを割り当てるかを1刻みで設定できます。これは、メモリ容量が限られたPCで、最大限のパフォーマンスを引き出す際に非常に便利な機能です。

- Ollamaの自動最適化:Ollamaは起動時にシステムのスペックを自動で認識し、最適なVRAM割り当てを自動で行います。複雑な設定をスキップして、すぐに実用レベルの推論速度を得られるのが強みです。

外部連携とエコシステムの広がり

要点:OpenAI互換APIサーバーとしての能力は共通していますが、拡張性の方向性が異なります。

LM Studioは、ローカルサーバーを起動することで、既存のChatGPT向けに作られたアプリの接続先を「localhost」に変更するだけで利用できる高い互換性を持ちます。

Ollamaは、Dockerライクな「Modelfile」によるカスタマイズが特徴的です。

システムプロンプトや温度パラメータを固定した独自モデルを作成します。

それをライブラリとして管理・共有できるため、特定の業務に特化したAIエージェントの構築に適しています。

2026年時点では、Python SDKやJavaScript SDKの充実により、自社システムへの組み込みコストが大幅に低減されています。

2026年最新の比較表:どちらを選ぶべきか

| 比較項目 | LM Studio | Ollama |

| 主な操作 | GUI(マウス操作) | CLI(コマンド操作) |

| モデル検索 | アプリ内で直接検索 | コマンドで指定(library参照) |

| カスタマイズ | スライダーによる視覚的調整 | Modelfileによるコード記述 |

| マルチモーダル | 画像ドラッグ&ドロップ対応 | API/CLI経由での画像入力 |

| 推奨ユーザー | 初心者、非エンジニア、デザイナー | エンジニア、データサイエンティスト |

独自の活用事例:ハイブリッド運用のススメ

実は、これら2つのツールは共存が可能です。

モデルの試行錯誤やパラメータの微調整にはLM Studioを使います。

安定したワークフローやAPIサーバーとしての常時稼働にはOllamaを採用します。

つまり、「いいとこ取り」の使い分けが最も効率的です。

自身のPCスペックや、解決したい課題が「対話」なのか「自動化」なのかを基準に、最適な選択を行ってください。

実践的な使いこなしガイド

要点:導入から応用まで、自身のスキルレベルに合わせたステップを踏むことで、ローカルLLMの能力を最大限に引き出すことが可能です。

2026年現在、単にAIとチャットするだけではありません。

特定の業務を自動化する「エージェント」としての活用が注目されています。

ここでは、初心者から中級者までが実践できる具体的な導入ステップと、実用的なカスタマイズ方法を紹介します。

ステップバイステップでの導入と初期設定

まずは自分のPC環境を整え、最初のモデルを動かすところから始めましょう。

- 公式サイトの参照と準備: LM Studio(lmstudio.ai)やOllama(ollama.com)の公式サイトから、最新のインストーラーをダウンロードします。macOSであればApple Silicon搭載機、WindowsであればNVIDIA製GPU搭載機が、高いパフォーマンスを発揮するための推奨条件です。

- モデルの選択と登録: 最初は汎用性の高い「Llama 3.1」や、日本語能力に定評のある「Gemma 2」のダウンロードをおすすめします。LM Studioでは検索画面からクリック一つで、Ollamaではターミナルに

ollama run gemma2と入力するだけで登録が完了します。 - 推論速度の確認と調整: 回答の生成速度が遅い(カクつく)場合は、量子化レベルを下げた軽量モデルを試すか、GPUオフロードの設定を見直しましょう。

RAGを活用した独自資料の読み込み

自社のドキュメントや専門資料をAIに参照させる「RAG」は、ローカル運用で最も価値のある機能の一つです。

- 外部ツールの連携: LM Studioのローカルサーバー機能を有効にし、「AnythingLLM」や「Dify」といったOSSのRAGプラットフォームと接続します。

- 情報のインデックス化: PDFやテキストファイルを読み込ませることで、AIがあなたのPC内の情報に基づいた回答を生成するようになります。これにより、機密性の高い社内規定やプロジェクト資料の要約が安全に行えます。

非エンジニアでもできるDX推進と自動化

プログラミングができなくても、既存の生成AIツールと組み合わせることで業務効率を大きく向上させられます。

- 翻訳と文章校正の自動化: プロンプトに「以下の文章をプロフェッショナルな日本語に翻訳して」とテンプレートを設定しておくことで、DeepLを超える精度の翻訳環境をオフラインで構築できます。

- Modelfileによる性格付け: Ollamaの「Modelfile」機能を使い、あらかじめ特定の役割(プログラミング講師、法務アドバイザーなど)を与えたカスタムモデルを作成します。一度設定すれば、次回からはその名前を呼び出すだけで専門的なアドバイスが得られます。

セキュリティと運用の注意点

ローカル環境だからこそ、リソースの管理とデータの扱いに注意が必要です。

- インターネット接続の管理: 完全にセキュアな環境を求めるなら、モデルダウンロード後にファイアウォールで通信を遮断し、完全オフラインで運用することを検討してください。

- VRAM消費のモニタリング: 長時間の使用やマルチモーダル(画像解析)の使用は、GPUメモリを大きく消費します。PCの動作が重くなった際は、一度モデルをアンロードする習慣をつけましょう。

LM Studioの使い方の特徴

要点:プログラミング知識が不要で、検索から実行までをマウス操作のみで完結できる、初心者にとって最高に使いやすいツールです。

LM Studioは、デスクトップアプリケーションとして提供されているGUI(グラフィカルユーザーインターフェース)重視のツールです。

Hugging Face(AIモデルの共有プラットフォーム)と直接連携しています。

アプリ内の検索バーから欲しいモデルをすぐにダウンロードできます。

LM Studioのインストール手順

公式サイトからインストーラーをダウンロード。

実行するだけでセットアップは完了します。

- Mac(Apple Silicon対応)

- Windows

- Linux

上記の各OS向けに版が用意されております。

専門的なコマンド操作は一切不要です。

優れたUIとモデル管理機能

LM Studioの強みは、ダウンロードしたモデルの切り替えが容易である点です。

スライダーを動かすだけでGPUへの負荷を調整したり、コンテキストウィンドウのサイズを変更したりと、直感的なカスタマイズが可能です。

また、OpenAI互換のローカルサーバー機能も備えております。

既存のアプリケーションと簡単に連携できます。

Ollamaの使い方の特徴

要点:コマンドライン(CLI)で動作する軽量なツールであり、サーバーへの組み込みやエンジニアによる自動化に最適です。

Ollamaは、ターミナル上で「ollama run llama3」といった短いコマンドを打つだけで、即座にAIを起動できるツールです。

バックエンドでサーバーとして常駐する仕組みのため、他のアプリやSDKからの呼び出しに非常に優れています。

Ollamaの導入とコマンド操作

インストール後、ターミナルから「ollama」コマンドが使えるようになります。

例えば、

- Metaが公開した「Llama 3」

- Microsoftの「Phi-3」

- Googleの「Gemma 2」

などの主要なモデルを、わずか数秒のダウンロードで試すことができます。

開発者向けの強力なAPI機能

Ollamaは標準でREST APIを提供しております。

PythonやJavaScriptなどの言語から簡単にリクエストを送ることができます。

また、Dockerのように「Modelfile」を作成することで、独自のパラメータ設定やシステムプロンプトを持ったカスタムモデルを容易に構築できるのが最大の魅力です。

LM Studio Ollama 比較 性能

要点:単純な推論速度(ベンチマーク)に大きな差はありませんが、リソース管理の柔軟性において違いがあります。

両者とも内部的には「llama.cpp」という高性能なライブラリを使用しているため、同じハードウェアであれば生成速度(トークン/秒)に劇的な違いは出ません。

しかし、細かな挙動に個性があります。

LM Studio Ollama 比較 設定の自由度

LM Studioは、GUI上の設定パネルから視覚的に量子化のレベルやGPUオフロードの割合を調整できます。

一方、Ollamaはデフォルト設定が非常に優秀です。

ユーザーが何も考えずともPCのスペック(16GB RAMなど)に合わせて最適に動作するよう設計されています。

LM Studio Ollama 比較 インストールの手軽さ

どちらも公式サイトからダウンロード可能ですが、WindowsユーザーはLM Studioのほうが「アプリ感」が強く馴染みやすいでしょう。

Macユーザーの場合、Homebrewを使ってコマンドで管理したいならOllamaが有力な選択肢となります。

独自性1:2026年最新のマルチモーダル対応

これまでの比較記事ではテキストモデルのみが焦点でした。

2026年現在、両ツールとも画像入力を受け付ける「マルチモーダルモデル」への対応が大幅に強化されています。

LM Studioでは画像をチャット欄にドラッグ&ドロップするだけで解析が可能。

OllamaもAPI経由で画像データを送信します。

瞬時にキャプション作成や内容要約を行うことが可能です。

独自性2:MCP連携による外部ツール操作

最新のトレンドとして、Anthropicが提唱した「MCP(Model Context Protocol)」への対応が挙げられます。

これにより、ローカルで動くLLMが、あなたのPC内のローカルファイルやGoogleカレンダー、GitHubのリポジトリと直接連携してタスクを実行する「エージェント化」が容易になりました。

この連携のしやすさでは、現在Ollamaが一歩リードしています。

独自性3:企業導入時の情報セキュリティ戦略

法人向けに社内チャットボットを導入する際、単に動かすだけでなく「ガバナンス」が求められます。

LM Studioは個別PCでのプロトタイピングに、Ollamaは中央サーバーに設置して複数の社員がAPI経由で利用する、といった使い分けの事例が増えています。

よくある質問と回答

要点:初心者から上級者までが抱える、導入時の不安や疑問を解消します。

ローカルLLMを動かす推奨スペックは?

最低でも8GBのRAMが必要ですが、16GB以上あると快適です。

特にNVIDIAのRTXシリーズなど、VRAMを搭載したGPUがあると、大規模なモデル(70Bパラメータなど)も高速に動かせます。

MacならM1/M2/M3チップ搭載モデルであれば、メインメモリをVRAMとして共有できるため非常に優秀です。

どちらのツールが無料で使えますか?

両方とも基本機能は完全に無料です。オープンソース(OSS)の精神に基づき、誰でも自由にダウンロードして利用できます。

商用利用は可能ですか?

ツール自体のライセンス(MIT Licenseなど)は商用利用可能ですが、動かす「モデル」のライセンス(Llama 3やApache 2.0など)に依存します。

各モデルの利用規約を必ず確認してください。

まとめ:あなたに最適な選択肢

要点:自分の「好み」と「用途」を整理して、まずは一つインストールしてみましょう。

ここまでLM StudioとOllamaを比較してきましたが、結論は以下の通りです。

- LM Studioを選ぶべき人:

- マウス操作で手軽にいろんなモデルを試したい。

- 視覚的にGPUの設定をいじりたい。

- まずはChatGPTと同じ感覚でチャットを楽しみたい。

- Ollamaを選ぶべき人:

- エンジニアリングやコーディングの支援に使いたい。

- 自作アプリにAI機能を組み込みたい。

- 軽量・高速なバックエンドサーバーとして運用したい。

どちらを選んでも、2026年のAI進化を自分の手元で体験できることに変わりはありません。機密情報を守りながら、自由な発想でローカルLLMを使いこなしてください。

相談窓口

要点:ローカルLLMの世界は日々進化しており、どのツールが自分に適しているかは、実際のユースケースに依存します。

本記事で紹介したLM StudioとOllamaは、どちらも2026年現在、ローカルAI分野のトップを走る信頼性の高いサービスです。

- 充実した機能を持つLM Studio

- 拡張性に優れたOllama

あなたの現在のスキルレベルと目的を天秤にかけて選んでみてください。

もし、法人としての導入や具体的なシステム構築についてより詳細な情報や個別の相談が必要な場合は、専門のエンジニアや株式会社などのサポート企業へ問い合わせることも一つの手です。