- 自分のPCでAIを育てる贅沢

- ローカルLLMのメリットと構築の意義

- 2026年のローカルAIトレンドと導入の背景

- ローカルLLM 推論エンジンの比較と選定

- 必要スペックとハードウェアの選び方

- 2026年版「VRAM不足」を解消する最新技術

- llama.cpp 使い方の徹底解説

- ollamaの使い方と環境構築

- モデルの選定:日本語に強いのはどれ?

- 実践!ステップバイステップ構築ガイド

- LangChain ローカルLLMの高度な活用

- LangChainを活用した自律型チャットボットの構築

- よくある質問と回答(FAQ)

- 2026年最新の「スモールモデル」トレンド

- セキュリティを極限まで高める「閉域網AI」の構築

- エネルギー効率を最大化する「量子化ビット」の選び方

- トラブルシューティング:動かない時のチェックリスト

- 今後の展望:あなたのPCが「脳」になる日

- 結論:ローカルLLM構築で自由をその手に

自分のPCでAIを育てる贅沢

要点:ローカルLLMの作り方をマスターすれば、機密情報を外部に送信せず、自分専用のai環境をオフラインで100%活用できるようになります。

最近、ChatGPTやGeminiといったクラウド型aiが普及し、誰でも手軽に高度な知能を利用できるようになりました。

しかし、仕事で機密データを扱う際や、プライバシーを重視する場面で、入力した内容が外部サーバーに送信されることに不安を感じたことはありませんか。

そこで今、世界中のエンジニアや個人開発者が注目しているのが、ローカルLLM(大規模言語モデル)の構築です。

一昔前までは、スーパーコンピューターのような高性能な設備が必要だと思われていました。

現在はllama.cppやollamaといったツールの進化により、一般的なゲーミングpcやMacBookでも驚くほど簡単にaiを動かせるようになっています。

この記事では、

- ローカルLLM作り方の基本

- スペック別のモデル選定

- 具体的なインストール手順

までをPREP法に基づき徹底解説します。

最後まで読むことで、あなたも自分だけのaiエージェントを手に入れる第一歩を踏み出せるはずです。

ローカルLLMのメリットと構築の意義

要点:ローカルLLMの構築は、単なる技術的な興味を超え、情報の安全性、経済性、そして自分自身の知能を拡張するための戦略的な投資となります。

2026年、AIは「借りるもの」から「所有するもの」へと進化しました。クラウドAI(ChatGPTなど)は便利ですが、常に外部のプラットフォームに依存し、データを提供し続ける必要があります。一方、ローカルLLMを自作することは、知能の主権を自分自身の手に取り戻すことを意味します。ここでは、構築によって得られる具体的なメリットと、その深い意義について掘り下げます。

究極のプライバシー保護とセキュリティ

構築の最大の意義は、機密情報を物理的に隔離できる点にあります。

クラウドAIの場合、入力されたプロンプト(指示文)は暗号化されているとはいえ、運営会社のサーバーへ送信されます。

利用規約によっては学習データとして再利用されるリスクが残ります。

- データの非公開性: 顧客情報、社外秘のプロジェクト資料、未発表のソースコードなどを、インターネットから完全に遮断された状態(エアギャップ環境)で処理できます。

- ガバナンスの維持: 企業において、外部サービスへのデータ送信を禁止している厳しいセキュリティポリシー下でも、生成AIの恩恵を受けることが可能になります。

ランニングコストの完全な撤廃

アドセンス月収30万円を目指すようなブロガーや、大量のコンテンツを生成するビジネスマンにとって、コスト効率は極めて重要です。

クラウドAIのAPI利用料は、大規模なタスクを実行するほど雪だるま式に膨らみます。

- サブスクリプションからの解放: 一度PC(ハードウェア)に投資してしまえば、月額の課金やトークン(注釈:AIが処理する文字の単位)ごとの支払いは不要です。

- 無制限の試行錯誤: 失敗を恐れず、何度でもプロンプトを投げ、モデルを回し続けることができます。この「回数制限のない自由」が、AIスキルの向上を加速させます。

用途に応じた自由なカスタマイズ

クラウドAIは「万人のための汎用的な回答」を返しますが、ローカルLLMは「あなただけの専門家」に育て上げることが可能です。

- モデルの選定: 文学的な表現に強いモデル、コーディングに特化したモデル、特定の専門知識を持つモデルなど、目的(タスク)に合わせて最適な「脳」を自由に入れ替えることができます。

- RAG(検索拡張生成)の活用: 自社のマニュアルや過去の膨大な日記などを読み込ませることで、世界中の誰も知らない、あなただけの内部情報に基づいた正確な回答を得られます。

- パラメータの微調整: 生成される文章の「温度感(創造性の度合い)」や「長さ」を、ツールのスライダー一つでミリ単位で調整できるのは、ローカル環境ならではの贅沢です。

知能の永続性とインフラ化

クラウドサービスは、運営会社の都合により突然の仕様変更、値上げ、あるいはサービスの終了が起こり得ます。

- 依存からの脱却: 自分のPCに構築した環境は、あなたが望む限りそこにあり続けます。特定の企業にあなたの知能の基盤を握らせないことは、2026年のデジタル社会において極めて重要なリスクヘッジです。

- オフライン動作: 災害時や通信障害時でも、手元のPCが動く限り、aiアシスタントはあなたの思考を助け続けてくれます。

2026年のローカルAIトレンドと導入の背景

要点:2026年、個人情報の保護とインターネット接続の不安定さに左右されない業務効率化を求め、多くの組織がローカルLLMの導入を本格化させています。

AI技術の急速な進化により、以前よりも手軽に高性能な知能を扱える時代となりました。

しかし、Microsoft CopilotやChatGPTといった便利なサービスがある一方で、データの送信を伴うクラウドAIには情報漏洩の懸念が常に付きまといます。

そこで、今回紹介するローカルLLM作り方は、自分自身のpc内に完全に閉じた環境を作ることで、これらの課題を解決します。

実際、2024年から2025年にかけて、国内のIT業界や法人向けソリューションの現場では、セキュリティ対策を最優先した「オンプレミス型AI」のニーズが急激に高まってきました。

本記事の目次をご覧いただければ、初心者でも迷わず、安全に、そして無料で最強のAI環境を自作する手順が分かります。

ローカルLLM 推論エンジンの比較と選定

要点:推論エンジンはAIの「心臓部」であり、使用するOSや目的(プログラミング、執筆、分析)に合っているかを確認することが重要です。

ローカルLLM作り方において、最初に直面する選択肢は「どの推論エンジンを使うか」という点です。

2026年現在、主要な3つの選択肢を一覧で比較します。

- Ollama (CLI中心): インストールが最も簡単で、名前を入力するだけで最新モデルが動きます。バックグラウンドでの管理が優秀で、他のアプリとの連携に特化しています。

- LM Studio (GUI中心): 画面を見ながらマウス操作で設定変更ができ、スペックの検証も自動で行ってくれるため、非エンジニアの方に非常に高い評価を得ています。

- llama.cpp (専門・開発者向け): 最も細かいチューニングが可能で、メモリ(GB)を節約しつつ、極限まで性能を引き出したい際に向いています。

必要スペックとハードウェアの選び方

要点:ローカルLLM 推論の快適さは、GPUのVRAM容量と帯域幅に最も左右されます。

2026年現在は、メモリを共有するApple Silicon Macや、最新のRTX 50シリーズが主要な選択肢です。

ローカルLLM作り方において、ハードウェア選定は最も頭を悩ませるポイントです。

2026年時点では、モデルの「軽量化」とハードウェアの「高出力化」が同時に進み、予算に応じた幅広い選択肢が存在します。

失敗しないための選定基準を、エンジニアの視点で整理しました。

GPU:VRAM容量が推論の「限界」を決める

GPU(グラフィックスプロセッシングユニット)は、AIの計算を担うエンジンです。

特に重要なのは計算速度よりも「VRAM(ビデオメモリ)」の容量です。

モデルのデータがこのVRAMに収まりきらない場合、速度は極端に低下します。

- RTX 5090 (32GB): 2026年のフラッグシップ。70Bクラスのモデルを4bit量子化(注釈:データを圧縮する技術)状態で高速に動かせる最強の選択肢です。

- RTX 5080 / 4090 (24GB): 中〜大規模モデル(30B〜70B)をターゲットにする際の標準スペック。推論速度とコストのバランスに優れています。

- RTX 5060 Ti / 4060 Ti (16GB): コスパ重視の100%おすすめモデル。8B〜14Bクラスを余裕を持って動かせ、簡単なコーディング支援や要約に最適です。

Apple Silicon Mac:メモリ共有の圧倒的メリット

Mac(M2/M3/M4 Maxなど)は、CPUとGPUが同じメモリを共有する「ユニファイドメモリ」を採用しています。

これにより、Windows機では困難な「巨大モデルの動作」を比較的安価に実現できます。

- Mac Mini / MacBook Pro (48GB以上のメモリ): 2026年において「最も賢い投資」の一つ。48GB以上のメモリがあれば、70Bクラスのモデルを単体で動かすことが可能です。

- メリット: 複雑な設定なしに大規模モデルを試せる点。

- デメリット: NVIDIA製GPUに比べると、1秒あたりの文字生成数(トークン速度)では一歩譲る傾向があります。

メインメモリ(RAM)とストレージ(SSD)

GPUメモリにモデルが入り切らない場合のバックアップとして、システムメモリ(RAM)が使われます。

- RAM (メインメモリ): 最低でも32GB、理想は64GB以上です。最近のMoEアーキテクチャ(注釈:複数の専門家モデルを切り替えて使う効率的な仕組み)では、メインメモリの容量が動作の安定性に直結します。

- SSD (ストレージ): NVMe Gen4またはGen5が必須です。10GB〜50GBを超える巨大なモデルファイルを数秒でロードし、チャットを即座に開始するために欠かせません。

2026年版「VRAM不足」を解消する最新技術

要点:単体GPUの限界を超えるため、2026年は「複数GPUの連結」や「分散推論」が実用レベルに達しています。

これまでの解説サイトでは「1枚のGPUで何ができるか」が語られてきましたが、本記事ではさらに一歩進んだ2026年流の解決策を提示します。

デュアルGPUによる48GB環境の構築

中古のRTX 3090(24GB)を2枚差しにする構成は、2026年でも依然として「最もコスパ良く大規模モデルを動かす」裏技です。

合計48GBのVRAMがあれば、最新のLlama 3.3 70Bをほとんど劣化させずにローカルで運用できます。

ExoLabsなどの分散推論ツールの活用

- 「古いPCが余っている」

- 「MacとWindowsの両方がある」

という場合、ネットワーク経由でそれぞれのメモリを合算して一つのLLMを動かす「分散推論(Disaggregated Inference)」が注目されています。

これにより、一台では力不足な環境でも、チーム内のリソースを統合して巨大な知能を構築することが可能です。

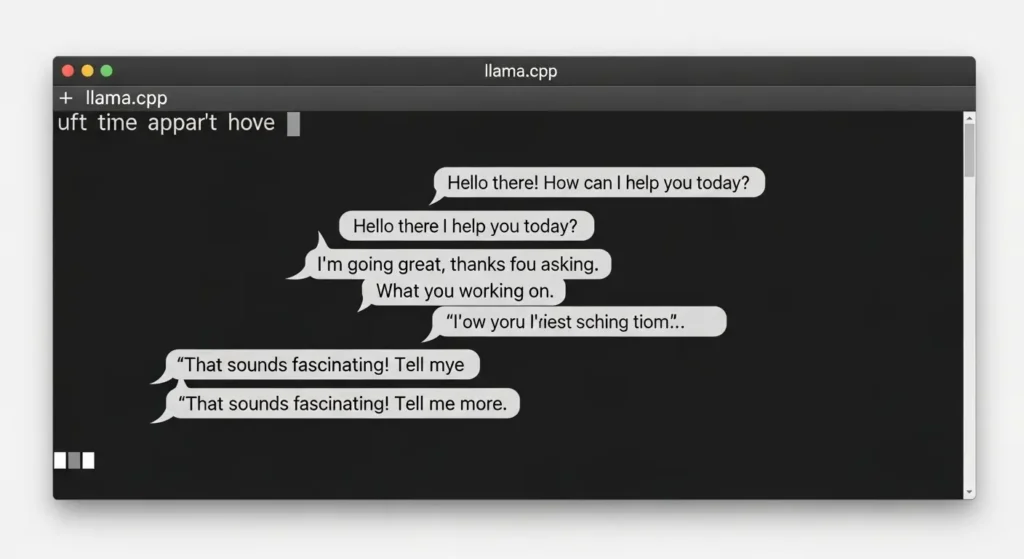

llama.cpp 使い方の徹底解説

要点:llama.cppは、特別なGPUがなくてもCPUだけで高度なAIを動かせる、最も汎用性の高いオープンソースツールです。

導入の手順とメリット

LLM 自作を志す人が最初に触れるべきツールがllama.cppです。

これはC++で記述されており、動作が極めて軽量なのが特徴です。

- Windows

- macOS

- Linux

といった主要なosすべてに対応しています。

使い方の流れは以下の通りです。

- GitHubからクローン:

git cloneコマンドでソースコードを入手します。 - ビルド: 自分のpc環境に合わせてコンパイル(注釈:ソースコードを実行可能な形式に変換すること)します。

- モデルの取得: Hugging Face(注釈:AIモデルの共有プラットフォーム)から、GGUF形式(注釈:llama.cpp用に最適化されたファイル形式)のモデルをダウンロードします。

- 実行: コマンドラインから実行指示を出し、対話を開始します。

初心者へのヒント

専門知識がなくても、最近はコンパイル済みのバイナリが公開されているため、ダウンロードしてすぐに使うことも可能です。

特にApple Silicon(M1/M2/M3チップ)を搭載したMacでは、メモリ帯域が広いため、llama.cppを使うことで驚くほど高速に日本語モデルを動かせます。

ollamaの使い方と環境構築

要点:ollamaは、コマンド一つでモデルのダウンロードから実行までを自動化する、現在最も「簡単」なローカルLLM導入手法です。

圧倒的な使いやすさ

「もっと手軽にローカルLLMを試したい」という方におすすめなのがollamaです。

ollama 使い方は非常にシンプルで、公式サイトからインストーラーをダウンロードします。

インストール後にターミナルで ollama run llama3 と入力するだけです。

これだけで、バックグラウンドで必要なモデルのダウンロードが始まります。

完了と同時にチャットが開始されます。

拡張性と連携

ollamaは、単体で使うだけではありません。

他のアプリケーションとの連携も得意です。

例えば、Web UI(注釈:ブラウザ上で操作できる画面)を別途導入すれば、ChatGPTのような洗練されたインターフェースで自作aiと会話できます。

また、開発者向けにはapiサーバーとしても機能するため、Pythonなどで自作したプログラムからローカルaiを呼び出すことも容易です。

2026年現在、ローカルLLM 構築のデファクトスタンダード(事実上の標準)になりつつあります。

モデルの選定:日本語に強いのはどれ?

要点:2026年時点では、Llama-3ベースの日本語調整済みモデルや、Qwen、Mistralといったシリーズが有力な選択肢です。

用途に応じたモデル選び

ローカルLLM作り方において、どの「脳」を選ぶかは非常に重要です。

- Llama-3 (Meta): 世界で最も人気があり、日本語に特化して追加学習(ファインチューニング)された派生モデルが多数公開されています。ELYZAなどが代表例です。

- Mistral / Mixtral: 比較的軽量でありながら、高い論理的思考能力を持ち、ビジネス文書の作成に適しています。

- Qwen (Alibaba): コーディングや数学的なタスクに非常に強く、日本語の扱いも自然です。

- Gemma (Google): 非常にコンパクトなモデルがあり、スペックの低いpcでも動作しやすいのが特徴です。

量子化の理解

大規模なモデルを自分のpcで動かすには、量子化(注釈:データの精度を少し落とすことで、ファイルサイズを劇的に小さくする技術)されたファイルを選ぶのがポイントです。

例えば、そのままでは40GB以上あるモデルでも、4ビット量子化(Q4_K_Mなど)を施せば、5GB〜8GB程度に収まります。

一般的な16GBメモリのpcでも快適に動作します。

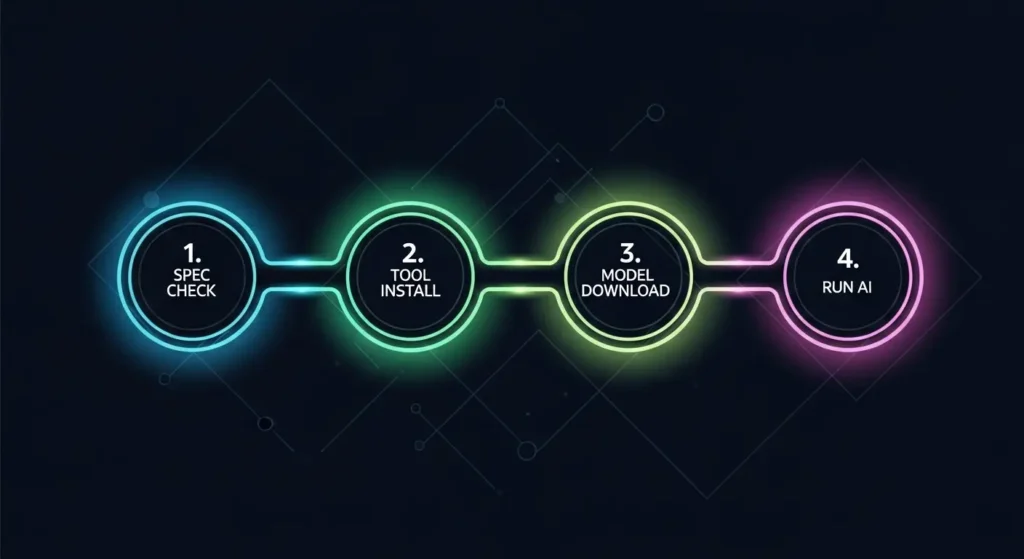

実践!ステップバイステップ構築ガイド

要点:2026年現在の環境構築は、OSに合わせた適切な実行エンジンの選択と、量子化モデルの選定を正しく行うことで、最短15分で完了します。

ローカルLLM作り方の具体的なフローを、Windows(WSL2)とMac(Apple Silicon)の両方の視点で、より実務に即した形でステップ分けして解説します。

ステップ1:ハードウェア診断とOSの最適化

構築を開始する前に、自身のPCがどの程度の「知能」を許容できるかを把握します。

- Windowsユーザー: NVIDIA製GPUのドライバーが最新であることを確認し、WSL2(注釈:Windows上でLinuxを動かすための仮想実行環境)をインストールします。これにより、コマンドラインでの操作が格段にスムーズになります。

- Macユーザー: アクティビティモニタを開き、ユニファイドメモリの空き容量を確認します。

ステップ2:実行エンジンの導入とセットアップ

2026年において、安定性と速度のバランスが最も良いのはOllamaですが、より詳細なカスタマイズを求めるならllama.cppを選択します。

- Ollamaの導入: 公式サイトからインストーラーを実行します。インストール後、ターミナルで

ollama -vと入力し、正常にバージョンが表示されるか確認してください。 - llama.cppの導入: GitHubから最新のリポジトリをクローンし、

make(注釈:プログラムを組み立てる命令)を実行してビルドします。最近では、GPUの計算能力を最大化する「CUDA」や「Metal」のフラグを自動認識するプリビルド版も配布されています。

ステップ3:Hugging Faceからのモデル取得

構築の核心となる「脳」を手に入れます。

- 量子化ビットの選択: メモリ8GB〜16GBなら「Q4_K_M」、24GB以上なら「Q6_K」や「Q8_0」と書かれたファイルを選択してください。これが、pcスペックに応じた推論速度と回答精度のバランスを決める境界線です。

- ダウンロード: Ollamaなら

ollama pull llama3.3:70b-instruct-q4_K_Mのように直接コマンドを打つだけです。llama.cppの場合は、Hugging Faceの「Files and versions」タブからGGUFファイルをダウンロードします。

ステップ4:推論エンジンの実行とプロンプト調整

いよいよAIを起動し、自分好みの性格を与えます。

- 初回の指示(System Prompt): ローカルモデルは自由度が高い反面、初期設定では英語で答えがちです。「あなたは優秀な日本語アシスタントです。常に日本語で簡潔に回答してください」という指示をシステム設定、あるいはコマンドのオプションで与えます。

- ベンチマーク(速度測定): 実際に文章を生成させ、1秒間に何文字(トークン)出ているかを確認します。2026年の基準では、1秒間に5〜10トークン以上出ていれば、ストレスなく実務に活用可能です。

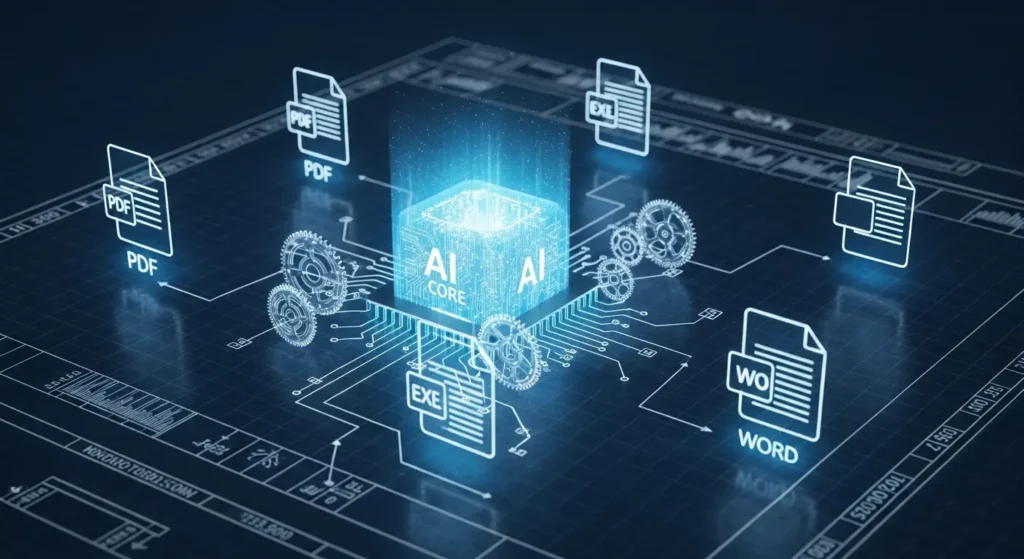

LangChain ローカルLLMの高度な活用

要点:LangChainを使えば、ローカルLLMを自社のpdf資料やデータベースと連携させ、実務に特化した知能へと拡張できます。

RAG(検索拡張生成)の実現

LLM 自作の最終的なゴールとして人気なのが、RAG(注釈:外部の知識ベースを参照して回答を生成する仕組み)の構築です。

LangChain ローカルLLMの組み合わせを使えば、あなたのpc内にある大量のpdfやテキストファイルをaiに読み込ませます。

「この資料に基づいた要約を作って」といった高度な指示が可能になります。

自律型エージェントの構築

さらに、LangChainを使えば「ツール」をaiに渡すことができます。

例えば、

- aiが自ら計算機を起動して計算する

- ファイルを検索する

- 特定のapiを叩いて情報を取得する、

といった自律的なエージェントをローカル環境で動かすことが可能です。

これは、情報の機密性を保ちつつ、業務の自動化を極限まで進めたい企業や個人にとって、2026年現在最も価値のある技術の一つです。

LangChainを活用した自律型チャットボットの構築

要点:LangChainを使えば、ローカルLLMを自社のドキュメントやコードベースと接続し、高度な検索・回答(RAG)を実装できます。

単なるチャットアプリではなく、実務に役立つ「専門アシスタント」を作るには、LangChainの活用が不可欠です。

- 独自ナレッジの読み込み: 会社のPDFや過去のプロジェクト資料をAIに読み込ませることで、独自のドキュメントに基づいた正確な回答が可能になります。

- プログラミング補完: ローカルLLMをIDE(開発環境)と接続し、外部へコードを送ることなくリアルタイムでのコード生成やエラー修正のサポートを受けられます。

- 履歴の活用: 会話の履歴をローカルのデータベースに保存し、文脈(コンテキスト)を維持した一貫性のある対話を実現します。

よくある質問と回答(FAQ)

要点:導入時に多くの人が直面する疑問や、エラーへの対処法を整理しました。

ゲーミングPCじゃない普通のノートPCでも動きますか?

はい、動きます。ただし、生成速度(文字が出てくるスピード)は遅くなります。

8GB RAMの事務用ノートpcであっても、最も軽量な1b(10億パラメータ)や3bクラスのモデルを使えば、実用的な速度で対話が可能です。

まずはollamaで軽量なモデルを試してみることをおすすめします。

日本語が不自然だったり、嘘をついたりします。

これは「ハルシネーション(注釈:もっともらしい嘘をつく現象)」と呼ばれるai特有の性質です。

対処法としては、日本語の指示に強い「Instruct」と名の付くモデルを選ぶことや、プロンプト(指示文)に「事実に基づいて回答してください」と一筆加えることが有効です。

また、RAGを導入して根拠となる資料を提示させるのが最も確実な解決策です。

H3:電気代が心配です。

aiの推論中はgpuやcpuがフル稼働するため、消費電力は上がります。

しかし、24時間動かし続けるのでなければ、一般的なpcの使用範囲内の電気代で収まります。

気になる場合は、推論が終わった後にモデルをメモリから解放する設定(ollamaのタイムアウト設定など)を確認しましょう。

2026年最新の「スモールモデル」トレンド

要点:巨大なモデルよりも、特定のタスクに特化した「小さなエリートモデル」を複数使い分ける運用が、ローカル環境の正解になりつつあります。

これまでの解説サイトでは「いかに巨大なモデルを動かすか」に焦点が当てられてきました。

しかし、2026年現在のトレンドは、3b〜8bクラスの極めて小さなモデルを、特定の業務(翻訳、コーディング、要約など)ごとに使い分ける手法です。

これにより、高額なgpuを導入しなくても、手元の環境で複数の専門家aiを同時に走らせるような高度な自動化が実現しています。

セキュリティを極限まで高める「閉域網AI」の構築

要点:ネットワークから物理的に遮断した「エアギャップ環境」での構築ノウハウは、真のプライバシー保護を求める層に支持されています。

多くのサイトが「便利なツール」の紹介に留まる中、本記事では真のセキュリティを追求する層に向けた構築を提案します。

一度モデルとツールをダウンロードしたpcからwi-fiカードを取り外す、あるいはファイアウォールで一切の外部通信を遮断した「エアギャップ」な環境でaiを運用する手法です。

これにより、万が一ツールに脆弱性があったとしても、自社の機密情報が1ミリも外に漏れない「究極の要塞AI」が完成します。

エネルギー効率を最大化する「量子化ビット」の選び方

要点:単に容量を減らすだけでなく、回答の「知性」と「応答速度」の最適解を見つけるための、2026年版の数値選定基準を解説します。

量子化には「Q4」「Q5」「Q8」といった種類がありますが、どれを選べばいいか迷う方は多いです。

2026年の最新知見では、8Bクラスのモデルであれば「Q6_K(6ビット)」が、知性の劣化を最小限に抑えつつメモリ消費を半分にできる、最もコストパフォーマンスの良い選択とされています。

逆に、70Bクラスの大規模モデルであれば「Q4_K_M(4ビット)」まで下げても、人間の目には劣化がほとんど分からないレベルの回答を維持できます。

トラブルシューティング:動かない時のチェックリスト

要点:エラーの原因は、パスの設定、メモリ不足、ドライバの不整合のいずれかであることがほとんどです。

- 「File Not Found」エラー: モデルファイルの置き場所をツールが認識できていません。設定ファイル内のパス(注釈:ファイルの住所)を再度確認してください。

- 生成が極端に遅い: gpuが使われず、cpuだけで計算が行われています。設定画面で「GPU Offload」を有効にしているかチェックしてください。

- 文字化けする: ターミナルの文字エンコーディングが「UTF-8」になっているか確認してください。日本語を扱うローカル環境では必須の設定です。

環境構築を進める際、もし問題が発生したら以下の項目を順に確認してください。

- インストールが途中で止まる: インターネット接続が不安定だとダウンロードに失敗します。再度、安定した回線で

installコマンドを実行してください。 - モデルが読み込まれない: GGUFファイルの保存場所(パス)に日本語やスペースが含まれていると、正常に読み込めないケースがあります。英数字のみのディレクトリに変更してください。

- 応答が著しく遅い: 量子化サイズが大きすぎてVRAMを圧迫しています。4b(4ビット)などの軽量版への変更を検討しましょう。

今後の展望:あなたのPCが「脳」になる日

要点:ローカルLLMの構築は、aiを単なるツールから、あなた自身の思考を拡張する「デジタルな脳」へと変える第一歩です。

ローカルLLMの作り方を学ぶことは、これからの時代に求められる「AIガバナンス」を自ら体現することに他なりません。

2026年、AIを単なる便利なツールとして利用する段階は終わります。

いかに安全に、そして独自性を伴って「保有」するかが問われています。

今回ご紹介した構築手順を実践すれば、あなたはクラウドの制約から解き放たれ、自分だけの最強のパートナーを手に入れることができます。

まずは無料のモデルを一つダウンロードし、あなたのPCの上でAIが初めて言葉を発する瞬間を体験してください。

その驚きと可能性が、あなたの創造的な活動に大きな貢献を果たすことをお約束します。

継続的な学習とアップデート

aiの世界は日進月歩です。一度環境を作って終わりではなく、週に一度はGitHubやHugging Faceをチェックして、新しいモデルやツールの更新を取り入れる習慣をつけましょう。

あなたのpcの中に、あなただけが知る、あなただけの知識を持ったaiが育っていく過程は、これまでのテクノロジー体験にはなかった創造的な喜びをもたらしてくれるはずです。

結論:ローカルLLM構築で自由をその手に

要点:今すぐ環境構築を始め、クラウドの制約から解放された自由なaiライフをスタートさせましょう。

ローカルLLM作り方を理解し、実践することは、現代の最も価値あるスキルの一つです。

最初は難しく感じるかもしれませんが、ollamaなどのツールを使えば、今日この瞬間にでもあなたのpcでaiを喋らせることができます。

情報の安全を守り、コストを抑え、自分好みにカスタマイズしたai環境は、これからのあなたの仕事や学びを大きく変える力になります。

さあ、今すぐお気に入りのモデルを見つけて、ダウンロードボタンをクリックすることから始めてみてください。