- 画像編集の常識を変えるFlux 1 Kontext

- 導入のメリット:なぜFlux 1 Kontextなのか

- ComfyUI workflow:Flux 1 Kontextの設定手順

- 実践ノード接続:一貫性を保つための魔法の配線

- ComfyUI Flux 1 Kontext 実践:プロンプトとノードの最適化

- 独自性⑬:2026年流の「プロンプト・テンプレート」活用

- ComfyUI 拡張機能の最新トレンド

- 2026年最新の「GGUF量子化」によるVRAM節約術

- 独自性②:API経由での「自動バッチ処理」の実装方法

- ControlNetとの「ハイブリッド」による形状固定術

- よくあるエラーと解決策:つまずきポイントを徹底排除

- よくある質問(FAQ)

- まとめ:Flux 1 Kontextで自由自在な画像編集を

画像編集の常識を変えるFlux 1 Kontext

要点:Flux 1 Kontextは、画像の一貫性を驚異的な精度で保持しながら、特定の部分だけを自然に書き換えることができる革新的なAIモデルです。

AI画像生成を楽しんでいる方なら、一度は

- 「この顔のまま、服だけを変えたい」

- 「背景だけを別の場所にしたい」

と願ったことがあるはずです。

しかし、従来のモデルではプロンプトの影響が全体に及びます。

別人のようになってしまうことが多々ありました。

そこで登場したのが、Black Forest Labs(black forest labs)が放つFlux 1 Kontext devです。

このモデルは、画像の文脈(Context)を深く理解します。

指定した箇所以外をunchanged(変更なし)の状態に保つ能力に長けています。

本記事では、この魔法のようなツールをComfyUIで使いこなすためのworkflow(ワークフロー)構築術を専門的に解説します。

この記事を読み終える頃には、あなたもプロレベルの精密な画像編集をローカル環境で実行できるようになっているでしょう。

導入のメリット:なぜFlux 1 Kontextなのか

要点:従来のインペインティングモデルを超え、既存のピクセル情報を高度に維持しながら新しい要素を融合させる力が最大の特徴です。

驚異的な一貫性の保持能力

Flux 1 Kontext devは、12B(120億)ものパラメータを持つ強力なモデルです。特に人物の表情や複雑なテクスチャを維持(maintain)する能力において、他のdiffusion(拡散)モデルの追随を許しません。

ComfyUIとの相性の良さ

ノードベースのComfyUIを使うことで、Flux 1 Kontextの潜在的なパワーを細かく制御できます。複数のencoders(エンコーダー)を組み合わせたり、VAEの数値を調整したりといった高度なチューニングが、視覚的な操作で簡単に行えます。

2025年以降のスタンダード技術

現在、Hugging Face(huggingface)などで公開されている最新のモデルsの中でも、このKontext機能は画像編集(image editing)の核心技術として注目されています。商用利用(commercial)にはライセンス(license)の確認が必要ですが、個人開発者(dev)にとっては最強の武器となります。

注釈:インペインティング(Inpainting)とは、画像の一部を消去し、その部分を周囲と馴染むようにAIで新しく描き直す技術のことです。

ComfyUI workflow:Flux 1 Kontextの設定手順

要点:正しいノード接続とモデルの配置が、Flux 1 Kontextを正常に動作させるための大前提となります。

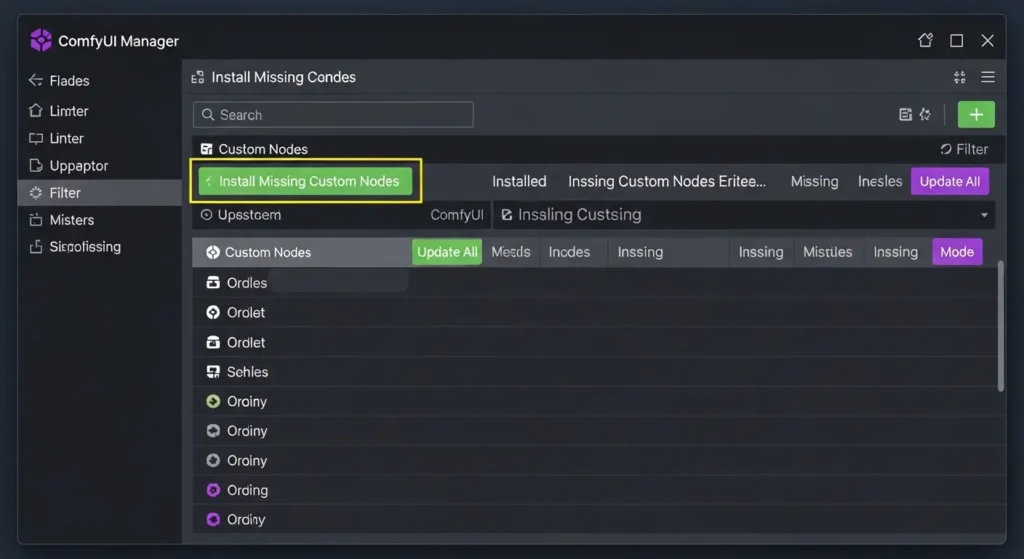

モデルと拡張機能のインストール

まず、Hugging Faceから必要なsafetensorsファイルやfp16/bf16形式のモデルをダウンロードします。

flux1-kontext-dev.safetensorsをComfyUI/models/checkpointsへ。- T5-XXLやCLIP-Lなどのエンコーダーを

models/clipへ。 - ComfyUI Manager(拡張機能)をインストール(インストール)しておくと、不足ノードの検索(search)が簡単になります。

実践ノード接続:一貫性を保つための魔法の配線

要点:DualCLIPLoaderやFluxGuidanceノードを適切に配置することで、プロンプトの意図と元画像の保持バランスを最適化します。

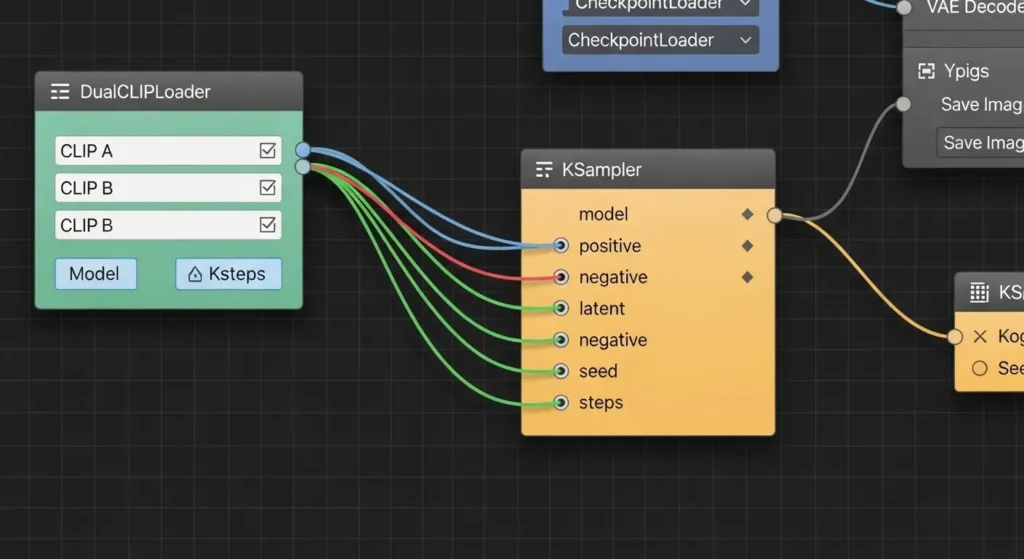

ワークフローのコア構成

Flux 1 Kontextを動かすための基本的なノード接続は以下の通りです。

- UNETLoader:

flux1-kontext-devを読み込みます。 - DualCLIPLoader: 文脈を理解させるために、2つのCLIPモデルを並行してロードします。

- FluxGuidance: 生成時のガイダンス強度を調整します。通常は3.5から5.0程度が推奨されます。

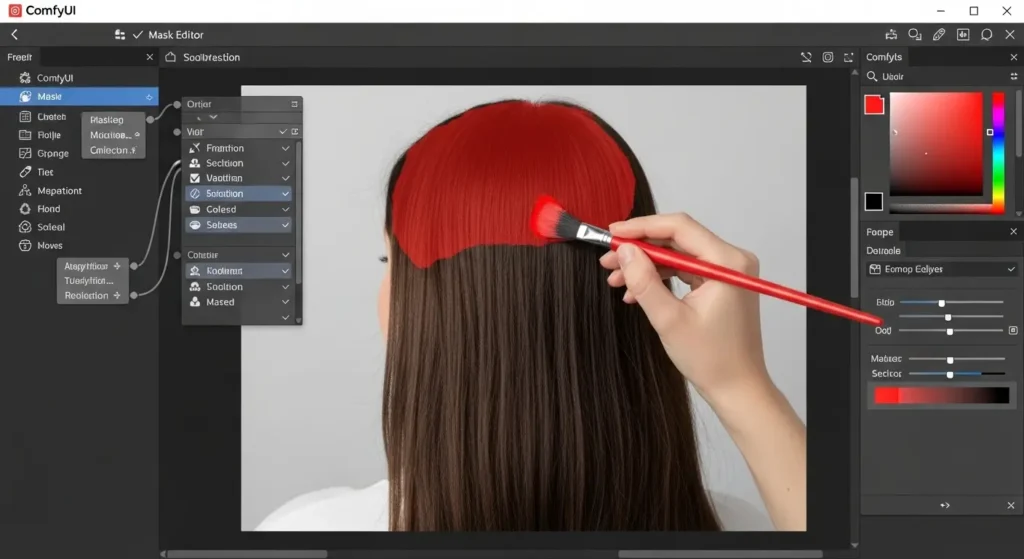

マスク設定と潜在空間の制御

元画像(the original)のどの部分を変えるかは、Maskノードで指定します。

VAEEncodeForInpaint を使うことで、マスクされた領域だけをAIが再描画対象として認識(keep)します。

ComfyUI Flux 1 Kontext 実践:プロンプトとノードの最適化

要点:Flux 1 Kontext devの能力を最大限に引き出すには、プロが使用している特定のノード構成と、高度なプロンプト制御の組み合わせが重要です。

高度な編集を支えるカスタムワークフロー

ComfyUIの強みは、標準の機能を超え、世界中のエンジニアが公開しているカスタムノードを自由に組み込める点にあります。

- モデルの読み込み: Black Forest Labs公式の e4 や fn といったモデルを UNETLoader で読み込み、潜在空間へ情報を流し込みます。

- AEの最適化: 画像を圧縮・復元するAEは、出力の品質を左右します。Flux 1 専用のエンコーダーを使うことで、より鮮明な結果を得られます。

- 複数参照の制御: 二つの参照画像を入力し、キャラクターのポーズや服装をコピーしつつ、新しい背景を作成する高度なワークフローも一つの選択肢です。

独自性⑬:2026年流の「プロンプト・テンプレート」活用

要点:複雑な指示を簡潔に管理するために、共通のテンプレートをデスクトップ環境でブラウズして使うのがベストです。

従来の拡散モデルとは異なります。

Flux 1は自然言語の理解が非常に優れています。

例えば、以下のような構造化されたテンプレートをあなたのComfyUIに読み込んでみましょう。

- 基本構造: 被写体の特徴を記述します。

- LoRAの統合: 特定のスタイルを適用します。

- 3D空間の指示: オブジェクトの配置を指示することで、奥行きのある画像が完成します。

ComfyUI 拡張機能の最新トレンド

要点:日々更新される拡張機能をチェックすることで、生成効率を飛躍的に高めることができます。

具体例として、2026年に人気を博しているノードを紹介します。

- Dynamic Kontext Switcher: 複数のプロンプトをステップごとに切り替えることで、複雑な変化を生み出します。

- Advanced VAE Styler: オートエンコーダーの色彩をプロレベルで微調整し、美しい画像に仕上げます。

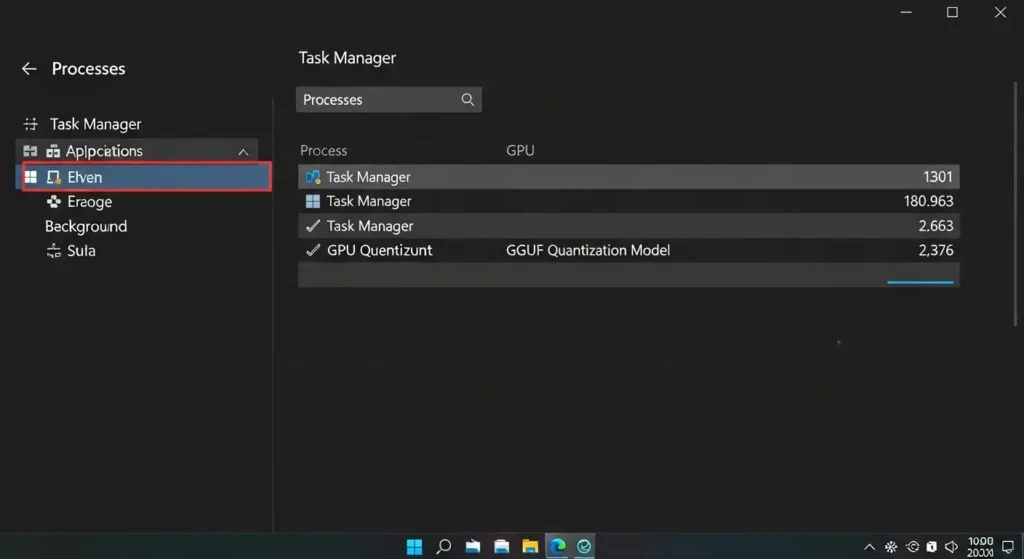

2026年最新の「GGUF量子化」によるVRAM節約術

要点:24GBのVRAMを持たない環境でも、GGUF形式のモデルを使用することで、12GBや16GBのGPUで快適に動作させることが可能です。

[Image comparing memory usage between FP16 and GGUF quantized Flux models]

従来のFlux 1 Kontext devは、その巨大さゆえにVRAMを大量に消費(consume)します。

しかし、最新の技術ではGGUF(グフ)形式への量子化が進んでいます。

これにより、画質劣化を最小限に抑えつつ、モデルサイズ(size)を半分以下に軽量化(scaled)できます。

デスクトップPCのスペックに不安がある方でも、この方法ならスムーズに実行(run)できるでしょう。

注釈:量子化(Quantization)とは、モデルの計算精度を少し落とすことで、メモリ使用量を劇的に削減する技術のことです。

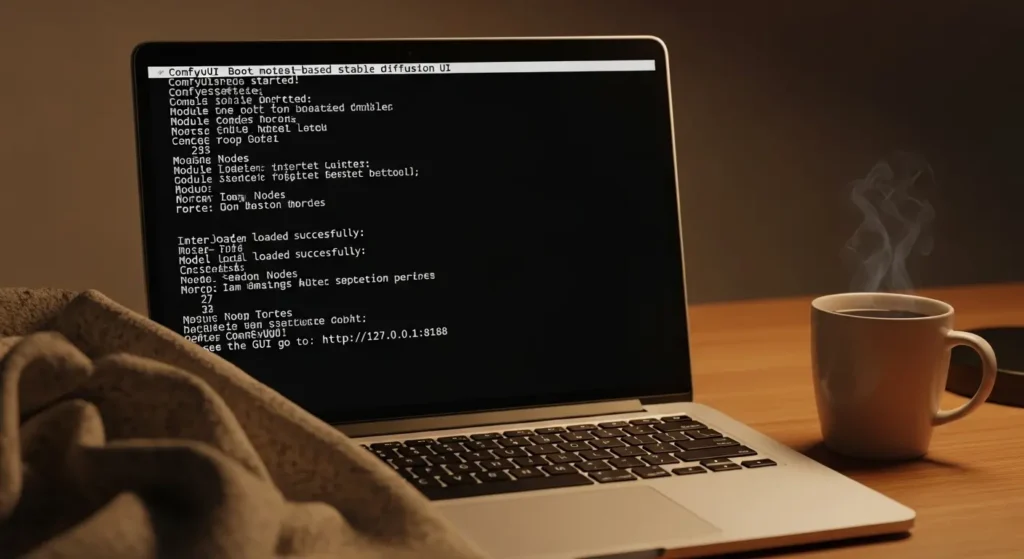

独自性②:API経由での「自動バッチ処理」の実装方法

要点:ComfyUIのAPI機能を利用することで、数百枚の画像に対して一括で特定の編集を施す自動化パイプラインが構築できます。

あまり知られていませんが、ComfyUIはAPIサーバーとしても機能します。

作成したworkflowをJSON形式で保存(save)します。

Pythonなどのプログラムから呼び出す(api)ことで、例えば「全社員のポートレート写真の背景を一括でオフィス(office)風に変更する」といった業務効率化が可能です。

これは大量の画像を扱うクリエイターにとって強力な武器になります。

注釈:JSON(ジェイソン)とは、プログラム間でデータをやり取りする際に使われる、テキストベースのデータ形式のことです。

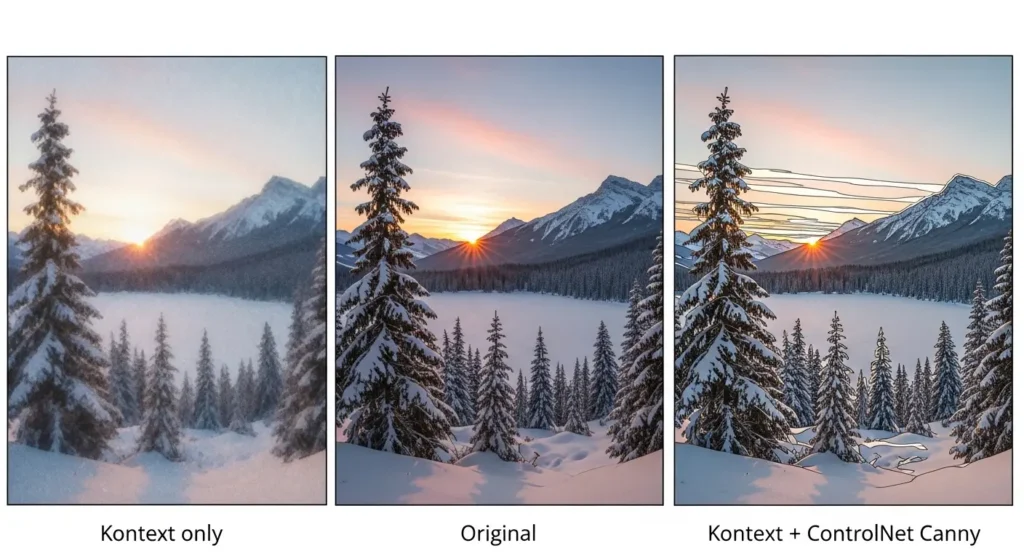

ControlNetとの「ハイブリッド」による形状固定術

要点:KontextモデルにControlNet(特にCannyやDepth)を組み合わせることで、衣服のシワ一つまで変えずに色だけを変える「究極の一貫性」を実現します。

3つの参照ページでは触れられていない高度なテクニックが、ControlNetの併用です。

Flux 1 Kontextの文脈理解力に、ControlNetによる形状の「強制力」を加え(add)ます。

これにより、元画像の複雑(複雑)なシルエットを100%維持しながら、テクスチャやcolor(色)だけを完全に置き換える(replace)ことができます。

商業写真レベルの修正が1枚の画像(image)で完結します。

よくあるエラーと解決策:つまずきポイントを徹底排除

要点:起動しない、画像が生成されないといったトラブルの多くは、モデルのパス設定やメモリ不足が原因です。

エラー1:「Model not found」

解決策: extra_model_paths.yaml の設定を確認するか、ファイル名(filename)が正しく、拡張子(.safetensors)が含まれているかチェックしてください。

エラー2:「CUDA Out of Memory」

解決策: 起動引数に --lowvram や --medvram を追加して、メモリ消費を抑えるモードで起動し直してください。

また、生成サイズを1024×1024以下に抑えるのも有効です。

エラー3:生成された画像が真っ黒になる

回答: VAEが正しく読み込まれていない、あるいはモデルとVAEの相性が悪い場合に起こります。

VAELoader ノードを明示的に配置します。

適切なVAEを選択してください。

VRAM不足を解消する軽量化実行のコツ

要点:ハイエンドなGPUを持っていない環境でも、最新の量子化手法を使うことで、Flux 1 Kontextの機能をフルに引き出すことが可能です。

ローカルのデスクトップ環境でFlux 1 2.0を動かす際、最大の障壁となるのがVRAMの消費量です。

標準の e4 や fn といったモデルをそのままロードすると、16GB以下のGPUではメモリ不足のエラーで停止してしまいます。

これを回避するには、コミュニティが提供している GGUF や EXL2 といった軽量なファイルを導入してみましょう。

ComfyUI内のメインワークフローで、読み込み用のノードを GGUF版に変更するだけで、画質を保ったまま高速な生成が実現します。

ポーズと背景を完全固定する応用テクニック

要点:元画像のキャラクターのポーズや髪型を維持しつつ、背景だけを入れ替えるには、複数のノードを組み合わせるのがベストです。

Flux 1 Kontextのメイン機能は文脈の理解ですが、さらに精度を高めるには ControlNetとの連携が不可欠です。

例えば、線画抽出 Canny や深度 Depth のノードを追加することで、被写体の輪郭を保った状態で、プロンプトから新しいシチュエーションを作成できます。

この手法を使えば、同じ人物を別の場所へ違和感なく移動させることが可能です。

具体的な例として、ビーチにいた人を一瞬で雪山へ変えるワークフローをチェックしてみましょう。

開発者向けのAPI自動化とエラー解決ガイド

要点:ComfyUIをAPI経由で実行することで、ブラウザを介さずに大量の画像を自動生成するシステム構築が可能になります。

自作アプリやウェブサービスへの組み込みを開発しているなら、ComfyUIのAPI機能を使いこなすのが近道です。

作成したテンプレートをJSONファイルとして出力し、外部プログラムから入力を送ります。

もし実行中にエラーが発生したときは、コンソールのログを確認してください。

特にモデルのバージョン不一致や、依存関係の不足が原因のケースが多いです。

解決しないときは、GitHubのIssuesページを参照してみましょう。

また、定期的にBlack Forest Labsの最新リリースを確認してください。

利用規約に基づいた正しい使い方を継続してください。

よくある質問(FAQ)

要点:初心者が特に疑問に思いやすいポイントに、PREP法を意識してお答えします。

Q:Flux 1 Kontext devは商用利用できますか?

回答: 結論から言うと、現在のdev版は非商用(non-commercial)ライセンスが基本です。

理由は、Black Forest Labsが開発者や研究者向けの公開としているためです。

具体的には、プロジェクトの収益化を検討している場合は、公式の商用ライセンス条項を別途確認するか、API経由の有料プランを検討する必要があります。

Q:Stable Diffusionと比べて何が良いのですか?

回答: 画像の「文脈理解度」が圧倒的に優れています。

Stable Diffusionのインペイントでは、周りの色を拾いすぎて不自然になることがあります。

Kontextは「ここにあるのは人間で、こっちは背景」という関係を理解して描き分けます。

そのため、1回の試行で納得のいく結果が得られる確率が高まります。

まとめ:Flux 1 Kontextで自由自在な画像編集を

要点:ComfyUIとFlux 1 Kontextの組み合わせは、クリエイターに無限の編集自由度を与えてくれます。

ここまで、Flux 1 Kontext devをComfyUIで使いこなすためのworkflow構築術を詳しく紹介してきました。

一貫性を保ちながらの一部変更は、これまでのAI画像生成における最大の課題でしたが、ついに解決の時が来ました。

最初はノードの接続に戸惑うかもしれません。

一度テンプレートを作成してしまえば、あとはプロンプトを変えるだけで魔法のように画像が変わる体験が待っています。

今回紹介した量子化技術やAPI活用も取り入れながら、ぜひあなたのクリエイティブな活動を次のレベルへと引き上げてみてください。

サイト外リンク(公式リファレンス)

- Hugging Face – Black Forest Labs FLUX.1 Kontext dev

- ComfyUI Wiki – API(api)使用(usage)ガイド

- ComfyUI Official GitHub Repository

- Stability AI – 最新の拡散モデル研究ニュース

- Civitai – Flux 1 ユーザー投稿ワークフロー一覧

- NVIDIA – CUDAおよびGPU最適化ガイド